2019年3月,SANS发布了一份有关AI在安全领域应用情况的调研报告,题为《AI让安全更聪明》。

调查结果显示,85%的受访者认为AI对安全是有价值的,同时67%的人表示传统的安全工具依然可以发挥作用;应用AI的解决方案的三个最优先的技术是:预测分析、深度学习平台、机器学习平台;AI在安全领域的优选三个场景是:网络防御、恶意软件阻断、高级威胁监测/阻断。

首先,SANS给AI做了一个描述性定义:

人工智能能够像人一样进行推理和“思考”,同时展现出人类智能的以下关键特征:

学习:能根据过去的经验改变行为,例如,在遇到新的和未知的情况时

记忆:能对过去d的经验进行编码,存储和检索

推理和抽象:根据样本数据推演出逻辑结论并产生/推导出规则

解决问题的:系统性地提出可能的解决方案并推导出问题的最优解

发散思维:能够针对给定的问题生成多种解决方案

接着,SANS又给出了应用AI的安全解决方案应该具备的5个能力:

发现:无需人工干预即可从数据中进行学习;

预测:基于通过智能发现获得的对数据的理解,提供事情未来发展的多种可能性判断;

证明:要能够解释分析结果的可识别性和可信性;这里的证明不是去解释AI所用到的算法和参数,而是为什么会得到这个分析结果,需要结合安全领域知识给出这个结论的成因;

行动:按照相应的(安全)业务流程实现AI安全应用的闭环;

总结:基于检测和行动的结果持续改进的能力。

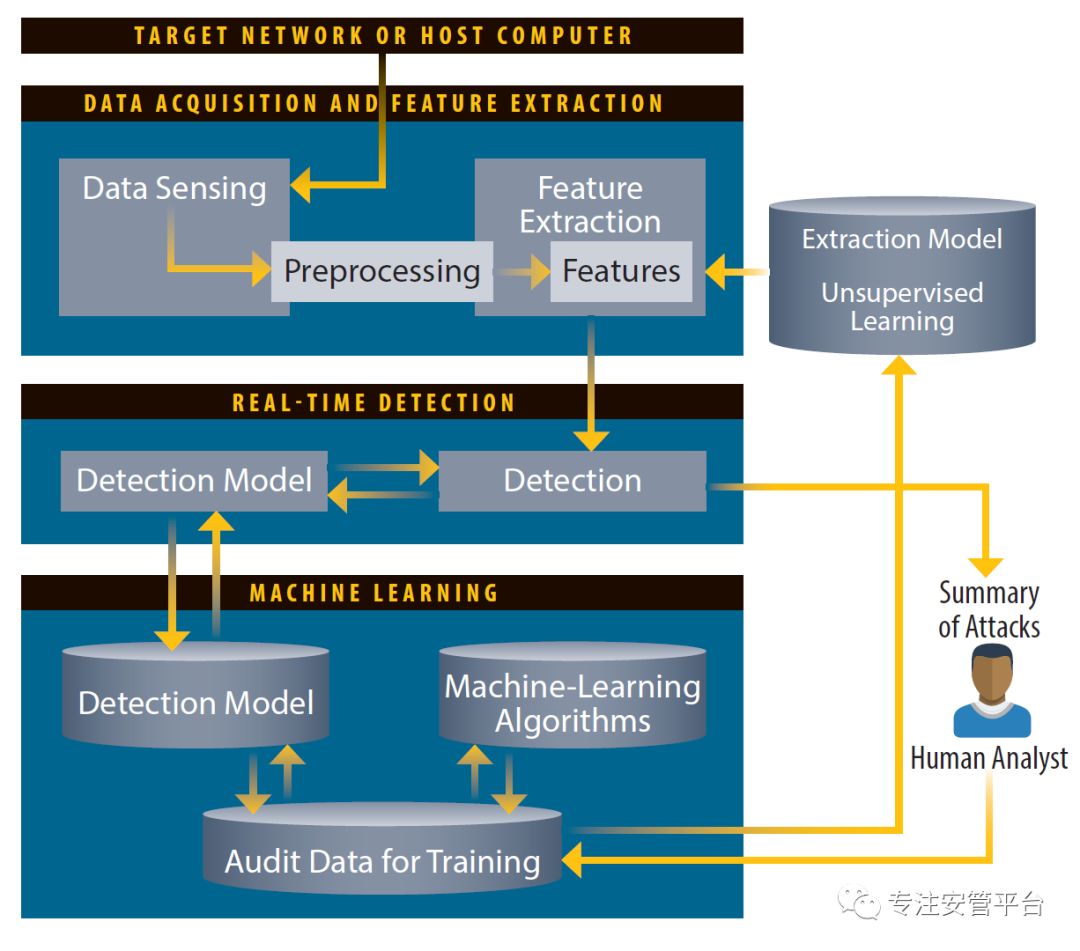

再下来,SANS给出了一个基于ML的威胁检测参考架构,作为AI安全解决方案的示例。

从上往下,这个参考架构分别包括数据获取与特征提取、实时检测、机器学习三个部分。

这个架构中我个人认为值得一提的是“特征提取”这个环节。当前业内已经发布了很多各式各样的大数据安全分析架构图,但其中绝大部分对于特征提取都没有提及。实际上,我是很关注这个点的,我认为特侦提取是大数据安全分析的关键环节。特征提取就是建立数据的元模型、并从数据中提取元数据的过程,是后续各种高级安全分析(包括ML、统计建模等)的基础。而元模型的建立恰恰体现了设计者对安全领域知识的掌握程度。

调查显示,57%的受访者正在或者打算使用应用了AI的安全解决方案,尽管只有35%的人真正实际用过这类平台。85%的人表示AI有助于提升安全,同时有67%的人认为AI将更多会增强而非替代现有的工具。

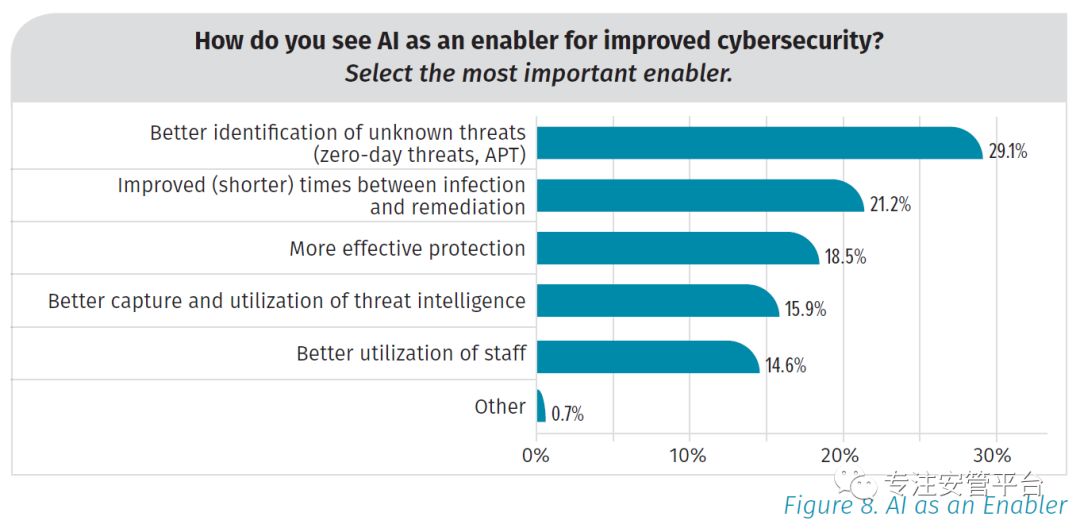

下表显示了受访者认为AI能够增强安全哪个方面的调研结果:

可以看到,AI主要是增强了未知威胁检测的能力,其次有助于提升从感染到修复的效率(更短的MTTD/MTTR)。

在被问及AI成熟度的时候,专业安全人员和管理层的观点出现了分歧。前者更倾向于认为基于AI的安全解决方案趋于成熟,而管理层则对此心存疑虑。而他们是真正影响基于AI的安全的投入预算的人。

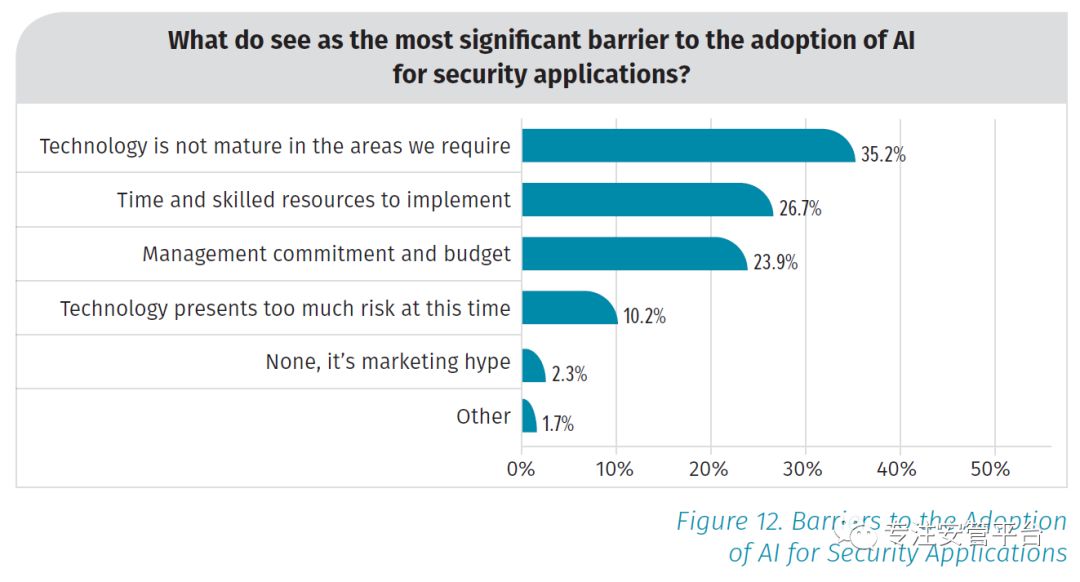

下图显示了阻碍AI在安全领域应用的问题:

可见对AI技术的成熟度问题还是首要的忧虑。正如所有此类报告(包括SANS、Ponemon、Gartner)所揭示的那样,AI的落地远非算法本身,输入的数据质量保障、后续的持续调优、高水平的运维人员和分析师都是一个个AI落地需要淌过的坑。

对于打算启动基于AI的安全项目的人,SANS给出了几点建议:

1)搞清楚自己的应用场景和用例。需求越明确越精准越好,因为现在AI更适合解决特定问题;

2)理解数据及其局限性。核心就是数据建模,进一步讲就是要做好数据治理。

3)建立对AI的透明度和可信度。透明度就是了解AI算法的工作原理和过程,可信度就是对AI算法得出的结论的信赖程度。我认为这其实就是我们一直提及的AI的可解释性,这对于安全应用十分重要。

4)不要低估AI训练所需要的时间。为了获得更准确的结果,用户需要准备更长时间的样本数据,进行更长时间的训练。简言之,不要处处指望立竿见影。

5)慎重评估AI技术,多问几个为什么,不要好高骛远,要契合自身实际。

最后,SANS指出,What is good for the defender is also good for the attacker。事实上,我们基本倾向于认为进攻方对AI的运用要领先于防守方。

声明:本文来自专注安管平台,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。