深度换脸视频以假乱真,危害网络安全。

所幸最近有一门先进的计算机科学擅长辨别假视频:用算法识别视频的处理痕迹;并在照片或视频中添加特殊设计的噪点,通过欺骗人脸检测算法起到抵御作用,有望从源头上消灭“深度换脸”。

深度换脸(deepfake)视频往往相当逼真,未经专业训练,肉眼很难辨别。不管是作为个人复仇的工具,还是为了操纵金融市场,抑或是破坏国际关系的稳定,换脸视频都从根本上颠覆了我们一直坚信的“眼见为实”,但这种颠覆将到此为止。

大部分深度换脸视频的制作过程是这样的:向一个计算机算法展示同一个人的多张图像,然后让它利用所看到的图像,生成新的人脸图像,同时合成这个人的声音。因此,其声音和画面都能达到以假乱真的效果。

早期的深度换脸视频没有考虑到正常人眨眼的次数,笔者的研究团队能够侦测出这类假视频。但如今的换脸视频已经更新换代,所以我们的研究也在不断推进。

现在,我们可以通过仔细观察特定几帧画面的像素,识别视频的处理痕迹。此外我们还更进一步,开发了一项积极措施,保护个人免受换脸视频所害。

寻找瑕疵

在最近的两篇研究论文中,我们探讨了如何检测带有瑕疵的深度换脸视频,并且这些瑕疵是伪造者无法轻易修复的。

当深度换脸视频的合成算法生成新的面部表情时,新图像中人的头部位置、光照条件以及人到相机的距离并不总是与源图相匹配。为了使这些假面孔融入周围的环境,伪造者必须对它们进行几何变换,包括旋转、调整大小或以其他方式扭曲,最后生成的图像就会产生数码失真。

在经过“大整”的视频中,你可能会看出失真的痕迹,比如模糊边框和人工磨皮,看起来明显被修改过。而即使是“微整”的视频,也会留下证据。

我们已经训练了一套算法,能够识别人眼区分不了的失真。

如果换脸视频中的人没有直视摄像头,这些失真痕迹就会发生变化。拍摄真人的视频会显示其面部在三维空间中的移动状态,但深度换脸算法还没法在三维空间里制作人脸。相反,它们只能生成一张常规的二维人脸图像,然后尝试旋转、调整大小和扭曲图像,使其与人的视线方向保持一致。

在这方面,它们的火候也还不够,这就为侦测提供了机会。我们设计了一个算法,能够计算图像中人的鼻子指向哪个方向,还可以根据人脸轮廓测量出头部的方向。在真人视频中,这些方向都是彼此对齐的。但深度换脸视频往往会出现错位。

当计算机把尼古拉斯·凯奇(Nicolas Cage)的脸安在伊隆·马斯克(Elon Musk)的头上时,它可能无法将脸和头正确对齐。

抵御伪造

侦测深度换脸视频这门科学实际上就是一场军备竞赛。伪造者的杜撰能力会越来越强,所以,我们的研究也要努力跟上,甚至领先一步。

假如能够找到一种方法,影响生成换脸视频的算法,削弱其能力,那么我们就能更好地识别出假视频。

最近,我的研究团队就做到了。

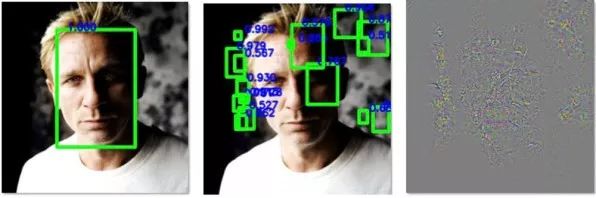

在上图中,左图是我们处理之前的图像,算法可以轻松检测到人脸。在中间的照片里,我们添加了一些干扰因素,使算法检测到其他人脸,但检测不到真实的人脸。右图显示了我们对图像进行的更改,已增强30倍。

人脸图库是由算法组合而成的,这些算法处理了数千张在线照片和视频,并使用机器学习检测和提取人脸。计算机看到一张班级合影,就可能侦测出所有学生和老师的面孔,然后把这些面孔添加到图库中。当图库中有了大量高品质的人脸图像时,最终的深度换脸视频就更有可能成功骗过受众的眼睛。

我们找到了一种方法:可以在数码照片或视频中添加特殊设计的噪点。这些噪点人眼不可见,但却可以欺骗人脸检测算法。它可以隐藏人脸探测器用于定位面部的像素模式,并在没有人脸的地方(比如一小片背景或衣服上的一块正方形)创建“诱饵”,暗示这里有一张脸。

真脸少了,“假脸”多了,训练数据就会受到污染,深度换脸算法生成假脸的能力也会随之减弱。这不仅延缓了深度换脸视频的制作过程,也能够增加视频瑕疵,降低检测难度。

未来,我们希望能把这个算法应用到任何用户上传至社交媒体或其他在线站点的任何图像上。在上传过程中,算法可能会询问对方:“你想保护这个视频或图像中的人脸不被用于深度换脸吗?”如果用户选择“是”,那么该算法就会给视频或图像添加数字噪点。网上的人还是可以看到其中的人脸,但在试图模仿它的算法面前,它们又被有效地隐藏了起来。

文 | 快公司编辑部 翻译 | 李美玉 图片 | 网络

https://www.fastcompany.com/90370113/this-ingenious-algorithm-outsmarts-deepfakes

声明:本文来自快公司FastCompany,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。