随着人工智能的飞速发展,数据作为人工智能技术开发和应用的基础,愈发显示出重要的作用。然而,在人工智能开发和应用过程中,越来越多的数据在人们的生产和生活场景中被收集和利用,数据安全和隐私保护面临严峻的安全挑战。

8月30日,在由赛博研究院承办的2019世界人工智能安全高端对话上,赛博研究院和上海观安信息技术股份有限公司共同发布了《人工智能数据安全风险与治理》报告(以下简称《报告》)。《报告》对当前人工智能发展带来的数据安全风险进行了全面分析,并分别在政策法规和技术层面对目前国内外的相关应对举措进行了梳理。在此基础上,《报告》提出了人工智能数据安全治理的目标、框架及治理措施,总结国内外优秀实践案例,致力于为有效解决人工智能中的数据安全问题提供建议和思路。

数据安全风险接踵而至

《报告》指出,人工智能中的数据安全挑战包括三个方面,分别为数据隐私问题、数据质量问题和数据保护问题。数据隐私问题指在人工智能的开发、测试、运行过程中存在的隐私侵犯问题,这一类问题是当前人工智能应用需要解决的关键问题之一;数据质量问题主要指用于人工智能的训练数据集以及采集的现场数据潜在存在的质量问题,以及可能导致的后果,这是人工智能特有的一类数据安全问题;数据保护问题主要指人工智能开发及应用企业对持有数据的安全保护问题,涉及数据采集、传输、存储、使用、流转等全生命周期,以及人工智能开发和应用等各个环节。

安全应对力不从心

随着人工智能的快速发展,相关数据安全事件的不断曝光虽然已经引发了各方的担忧和关切,也在法规、标准、技术层面提出了适用性的解决方案,但距离有效解决数据安全问题,仍存在较大差距。

法规层面,法律存在盲点。例如针对训练数据集的质量问题,当前国内外都缺乏相应的法规予以规范。此外,我国尚未推出《数据安全法》《个人信息保护法》等数据安全法规,而既有法规无法对人工智能中涉及的数据隐私问题予以全面、有效规制。

标准层面,当前在全球范围内,无论是人工智能数据安全相关的通用标准,还是细分领域标准,都比较缺乏。

企业意识方面,由于人工智能相关技术发展处于早期阶段,且发展迅速,全球范围内无论是大型科技企业,还是初创企业,投入大量资源开展人工智能技术的开发和应用研究,但甚少有企业关注其中的数据安全问题,除非出现了相关的数据泄露事件或隐私争议性事件。

技术层面,当前基于隐私的机器学习技术,以及针对各种恶意攻击的防御技术和数据保护技术都在快速发展,但仍不能解决全部问题。

数据安全治理框架保驾护航

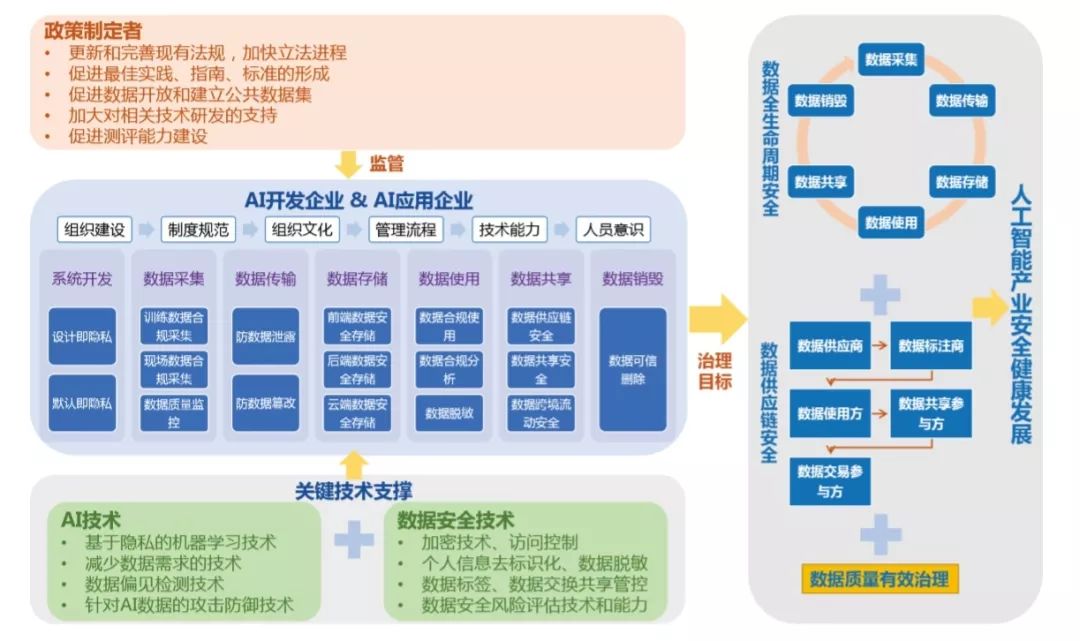

人工智能中的数据安全治理是一个系统性工程,需要从法规、标准、技术等各个层面寻求应对策略,并需要监管方、政策制定者,人工智能开发商、制造商、服务提供商,以及网络安全企业协作,共同致力于解决数据安全的重大挑战。在人工智能技术发展的当前阶段,同步建立安全治理体系,护航人工智能技术的健康可控发展。为有效应对人工智能带来的数据安全挑战,《报告》从多个角度出发,提出了人工智能数据安全治理的总体框架。该框架依靠政策与法规为先导,以产业自律+组织管理制度建设为基础,以覆盖数据生命周期的协同化技术保障体系为核心,以关键技术突破为支撑,实现人工智能数据安全治理的四大目标,分别为实现数据生命周期安全;实现数据供应链安全;实现数据质量有效治理;不阻碍人工智能技术创新。

人工智能数据安全治理总体框架

人工智能发展方兴未艾,随着人工智能技术的进一步发展,未来将可能产生更多的数据安全风险及隐患,兼顾技术发展和数据安全是监管方和科技界面临的重大挑战。监管方、人工智能企业、网络安全企业应进一步协同合作,共同致力于数据和隐私的保护,保障人工智能技术和产业朝着造福人类社会的正确方向前进。

下载报告:http://sbwz.walkhunter.com/Upload/ueditor_file/ueditor/20190904/1567581589294968.pdf

声明:本文来自赛博研究院,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。