来源:CNBC等,编辑:大明

最近,一段实时生成的俄罗斯总统普京接受采访的deepfake视频在网上引发热议。在MIT的EmTech峰会上,麻省理工技术评论主编吉迪恩·利奇菲尔德在舞台上对Deepfake生成的“弗拉基米尔·普京”进行了采访。

一段视频显示,利奇菲尔德先提出问题,然后换到不远处的另一个位置,换脸成为“俄罗斯总统”做出回应。

当然,从视频中的生成效果来看,这个Deepfake视频还不够逼真,比如表情僵硬、皮肤边界明显、发际线与真人相比明显高了太多等等,一般人一眼就看出这是假冒的。

南加州大学(USC)计算机科学副教授黎颢表示,未来的Deepfake视频将更加真实,在未来6-12个月内,这类视频可能变得完全和真的一样。在许多情况下,如果使用当前技术,一般人很容易看出来视频是修改后的。但未来,要想正确分辨会变得越来越困难。

黎颢在接受CNBC采访时表示:“目前已经出现了一些确实逼真的Deepfake视频。很快,以现有方式将无法再检测出deepfake视频的地步,因此我们必须考虑其他类型的解决方案。”

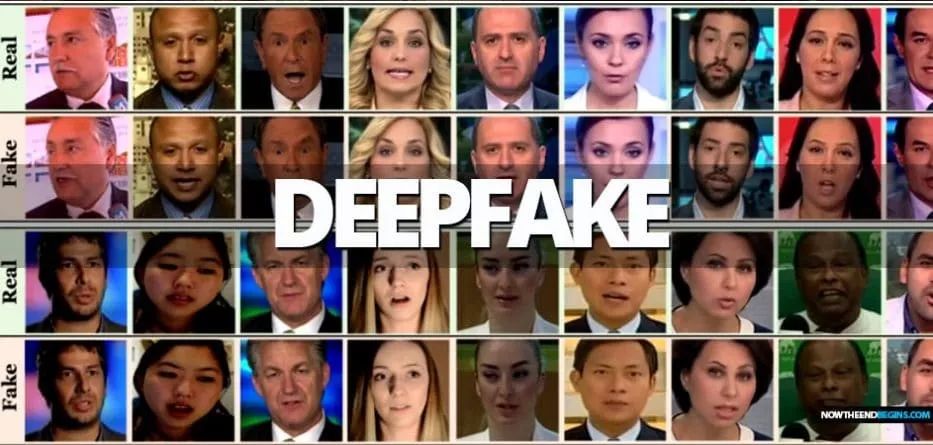

Deepfake自出现以来快速席卷互联网,该技术可以让人在原始素材上绘制别人的脸来实现修改现有视频。最早一批的Deepfake技术用在了成人电影业中(往往是将片中演员的脸换成名人的),此外还包括篡改著名政治人物的演讲视频等,从奥巴马、希拉里到特朗普、普京,一个都没能逃过。

此外,一些基于Deepfake技术的变种应用也大量涌现,最著名的如“一键脱衣”的DeepNude,用户可以使用这个应用“脱掉”图片中女性的衣服。不用说,社交媒体上对该应用一片讨伐之声,DeepNude很快下架。

前不久在中国社交网络上火成一片的“ZAO”也是Deepfake的变种。只需几张自拍照,就能和明星实现换脸,并不像传统Deepfake一样需要预处理大量图片。不过该应用的爆红同样引发了对于用户隐私数据安全性的担忧。

实际上,黎颢在参加上周MIT EmTech活动时,就曾经在看过现场生成的“普京采访”假视频后发表了自己的看法,当时他表示,Deepfake未来发展到“完全真实”的程度,还需要两到三年时间。

但随后,他就通过邮件对CNBC表示,这个时间表可能需要大大提前,我们可能会在未来6至12个月内就能做出“完全真实”的deepfake视频了。

“在某种程度上说,我们现在已经能做到了,只是如何训练数据的问题,还要考虑如何应用。”

Deepfake带来的种种问题,并不是技术本身的错,比如对于时尚和娱乐行业来说,它就具有很高的应用价值,也能明显提高视频会议的效率。今天的种种乱象,实际上是技术被恶意滥用的结果。

所以,“真正的问题是,我们如何才能鉴别那些以欺诈为目的,或者试图造成有害后果的那些视频。”黎颢说。

参考链接:

https://hothardware.com/news/perfectly-real-deepfake-videos-6-months-away

https://www.cnbc.com/2019/09/20/hao-li-perfectly-real-deepfakes-will-arrive-in-6-months-to-a-year.html

声明:本文来自新智元,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。