近日社交网络上爆红的一款换脸应用,让许多普通用户体验到了跟爱豆同框、与偶像飙戏的快乐,也因数据使用带来的问题陷入了舆论的漩涡——除了用户隐私保障,如何辨别和处理换脸应用所制造的合成照片、合成视频是新型科技产品带来的新挑战。

这也让人们开始重新关注此前 DeepFake 在全球引发的轩然大波。从生成足以以假乱真的名人不雅视频开始,很多使用者将这个“换脸神器”当成了视频造假工具,并通过社交网络将虚假信息(disinformation)传播到全世界。DeepFake 等技术的出现不仅提升了换脸的真实性,其开放源代码的方式更是降低了将该等技术滥用于虚假信息制作和传播门槛。

事实上,大约 30% 经过 AI 换脸的合成照片、合成视频是人类仅凭肉眼无法识别的,很容易被当作真实信息进行再次传播。这已成为一个亟待解决的社会性问题,面对这个问题,我们应该以及可以做些什么?

以技术防御技术,让假脸无所遁形

为了解决这个问题,学界与业界开始研究如何利用 AI 技术去反向鉴别图像、视频的真伪。AI 换脸与换脸鉴别如同一场攻防战,处于防守方的换脸鉴别想准确预测进攻方的路线,是非常困难的。

除了 DeepFake,市场上存在多种换脸技术,不同算法生成的图像结果千差万别,难以使用同一个换脸鉴别模型解决所有换脸技术的进攻。与此同时,换脸鉴别模型还需要对目前不存在、但未来可能出现的换脸技术也具有判别力,如何去预测未来换脸技术的发展方向,提前布防,也是重要课题。

目前,最常被使用的 AI 换脸算法有三种:DeepFake、FaceSwap 和 Face2Face。其中,DeepFake 基于大家所熟知的 GAN 技术,对于它所生成的脸,人类的识别率大约为75%*。FaceSwap 是一个学习重建脸部特征的深度学习算法,可以对给出的图片进行模型替换,人类对于此类换脸的识别率也是75%左右*。Face2Face 则是用其他真实的人脸去替换原本的人脸,不涉及人脸的生成,对于它制造的脸,人类的识别率只有41%*。作为目前学术界最大的合成视频数据库之一,由慕尼黑技术大学创建的 FaceForensics 数据库涵盖了经过以上三种换脸算法编辑的公开视频,以供学术研究使用。

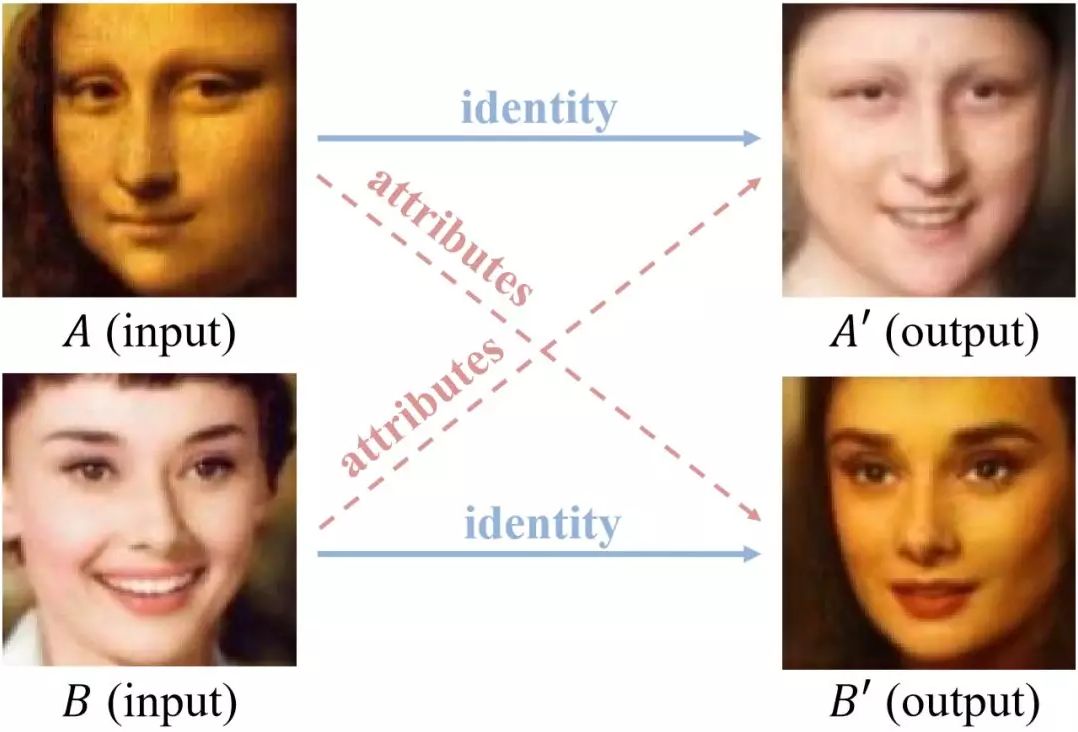

多年来,微软亚洲研究院在人脸识别、图像生成等方向都拥有业界领先的算法和模型。在 CVPR 2018上,微软亚洲研究院视觉计算组发表了论文“Towards Open-Set Identity Preserving Face Synthesis”,其中的技术能够利用开放数据集中的数据,逼真地合成保留图中人脸身份信息的图像。深厚的技术积累让研究员们对“进攻方”的技术原理有着更深刻的理解,进而能够更有针对性地研发换脸鉴别算法。

图1:微软亚洲研究院开发的模型分别提取蒙娜丽莎和赫本图片中的身份信息和属性信息进行合成

因此,微软亚洲研究院研发的换脸鉴别算法,基于 FaceForensics 数据库的测试结果均超越了人类肉眼的识别率以及此前业界的最好水平*:对于 DeepFake的识别率达到了99.87%,对于 FaceSwap 的识别率为99.66%,对于Face2Face 的识别率为99.67%。

表1:针对已知换脸算法的识别测试结果

更重要的是,一般的换脸鉴别方案需要针对每一种换脸算法研发专门的换脸鉴别模型,想要鉴别一张图像的真伪,需要逐个尝试所有模型。微软亚洲研究院的算法则可以用一个通用模型,去鉴别不同类型的换脸算法所制造的脸。与此同时,研究员还对人脸合成时难以处理的细节进行检查,如眼镜、牙齿、头发边缘、脸部轮廓,将它们作为算法关注的重点,从而提高识别准确率。相比其他同类技术,来自微软亚洲研究院的换脸鉴别算法很好地解决了应对动态幅度大、有遮挡、有表情变化的图像的难题。

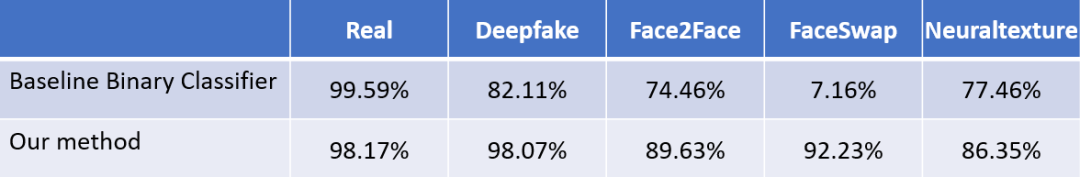

除了准确识别已知算法合成的图像,换脸鉴别的另一大挑战是应对尚未出现的新算法。将现有的换脸鉴别算法直接用于新算法时,它们的有效性往往会显著下降。为此,微软亚洲研究院提出了一种通用换脸鉴别方法。为了更好地考察这一算法对未知换脸算法的鉴别能力,研究团队用真实图像对模型进行了训练,再让其辨别多种未知换脸算法生成的图像。实验结果表明,与基线算法相比,新算法对各类换脸算法的识别率均有大幅提升。随着研究团队对模型的进一步优化,通用鉴别模型一定能越来越精确地帮助我们应对新算法所带来的问题和挑战。

表2:针对未知换脸算法的识别测试结果

当技术改变世界时,人类要承担起相应的责任

AI 技术正在给人类的工作和生活带来颠覆性变革,效率提升、成本降低、各行各业全面智能化,这些都是积极正面的影响,但类似 DeepFake 这样的技术所带来的隐私泄露、虚假信息等问题也共生共存,这也是新技术发展的必经之路。作为技术的缔造者和使用者,人类需要共同直面和应对这些难题,让 AI 技术对社会和人类福祉产生积极影响。

正如微软总裁 Brad Smith 在谈及其新书《工具与武器:数字时代的希望与危险》时所说,“如果你的技术改变了世界,你就有责任帮助世界应对这些变化。当我们深入研究这些问题时就会发现,其实大多数问题与过去有相似之处,例如广播出现时遭遇了公众反抗,相机的发明让人类担心隐私被侵犯。不同只在于今天的变化速度更快。”

图2:《工具与武器:数字时代的希望与危险》

微软研发换脸鉴别模型,是希望用技术手段去应对新技术所带来的问题,但这还不够,从更广的范围看,所有的技术开发者都应承担起相应的责任。也正是在这样的大背景下,微软强调要设计负责任和可信赖的 AI。AI 是成为助力人类的工具,还是变成攻击人类的武器,是赢得人类的信赖,还是被人类所唾弃,关键都在于利用它的人。

在微软看来,要构建可信赖的 AI,必须遵循以下六大原则:公平、可靠和安全、隐私、包容、透明、责任。微软内部还成立了人工智能伦理道德委员会(AETHER),帮助微软应对 AI 带来的伦理和社会影响。

除了技术从业者的努力,技术的社会性问题还需要新闻工作者、社会工作者、法律工作者、政府机构等不同社会角色的通力合作。

在整个社会层面构建负责任和值得信赖的 AI 并非某一家企业、一个组织能够独自完成的任务,它需要全行业乃至整个社会的共同努力,将创造技术、使用技术、管理技术以及受技术影响的人和组织汇聚在一起,才能确保最终以负责任的方式去设计 AI,真正造福人类。

*Rössler, Andreas, et al. Faceforensics++: Learning to detect manipulated facial images, 2019

声明:本文来自微软研究院AI头条,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。