作者:奇安信集团行业安全研究中心主任 裴智勇

自从2018年,张学友演唱会成为全国追逃大舞台以来,人脸识别技术就在一次又一次的刷新我们的生活认知。

在美国,马里兰州警方利用该技术确认了大规模枪击案的嫌疑人;在印度,警方利用该技术在四天内确认了近3000名失踪儿童的身份;FaceBook利用该技术为视障人士识别照片中的人物。在国内,警方首次利用人脸识别与AI技术,一次找回4名走失10年的孩子。

人脸识别技术给生活带来的遍历也是革命性的,我们不但可以刷卡支付,刷脸打卡,刷脸取快递,甚至还可以刷脸上飞机。走遍天下靠“面子”的时代似乎近在眼前。

但是,近几个月来,特别是2019年8月以来,接连发生了好几件和人脸识别技术相关的安全事件,引发公众的关注。一时间,人脸识别技术似乎正在从带来快乐,逐渐演变成带来恐慌。2019年的秋天,的确可以说是人脸识别技术的多事之秋。

本文将从换脸技术、数据交易、系统漏洞、司法实践、技术歧视和人脸欺骗等方面,结合实例进行分析和介绍,并给出一些人脸识别技术安全应用的建议。希望帮助读者更好的理解人脸识别技术应用的风险与困境,正确使用人脸识别技术。

一、换脸软件已成熟,视频真假难分辨

有一句话叫“有图有真相”。但自从有了换脸软件之后,连视频都不可信了。

2019年8月,一款名为ZAO的软件让很多国内用户了解了视频换脸这么个“好玩”的东西。类似的软件在国外已经流行了一段时间,比较有名的软件包括Deepfake等。

其实,智能换脸技术早在2017年就已经被安全工作者搬上了央视315晚会。当时的系统设计还比较简单,但已经完全可以通过人工智能技术,将一张普通的静态照片(正面、侧面都可以),转化生成一张表情生动人脸,甚至可以轻松的贴在另一个人的脸上,随着另一个人的动作和表情自动变化。

笔者当年有幸也参与了这套演示系统的设计。测试表明,即便是以当时的技术水平,也已经完全有能力骗过绝大多数人脸识别系统。但是,当时能够掌握这种技术的主要还只是一些人工智能专家。而随着换脸软件的日渐成熟,这种“骚操作”普通人也能轻易做到。

换脸技术甚至还开启了很多新型的黑灰产业。比较典型的就是“过脸产业”,也有人称之为“反人脸认证”产业。这是一种专门帮助无法完成账号实名认证的人群完成实名认证,以获取利益的黑灰产业。其业务核心就是将带有背景的人脸照片修改成动态图像,实现诸如“眨眼”、“点头”、“摇头”等动作。动态图像生成后,再打开APP的认证功能,将摄像头对准经过处理的动态图片,即可完成人脸认证。

其实,智能换脸的技术门槛比绝大多数人的想象要低得多。我们既然可以通过人工智能技术轻易的捕捉到动态的人脸,那么用人工智能技术给这张脸换一套“皮肤”,自然也不是什么难事。

我们完全有理由相信,换脸软件的出现,必将会使换脸照片、换脸视频大行其道。如果换脸操作只是开开玩笑还问题不大,但如果人用来造谣诽谤,恶意制造新闻热点,恐怕就是遗患无穷了。

当然,也有一群技术宅们不满于换脸照片、换脸视频大行其道,决心用技术手段进行对抗。2019年9月,谷歌工程师免费分享了3000多条经过后期加工的“换脸视频”样本,以期帮助研究人员给AI分析系统装上火眼金睛,打假网络视频。

二、人脸数据公开卖,人生就怕有面子

2019年9月,北京青年报报道了一起“人脸数据”公开售卖事件。记者在一家网络商城中发现,有商家公开兜售“人脸数据”,数量约17万条。在商家发布的商品信息中可以看到,这些“人脸数据”涵盖2000人的肖像,每个人约有50到100张照片。此外,每张照片搭配有一份数据文件,除了人脸的位置信息外,还有人脸的106处关键点,如眼睛、耳朵、鼻子、嘴、眉毛等的轮廓信息等。

对于很多人工智能或机器学习的研究者来说,看到这条新闻可能会不以为然。因为要进行人脸识别研究,就必须要有大量的照片素材库。同行之间经常会有偿或无偿的分享类似的“研究资料”,有人在卖似乎也不足为奇。但记者的调查却发现,很多照片素材的当事人对于自己的人脸数据被收集和交易一事完全不知情。这就让我们不得不怀疑,这些人脸数据到底是怎么来的,是怎样收集和交易的。

上面的案例并非是人脸数据被交易的个例。2019年中,有国外媒体指称:谷歌涉嫌诱骗无家可归者出售其人脸数据。媒体报道称谷歌以价值5美元的代金券引诱随机的陌生人出售人脸数据,从而训练Pixel 4的人脸识别系统。而根据《纽约每日新闻》的报道,谷歌合同工秘密地锁定无家可归者和肤色较深的人以获取数据,却没有明确告诉对方他们是这家科技巨头的人员。

相比与人脸数据交易,更加可怕的就是人脸数据的泄露。2019年2月,国外媒体报道称,国内某知名人脸识别公司发生大规模数据泄露事件。该公司此次泄露的数据包含超过250万人的信息,不仅包括人脸识别图像及捕捉地点,还包括身份证号码、地址、生日等敏感信息。

外媒CNET报道称,第一个发现此事的是GDI基金会的荷兰安全研究员Victor Gevers。该安全研究员称,他从去年7月起就曾试图联系该公司,并对其数据库泄露问题进行了警告,但该公司并未作出回应。据媒体报道,该公司是一家安防产品提供商,同时在人群智能分析、人体Re-ID(检索)、人脸识别、模糊图像处理软件产品等方面进行技术开发与销售。

客观的说,在换脸软件大行其道,刷脸应用遍地开花的时节,人脸数据倘若被大规模的交易与泄露,其中的安全隐患难以估量。对于黑产团伙或恶意的攻击者而言,有了他人的“人脸数据”,再配合上一些“打包”出售的辅助数据,就可以伪造一个人的各种视频资料,冒充他人的身份从事各种非法的网络活动,甚至完全可以通过技术手段盗刷他人的各类“刷脸账户”。

三、打印照片可取件,别人也能刷你脸

在很多人心目中,人脸、指纹、声纹、虹膜等生物特征,是自己独一无二的生物特征,是随身“携带”的最安全的通行证。这是现代社会最为严重的、错误的安全认知之一。造成这种错误认知的主要原因有两个方面:

一是早期(10-20年前)的科幻电影大量使用生物识别技术镜头来展现未来科技,以至于这些技术日渐成熟和普及之后,人们在自己的心中已经默认的给其打上了“安全”、“可信”的标签。

二是如银行、支付宝等平台很早就开始了刷脸支付的推广,使人们在感受方便的同时,误以为刷脸本身就很安全,而没有意识到,这些科技公司在推广“刷脸”的背后,有着严格的场景选取和复杂的安全保障技术。刷脸,绝不止刷脸这么简单。

2019年10月,一条“小学生破解丰巢刷脸取快递”的新闻被广为流传,引发了人们对刷脸技术安全性的广泛担忧。据媒体报道,嘉兴上外秀洲外国语学校402班科学小队的同学向都市快报《好奇实验室》报料:他们在一次课外科学实验中发现,只要用一张打印照片就能代替真人刷脸,骗过小区里的丰巢智能柜,最终取出父母们的货件。随后,都市快报的记者进行了验证,实验成功!

对于很多第一次看到这条新闻的非安全工作者来说,第一反应可能是:丰巢的人脸识别系统太弱了,连照片和真人都分辨不出来。但这种看法其实并没有抓住问题的本质。因为从前述的技术发展现状来看,即便是更高级人脸识别系统,对于真正的攻击者来说,想要突破也并没有困难多少。

事实上,从安全工作者的角度来看,人脸、指纹、声纹、虹膜等生物识别技术所识别的生物特征,本质上都是一些静态的、可复制的信息,其在本质上,和一串复杂的字符口令没有什么的区别,安全性也不会高到哪去,只是“携带”起来非常方便而已。尽管有些公司声称其产品的识别系统可以识别出真假手指,可以区分出真人和照片,那其实也不过只是增加了信息复制或模仿的难度而已,并没有从根本上改变生物特征可以被复制,且很容易被复制的本质。

仅就上述快递柜事件而言,从纯粹安全工作的视角来看,问题的关键在于:应用场景不对,或应用技术不完整。人脸识别技术如果要用于远程身份认证,需要有几个基本的要素或场景,场景之外就可能存在安全风险。

第一,绑定设备进行刷脸

如手机支付的刷脸功能,其实都是绑定手机的。你用自己的手机刷脸可以,但用别人的手机刷脸就不行。而手机绑定本身,既是一种使用场景限定,其实也是一种辅助验证方法。

第二,环境相对安全,最好有人值守

如商场、机场等环境,虽然不是人机绑定,但却都是在人工监视的环境下进行刷脸的。特别是在机场,实际上是在多道严格的安检程序之后,才会允许你刷脸登机。人工值守实际上是一种很强安保措施,你总不能当着安保人员面刷照片,刷IPAD吧。

第三,配合其他安全认证技术

其实,在“远程”身份认证的场景下,几乎所有的生物识别技术都不适合单独使用。但配合其他某些安全技术共同使用,就可能做到既方便又安全。

比如,刷脸支付,如果用户装有支付APP的手机一直在北京活动,刷脸行为却突然发生在上海,那么支付系统就应阻止验证过程被通过。这就是一个比较简单的大数据安全验证模型。在实际系统中,支付机构所使用的辅助认证技术还有很多,只不过这些安全技术是在背后默默进行的,对正常消费的消费者来说是“隐形的”,不易被感知罢了。

细说起来,人脸识别的应用场景还有很多复杂的约束条件,这里不再一一说明举例。但从上述分析可以看出,快递柜上的刷脸应用其实并不太符合人脸识别的安全应用场景。即便系统更新为高级的人脸识别系统,也仍然存在诸多安全隐患。

刷脸虽方便,但不是哪里都能用。

四、人脸识别第一案,法律争议日渐多

2019年10月,“中国人脸识别第一案”引发关注。据南方都市报报道,浙江理工大学特聘副教授郭兵不久前收到了来自杭州野生动物世界的一条短信,提示他的动物园年卡如果不进行人脸识别将无法正常使用。郭兵不同意接受人脸识别,在协商未果的情况下,于10月28日向杭州市富阳区人民法院提起了诉讼。当地法院目前已经决定正式受理此案。

案件本身的争议在于相关机构是否有权强行获取用户的人脸信息。郭兵认为,动物园强制要求游客必须进行人脸识别,违法了《消费者权益保护法》,也不符合《网络安全法》,更不符合目前正在制定的《个人信息保护法》。

从旁观者的角度看,这个事件本身似乎也不是什么大问题。但考虑到前述的各种安全风险后,我们就完全有理由为郭老师点赞。因为我们确实应该担忧:收集我们人脸信息的机构是否有能力保护我们的信息安全,他们是否能够合法、规范的使用我们的人脸信息。

其实,这种对于信息收集机构“安全能力”和“安全意愿”的担忧不仅仅适用于人脸信息,也适用于包括指纹、姓名、身份证、电话、住址、单位等所有类型的个人信息。这也是很多安全工作者反对“泛化”实名制或实名制要求扩大化的主要原因。我们可以“相对放心”的把个人信息交给公安、银行、运营商,甚至是互联网巨头,因为我们有一定的理由可以相信这些机构的安全能力和安全意愿(当然,这种信任也常常被枉费),但我们凭什么相信那些不知名小公司、小机构?我们凭什么相信一个小小的野生动物园?

实际上,关于人脸识别技术应用的司法争议,不仅在中国有,在欧美国家也有,而且争议出现的更早,争议也更加激烈。

我们以一起诉警案为例。2019年9月4日,英格兰和威尔士高等法院行政庭判决了一起关于警方使用人脸识别技术的上诉案。判决肯定了南威尔士警方使用人脸识别技术的合法性。据报道,这是世界首例关于使用自动人脸识别技术合法性的案件。

事件的原委大致是这样的:

南威尔士警方自2017年起开始试点使用自动人脸识别技术,通过监控系统进行追逃。如果系统提取的人脸特征与监控名单匹配成功,则相关的数据最多会被保留24个小时;反之,若匹配未成功,抽取的人脸识别数据和相关人员的照片则不会被存储。

应该承认,警方的方案已经具有了很强的“自我约束”性。但是,原告Edward Bridges仍然认为,南威尔士警方使用的技术方法,以及自己在场的两次试点情况,违反了欧洲人权公约、违反数据保护立法,未尽到公共部门平等职责。

虽然本案是针对公权力机关的司法审查之诉,判决也有其欧洲和普通法背景。但在人脸识别技术广泛运用的时代下,判决本身和其涉及的利益平衡、隐私和数据保护问题,所引发的思考是跨部门、跨地域的。

此外,人脸识别技术的使用过程是否合理合法,也存在诸多争议。

例如,有研究发现,美国纽约警察局的工作人员在将图像输入系统之前,会故意对图像进行处理。他们通常会把某些图像粘贴在眼睛或嘴巴上,以使图像符合系统的标准。这种做法的合法性及其产生结果的有效性,显然都是值得探讨的。

而在一个特别令人震惊的案件中,警方实际上使用了演员伍迪·哈里森(Woody Harrelson)的照片来追踪嫌疑人。因为根据一名目击者的说法,行凶者看起来像哈里森。显然,这种不太“严谨”技术方法可能造成大量的误识别,从而给守法公民的生活带来干扰。

在可以预见的未来,与人脸识别相关的司法争议只会越来越多。

五、肤色太黑易误判,人脸识别有歧视

人类社会存在歧视,而人脸识别技术也有可能存在歧视。这的确有点让人意外。产生技术歧视的原因可能是“人为的”,但绝对不是“故意的”。

2019年 1 月,多伦多大学研究人员 Inioluwa Deborah Raji 和麻省理工学院媒体实验室研究员 Joy Buolamwini 发表了一份研究,指出亚马逊的一套人脸识别系统 Rekognition,分类肤色较深的女性比分类肤色较浅的男性,有更高的错误率:19%的女性会被误认为男性,而皮肤较黑的女性则有 31%的概率被误认为是男性。而早前,更有测试表明,在警方使用的Rekognition系统中,有近40%的错误匹配涉及有色人种。

2019年6月,全美最大的警用穿戴式摄像头制造商Axon正式宣布,在技术改进之前,不会在其警用穿戴式摄像头中使用面部识别技术。事件的导火索是一份长达28页的研究报告《Axon AI &警务技术伦理委员会第一份报告》。报告指出,该公司当前的人脸识别技术对于种族,性别和其他身份群体的表现不平等且不可靠。这项技术对有色人种不那么友好,对女性比男性更友好,对年轻人比老年人更友好。

导致人脸识别技术存在歧视性结果的原因,可能并不是源自人类之间的相互歧视,而是源自人工智能的学习过程不完备,或者是学习样本的不均衡。而一旦有歧视性的系统被应用于实践,特别是用于警务实践,就有可能导致某些人群的犯罪更容易发现和监控,而另一些人群的犯罪则可能被“技术性”忽视,从而加剧现实世界的“群体歧视”。这个问题在国内还不太敏感,但在欧美国家,确实是一件了不得的大事。

六、人脸识别易欺骗,眼镜变装能隐身

一些最新的研究成果,也使我们对人脸识别技术在监控领域的应用产生了怀疑。

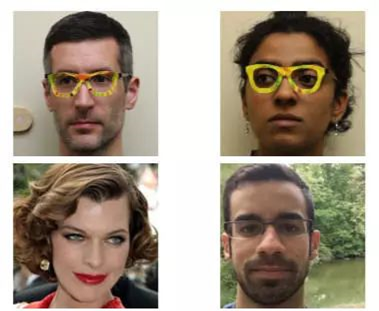

实验表明,我们通过一些简单的面部装扮,如给脸上点几颗青春痘,或者带上特制形状的眼镜,再或者是在脸上画些符号(如画国旗、吉祥物等),就完全有可能使人脸识别系统把一个人认成另一个人,或者是完全捕捉不到视频中的人脸,从而使这些经过装扮的人在镜头前“隐身”。此外,人的衣服和动作,也有可能干扰识别系统对目标属性的判断。

人会看错眼,机器也会看错。相比之下,欺骗机器更容易,起码在现阶段就是如此。

此前,国内曾经发生过这样一个事件:某知名互联网公司拿着一个人工智能机器人去参加某挡知名电视节目,让机器人和人类高手比赛识别照片中的双胞胎,结果是机器人赢了。如此看来,国内的人工智能人脸识别技术似乎已经远远超越了Google、亚马逊、Axon等欧美公司。毕竟,如前所述,他们人脸识别技术有时连男人和女人都分不清楚,而我们连双胞胎都能分清楚,显然是我们更胜一筹。但愿事实如此吧!

让人脸识别技术在正途上奔跑

前述所有的问题,都引向一个基本的结论:单纯的人脸识别技术似乎不太可靠,人脸数据正在成为攻击者的新宠。那么,人脸识别技术到底有没有未来呢?这里仅就作者的理解,提出几点简单的建议。

第一,安全级别要求较高的网络系统,尽量不要使用人脸识别技术,最起码不要把人脸识别作为唯一的认证手段。

第二,刷脸业务大有前途,但系统的设计者应当充分的考虑应用场景的科学性,同时将刷脸技术与其他安全认证技术配合使用。只有这样才有可能做到即方便又安全。

第三,将人脸识别技术用于监控或追逃时,应充分考虑非目标群体的隐私保护,同时,充分认知该技术在现阶段的局限性,不能盲目依赖,要做到多线索追踪和多源取证。

第四,作为普通公民,应当认识到,自己分享的每一张照片,都存在被非法利用的可能性。一旦遭遇人脸信息被冒名、被恶搞的情况,应及时向公安机关进行举报,维护自己的合法权益。

声明:本文来自奇安信集团,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。