“谎言飞奔,真理跛行其后。” 乔纳森·斯威夫特曾经写道。

这虽然是三个世纪前的夸张描述,但前不久《科学》杂志上MIT发表的一项研究显示,这就是对社交媒体的真实写照。

这项大规模的新研究名为《网络中真实与虚假信息的传播(The Spread of True and False Information Online)》,分析了Twitter面世以来所有有争议的新闻报道,即数年来被300万用户转发过的12.6万条新闻,最终发现: 事实根本无法对抗谎言和谣言。 无论按哪种评判标准,在Twitter上虚假新闻总是战胜事实,占据主导地位。该研究发现, 相比准确报道,假新闻和谣言在社交网络上总能触及更多人群、渗透更深,并且传播更快。

MIT的科研人员Soroush Vosoughi,从2013年就一直研究假新闻,这次主持了这项研究。他提到,“从我们的研究中可以清楚看到,虚假信息的传播远超真实信息… 这不仅仅是机器人的原因,还可能与人性有关。”

The Spread of True and False Information Online项目的两名研究人员

研究缘起“私心”

波士顿马拉松爆炸案中的信息混乱

过去,研究人员调查网上传播的虚假信息时一直专注于单一事件中的谣言传播 ,比如2012年发现希格斯玻色子前的猜测、2010年海地地震后的谣言。 而这篇新的论文涉及的范围要大得多,几乎涵盖Twitter整个生存时期 ,即从2006年9月到2016年12月,在Twitter上传播的每条争议性新闻。但是要做到这一点,Vosoughi和他的同事不得不先回答一个更基础的问题: 什么是真相?我们如何得知?

这是一个至关重要的问题。

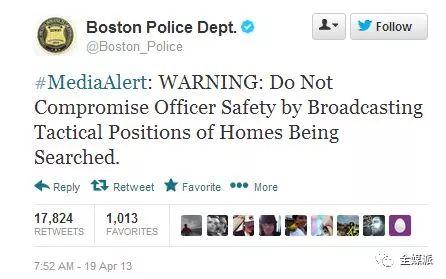

该项新研究的作者之一、MIT的媒体科学家Deb Roy谈道,“(假新闻)已经是一个白热化的政治、现实和文化话题,但我们研究它的缘起,还是五年前波士顿袭击中的一系列个人事件。”

2013年4月15日,两枚炸弹在波士顿马拉松跑道附近爆炸,造成3人死亡,数百人受伤。顷刻之间,关于爆炸事件的阴谋论疯狂占据了Twitter和其他社交媒体平台。4月19日,当马萨诸塞州州长要求数百人在警方大规模搜捕时留在家中,网上的信息变得更加混乱。

“我和妻子孩子呆在Belmont的家中两天,Soroush Vosoughi(Roy的学生)也困在Cambridge。”Roy回忆。被困在屋里,Twitter成为他们与外部世界联系的通道,使用这个渠道让他们“听到了很多不真实的事情,也知道有些事情最终被证实为真”。

磨难很快结束了。Vosoughi在那之后成为专门研究社交媒体的博士,但对当时的他而言,研究刚刚切身经历的这一切,看起来似乎非常荒唐。他的导师Roy,也默默地为这个项目祈祷。

随后,Vosoughi制作了一个真相机器,即一种 可以将各种推文分类,并且挑出最接近准确事实的算法。

它关注的是一条推文的三个属性:博主的属性(是否经认证);使用的语言类型(是否复杂);给定推文如何通过网络传播。

Roy说,“Vosoughi开发的模型,能够以远高于概率的表现,来预测内容的准确性。”而Vosoughi也在2015年获得了自己的博士学位。

研究深入

虚假信息传播惊人、机器人角色有待考量

在那之后,Roy和Vosoughi,再加上MIT管理学教授Sinan Aral,开始研究Twitter上的虚假信息如何传播。他们不仅要回答“什么是真相”,也要解答一个更加迫切的问题: 计算机如何知道什么是真相?

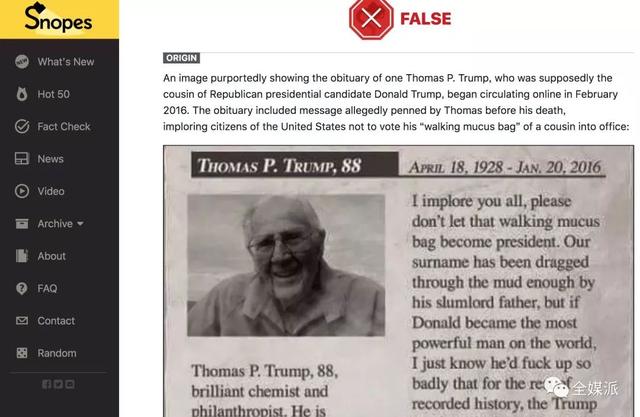

他们选择向网络上的最终事实裁断者求助,即 第三方事实核查网站 。通过搜集和分析6家不同的事实核查网站(包括Snopes、Politifact和FactCheck.org),他们生成了一份 从2006年到2016年在Twitter上传播量上万的网络谣言名单 。然后,通过社交网络Gnip的专有搜索引擎,在Twitter上搜索这些谣言。

最终,他们找到了12.6万条一共被转发过450万次的推文。 有些推文会链接到其他网络上的假新闻,有些则是原生推文,或利用制作图片生产谣言 (该团队使用OCR,可以搜索静态推文图片中的文字),还有一些混杂了真实信息或能链接到其他网站上。

Optical Character Recognition,光学字符识别,视频来源于OCR的维基百科

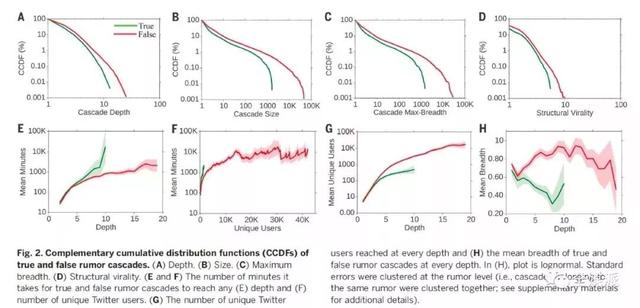

虚假信息传播更具速度与深度

然后他们进行了一系列分析,对比了虚假谣言的流行与真实新闻的流行,得到一个惊人的发现。

在MIT的演讲上,Vosoughi举了一个例子: 一条推文有很多办法获得1万次转发。

如果一个名人发了推文A,并且拥有几百万粉丝,那么可能会有1万人在他们的时间轴上看到推文A,并决定转发它。推文A被广播时, 规模大、层次浅。

与此同时,一个仅有少量粉丝的人发了推文B。B被推到20个粉丝的时间线上,被某个人看见并转发,然后其中一个的粉丝又看到并转发, 一个接一个,直到上万人看到并转发了推文B。

推文A和推文B其实有着同等规模的用户,但是以Vosoughi的说法, 推文B更具“深度”。它将转发链接了起来,以一种推文A做不到的方式进行病毒式传播。 “它可以达到1000次转发,但拥有各异的形态。”他说道。

关键在于,在这两种传播方式中,假新闻的传播始终占据主导地位。 它始终能吸引到更多的受众,并且比真实新闻更能深入到社交网络的毛细血管中。 作者发现,准确信息往往不能到达10层以上的转发,而假新闻可以达到19层,速度上也比获得10个转发的准确新闻快10倍。

即便是由人类而非机器人检测时,这些研究成果也是很可靠的。在主要调查之外,还有一组本科生协助核查了同一时期约 1.3万条英语推文的随机内容。 研究发现, 虚假信息的传播速度以“相当类似”于主数据集的方式,超越真实信息的传播。

这在现实生活中看起来是什么样子?以上次总统选举为例,2015年8月在社交网络散布的一则传言称,特朗普让一个生病的孩子坐他的飞机,获得紧急救治。Snopes(著名事实核查网站)证实故事大体属实,然而据其团队估计,只有1300人分享或转发了这个故事。

Snopes核查结果

还有2016年2月,有传言称特朗普的表兄最近去世,在其讣告中还反对了这位大亨的总统竞选。据报道,讣告中是这么写的,“作为特朗普家族中骄傲的一员,我恳求你们大家不要让那个行走的黏液包成为总统。”但是Snopes没有查证到这位表兄或其讣告的存在,最终认为这个故事是假的。

尽管如此, 还是有大约3.8万名Twitter用户分享了这个故事。 它的转发链接长度是病孩子故事的三倍。就连宣称拳击手Floyd Mayweather戴了一条穆斯林头巾去特朗普集会的虚假报道,吸引的用户数也比病孩子故事多10倍。

为什么虚假信息会有这么好的传播效果?MIT团队采用了两种假设。

一是假新闻似乎比真实新闻更“传奇”。 该团队发现,虚假信息通常与用户转发前60天内时间线上的所有推文都明显不同。

二是假新闻比一般推文能激发更多情绪。 研究人员以Twitter用户 用来回复12.6万条有争议推文的字词 创建了一个数据库,然后用先进的情感分析工具NRC-Canada系统对其进行分析。他们发现, 虚假推文往往引出带有“惊喜”和“厌恶”相关的词语回复,而准确的推文则更多地引发与“悲伤”和“信任”相关的词语。

机器人的作用有限

这个团队还希望能够再解答一个问题:Twitter机器人是否助力传播假消息?

在300万Twitter用户样本上使用两种不同的机器人检测算法之后,他们发现自动机器人确实在传播假新闻,但他们转假新闻的速度和转准确信息的速度一样。 “在Twitter上真实新闻和虚假新闻传播的巨大差异,不能用机器人的存在解释。” Aral说道。

但一些政治学家警告说, 这不应该被用来消解俄罗斯机器人散播假消息方面的作用。 据《纽约时报》报道,佛罗里达州帕克兰校园枪击案发生后,一群与俄罗斯有关的机器人“军队”助长了分裂性言论的传播。

乔治华盛顿大学的政治学家Dave Karpf在邮件中提到,“这可能有两种情况: (1)在整整10年的数据集中,机器人不喜欢虚假宣传;(2)在近期的案例子集中,僵尸网络已经被战略性地用于传播虚假宣传信息。 ”他还说道,“我猜测这篇论文会成为‘机器人真的不碍事’的科学证据。如果我们纵览Twitter存在的整个时期,这篇论文也的确证实了这一点。但是,关于机器人的口水战中,它的假设在于,目前对‘机器人传播假新闻’已经倾斜了战略性的资源,导致机器人的使用面如此之广。 这篇论文没法反驳这种假设。 ”

对此,Vosoughi表示同意:2016年选举中僵尸网络的使用是否有变化,他的论文确实不能作出判断。 “我们没有研究机器人角色在不同时期的变化,” 他在一封邮件中写道,“这是个有趣的问题,我们未来的研究中很可能会关注到。”

研究的部分质疑与不足

假新闻定义、无争议新闻、新闻与内容的差异

一些政治学家也质疑了该研究 对“新闻(news)”的定义。 通过求助事实核查网站,该研究 模糊了虚假信息的边缘 ,即包括彻头彻尾的谎言、都市传奇、恶作剧、恶搞、谎言和假新闻。它不止是研究假新闻本身,也研究类似新闻内容的文章或视频,以及看似通过新闻生产流程出来 但实际为编造的内容。

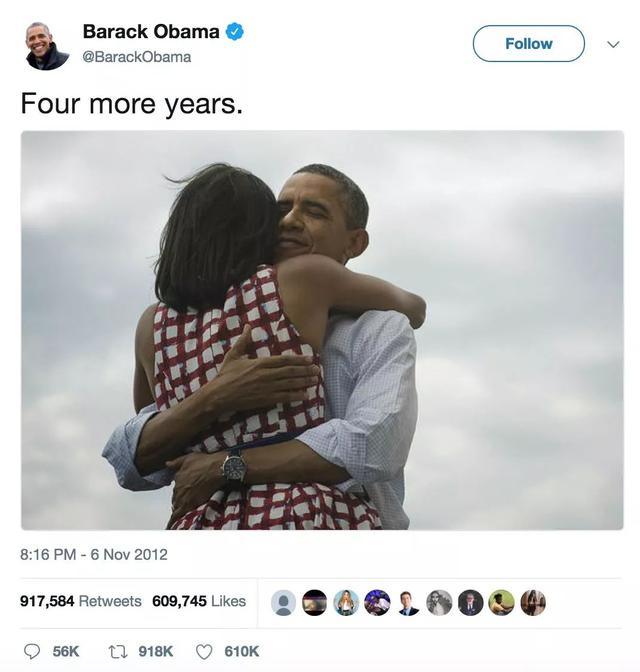

因此, 这项研究可能低估了“无争议的新闻(non-contested news)”,即被广泛认知为真实的准确新闻。 多年来,Twitter历史上被转发最多的帖子就是庆祝奥巴马再次当选总统。但是,由于他的“庆祝”并不是一个广受争议的事件,所以Snopes和其他事实核查网站也从未去证实这一点。

该研究还忽视了 内容(content)和新闻(news)的差异性。 “我们所有的用户研究都表明,绝大多数用户都认为新闻和更广义上的内容是截然不同的,”牛津大学的教授Rasmus Kleis Nielsen在邮件中写道,“‘非真实内容(包括谣言)’在Twitter上比‘真实内容’传播更快,和‘假新闻’和‘真实新闻’以不同速度传播,两者表述还是有些不同的。”

“关键结论在于, 激发强烈情绪的内容会在Twitter上传播得更远、更快、更深入和更广泛 ,”荷兰莱顿大学政治学教授Rebekah Tromble说道,“这个特殊的发现,和很多不同地区的研究(包含心理学和传播学研究)具有一致性。这也是相对直观的。”

“网上的虚假信息是非常新奇的,而且经常很负面。”达特茅斯学院政府学教授Brendan Nyhan说道,“我们知道,这是信息通常吸引人类注意力的两个特性, 它会让我们想要与他人分享这一信息——我们关注新的威胁,尤其关注负面威胁。 ”他还补充道,“当你不去管这件事是真是假,就会很容易受这两种特性影响。这不过是心理学的把戏,人类总是会轻易地被利用。”

研究适用性

我们如何应对虚假信息的传播?

Nyhan称赞Twitter将数据提供给研究人员,也呼吁其他主流平台如Facebook也这么做。“对研究而言,这几个平台就是全部的探索领域。我们有很多东西需要学习, 但是如果没有平台的合作和协作,我们能够研究的又会受到很大限制 。”他说。

“在人们获取新闻这方面,这些公司有很大的权力和影响力。虽然平台拥有巨大权力,但这也同时意味着,他们必须面对大量的审查,并且保持透明。”Nyhan继续说道,“我们可以整天研究Twitter,但目前只有约12%的美国人在使用它。它对记者和学者来说很重要, 但并不是大多数人获取新闻的方式。”

Twitter在一份声明中表示,它希望拓展与外部专家的合作。公司CEO Jack Dorsey在前不久发布的一系列推文中提到, 公司希望“增进公众对话的健康性、开放性和文明性,并且希望能承担责任,推动进步”。

但是,Facebook没有对此作出回应。政治学教授Tromble认为,这些发现也很可能适用于Facebook。“今年早些时候,Facebook宣布会重组新闻推送(News Feed),来提供更有意义的内容。”她说道。

Tromble继续补充,“很明显他们会根据互动量来衡量什么叫‘有意义的交互’。但是正如这项研究所揭示的,这只会进一步刺激虚假信息的传播,还有那些挑动情绪的内容也是。”

“作为一个保守科学家,我不想说这对其他社交网络也适用,毕竟我们只研究了Twitter。”其中一位研究者Aral说道,“但是我的直觉是, 这些发现整体上是适用于社交媒体平台的。 如果你使用Facebook的数据,也可以进行同样的研究。”

出乎意料的研究发现

分享准确信息的用户更受欢迎

然而,这些发现并不是这项研究中最令人意想不到的部分。当他们刚开始研究的时候,MIT团队预想, 那些分享最多假新闻的用户将会受大众欢迎。 他们猜想会找到一群以有偏见或耸人听闻的方式而痴迷于Twitter的人,他们的粉丝和追随者会比那些追寻事实的同龄人更多。

事实上,研究团队的发现正好相反。分享准确信息的用户,比假新闻分享者拥有更多的关注者,并且日常发布更多的推文。 这些事实导向的用户在Twitter上呆了更长时间,更有可能获得认证。简而言之,最值得信赖的用户拥有所有明显的结构优势,Twitter无论作为公司或社区,都可以给其用户带来这种优势。

换言之,真相起跑很快,但不知何故,不准确的信息还是会赢下这场赛跑。 “尽管用户之间存在差异,但虚假信息会比真相传播得更广更快,而这些差异并不是原因。”作者们写道。

这一发现,应该会让每个求助于社交媒体寻找或发布准确信息的用户感到沮丧。它表明,无论人们多么小心地使用Twitter,无论他们多么精心地管理信息流或关注可靠来源, 他们仍然有可能在当前的激烈竞争中被虚假信息所欺骗。

在每个用户都是读者、作者和媒体的平台上,虚假信息太诱人,很难不成功骗你入局: 新奇的刺激太诱人,厌恶的煽动太难无视。 在经历了漫长而恼人的一天之后,即使是最沉稳的用户,也会发现自己在为某些政治谣言而疯狂;身处一个焦虑的选举季中,即使是最具公民意识的用户,也可能会损坏自己更长远的利益,只为在一场争论中获胜。

目前,尚不清楚有哪些干预措施可以扭转这种倒向虚假的趋势。 “我们还不知道什么措施有效,什么不可行,”Aral说道。例如,目前很少有证据表明, 人们会因为他们看到事实核查网站否定了自己相信的事物,就改变自己的观点。 就算在社交网络或搜索引擎上贴上假新闻标签,可能也无法阻止它。

总之,社交媒体似乎是在 以事实为代价,系统性地强化虚假信息传播 ,而且无论是专家、政客还是科技公司,都没有人知道如何扭转这种趋势。对于任何一个以公共真实为前提的政府体系来说,这都是一个危险的时刻。

研究成果靠谱

学界一边鼓掌,一边警醒

这项研究,目前已经引起社会学家的警惕 。一个由16位政治学家和法律学者组成的团队也在《科学》杂志的同一期上发表了文章,其中写道,“在21世纪,我们必须重新设计信息生态系统。”他们呼吁进行新的跨学科研究,来“减少假新闻的传播并解决它所隐含的潜在问题”。

“我们要如何创建一个利于事实传播的新闻生态系统? ”这些学者提出了这样一个问题,但这绝非易事。尽管Vosoughi团队仅仅研究了Twitter(因为采用的是该公司提供给MIT的独家数据),但他们的成果对Facebook、YouTube等主流社交媒体均有启发,毕竟任何蹭热点抢流量的平台,都有强化假新闻传播的风险。

虽然这项研究是以统计学的专业语言写成,但它对这些平台上信息传播的准确性提供了有条理的控诉。作者发现,一则虚假新闻会比一则真实报道更可能进行病毒式传播。 平均下来,一则假新闻传播给1500人的速度要比真实信息快6倍。虽然假新闻在每个主题上的传播表现都超过事实,包括商业、恐怖主义和战争、科技、娱乐,但虚假政治新闻往往是最突出的。

另外,Twitter用户似乎更乐意分享虚假信息。尽管研究者控制了生产谣言账号之间的每一个差异因素,比如用户是否拥有更多粉丝或被认证,但假新闻获得转发的可能性仍比准确报道多了70%。

这个问题不能归咎于机器人。从2006年到2016年,Twitter机器人强化真实报道传播的效果和强化虚假新闻传播是一样的。作者写道, 假新闻猖狂是“因为人类更有可能传播它们,而不是机器人。”

政治学家和社交媒体研究人员对这项研究大加赞赏, 称其对社交网络上的假新闻问题进行了迄今为止最广泛和最严格的调查。 尽管也有一些人对研究结果中的机器人部分和其对假新闻的定义提出质疑。

牛津大学的Nielsen在邮件中写道,“这真的是一个很有趣的研究,假消息如何比真内容传播得更广更快,在其研究样本内看起来都非常有力、具备一致性,并且也有足够争取支撑。”

“我认为这是一项非常严谨和重要的研究。”Nyhan说道,“我们需要更多这样优秀的研究。”荷兰莱顿大学政治学教授Rebekah Tromble也在邮件中说道, “简而言之,我认为没有任何理由质疑这项研究的成果。”

参考:

https://www.theatlantic.com/technology/archive/2018/03/largest-study-ever-fake-news-mit-twitter/555104/

https://techcrunch.com/2018/03/08/false-news-spreads-faster-than-truth-online-thanks-to-human-nature/

http://www.niemanlab.org/2018/03/fear-surprise-and-disgust-why-fake-news-spreads-faster-than-real-news-on-twitter/

https://www.poynter.org/news/six-key-points-eu-commissions-new-report-disinformation

声明:本文来自全媒派,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。