来源:隐私计算联盟成员-洞见智慧科技有限公司(洞见科技)

作者:何浩,王湾湾,强锋

[摘要]互联网大数据价值的日益凸显与数据隐私保护诉求激增之间的矛盾促进了隐私计算技术的蓬勃发展,并且在银行、保险等金融科技领域取得了多场景应用探索的成果。本文分别从联合建模中去除可信第三方和匿踪查询中引入可信第三方两个方面来探讨可信第三方在隐私计算技术应用时的必要性。

[关键字]金融科技 隐私计算 可信第三方

1. 隐私计算在金融领域中的典型应用

近年来,随着大数据与人工智能技术在各行各业的广泛应用,“数据”作为新型生产要素的重要性急剧上升。同时,反复出现的数据安全与隐私泄露问题也愈发被大众关注,数据使用与隐私保护之间的矛盾日益突出。隐私数据的收集与使用曾一度处于灰色地带,但随着近几年国内外一系列数据安全与隐私保护相关政策法规的出台,以往的粗放式数据收集、使用与交易模式将被严格规范和限制。

在这样的行业背景下,如何在合法合规的前提下既能保护数据安全与隐私、又能促进数据流通与共享成为重要的研究方向。

基于计算机、通信、数学、密码学等多学科交叉的隐私保护计算(Privacy-Preserving Computing,简称“隐私计算”)技术为解决上述矛盾提供了可能。其中,联邦学习(Federated Learning,FL)和安全多方计算(secure Multi-Party Computing,MPC)等代表性技术,能够将数据从逻辑上拆分为可见的具体信息部分和不可见的计算价值部分,从而在满足“数据可用不可见”的情况下,实现多方数据的协同计算和价值共享。

隐私计算技术的应用前景十分广泛,如金融、保险、政务、医疗、支付、征信等,其中金融保险场景因为对于多方数据的需求最为强烈,并且属于被强监管行业,所以成为了当前隐私计算技术应用探索最为活跃的领域,特别是在风控建模、精准营销、反欺诈这几个业务环节。

隐私计算与风控建模

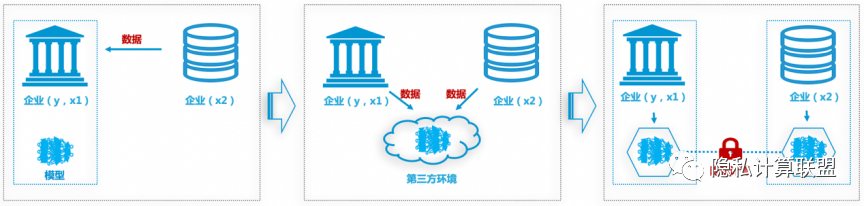

建立精准的信贷风控模型可以提高金融机构的审批效率,降低人工成本,减少由于非客观判断原因造成的失误风险。以消费信贷场景为例,目前银行、互联网金融、消费金融等机构建立智能风控模型往往需要结合身份、学历、消费、通信、征信等多种外部数据。在传统的联合建模方式中,样本数据需要被归集到某一方或第三方特定环境中,在这个过程中,多方数据有脱离私域的安全合规风险,而通过直接的联邦学习或基于安全多方计算的机器学习,就可以在各方数据不出私域的条件下通过分布式的协同加密计算实现联合建模,并且还能保障模型不泄露、质量无损耗。

图1 联合建模的方式演变

隐私计算与精准营销

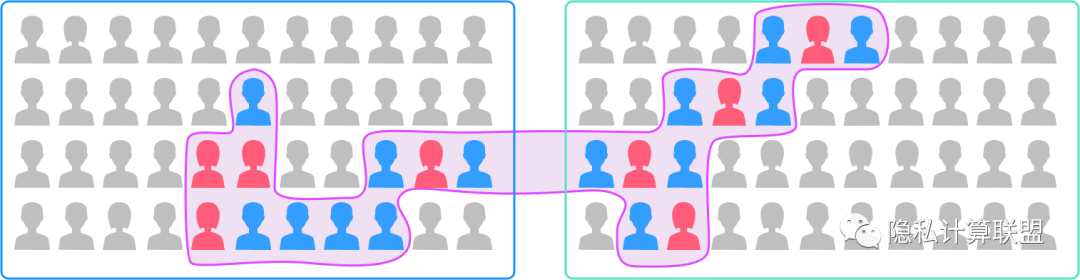

新客营销和存客激活也是金融、保险等机构的核心业务诉求之一。在精准营销业务中,往往需要结合用户的碎片化网络行为数据补全画像、识别客户意愿,所以需要联合外部数据合作方建立精准的营销规则或模型,从而提升ROI。传统联合营销规则或模型的建立,往往基于数据查询或离线撞库,因此多方数据有脱离私域的安全风险,而利用隐私求交、隐私求并、隐私求差等隐私保护集合运算技术,结合匿踪查询、切片式用户画像规则引擎,能够在金融机构与外部多个数据合作方之间实现在线的安全撞库、人群圈定等营销策略的制定与实施,既不会泄露各方数据隐私,并且还能保障数据使用方的营销规则与模型不泄露。

图2 基于隐私保护集合运算的用户群体圈定

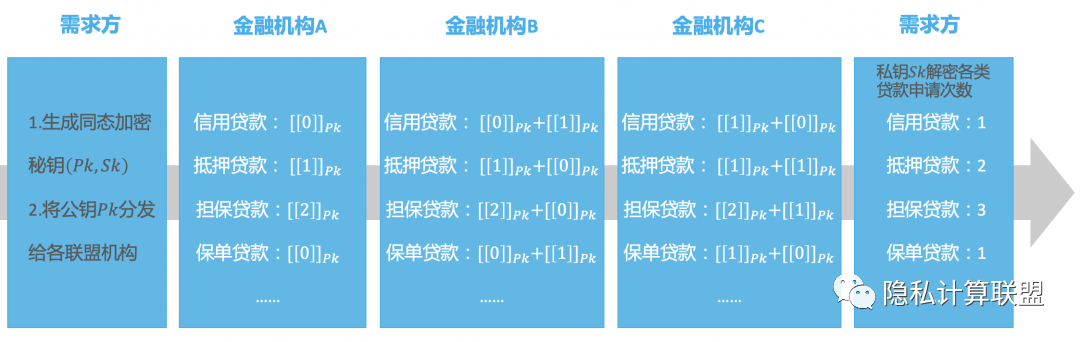

隐私计算与反欺诈

反欺诈是金融风控的重要环节,信贷业务往往面临着多种欺诈行为,例如伪造身份、盗刷、骗贷等,保险机构也面临着骗保等欺诈行为。最简单和最常用的反欺诈方法就是黑名单共享和多头借贷信息共享,但出于隐私保护和商业保密等原因,各金融机构并不情愿将上述信息主动归集于某个平台,但是使用隐私计算技术(以同态加密方案为例,见下图)就可以实现在各方数据隐私不出私域的前提下完成风险信息共享,并且还可以保护请求数据和响应数据不被第三方缓存。

图3 基于同态加密的风险信息共享方案

2. 隐私计算中的可信第三方

隐私计算的核心逻辑是通过数学原理、密码学原理建立技术保障机制,让多个数据参与方在技术信任的共识下开展协同计算,形成高阶数据智能。从安全角度,任何第三方机构的介入,都会打破技术信任的完整性,从而引入不确定因子。

然而,联邦学习作为隐私计算的代表性技术之一,其典型算法中常常需要有可信第三方(Trusted Third Party,有时也称协调方)存在。

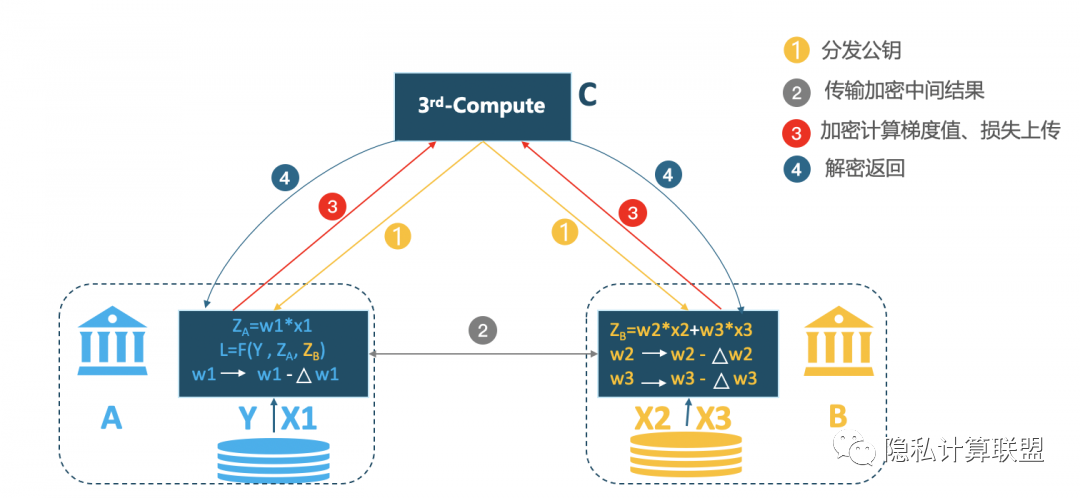

以金融风控建模常用的回归算法为例,数据集是按特征维度纵向切分分布在不同企业,其中一方具有标签数据(即Y值),且各方都是诚实并好奇的。基于典型联邦学习算法的建模训练步骤可划分为以下关键4步:

1)第三方生成公私钥对,并将公钥分发给数据提供的参与方;

2)数据提供方之间利用公钥加密中间计算结果并交互传输,完成梯度和损失的计算;

3)数据提供方将各自加密结果上传给第三方;

4)第三方返回解密结果,数据提供方开始下一轮迭代训练。

图4 有第三方的联邦学习方案

从整个训练流程可以看出,第三方承担着生成公私钥对、分发公钥、解密被加密结果等角色,因此额外获得了一些计算相关信息,这些信息是否会暴露其他参与方的数据隐私,与算法本身的结构有关。但是,如果此第三方与任何参与方勾结作弊,就很可能会导致数据隐私泄漏和模型暴露。所以,必须要保证此第三方是绝对诚实可信的,才能保障数据隐私安全。

去可信第三方的联邦学习

如何解决第三方可信风险问题,是隐私计算在金融领域落地应用的新挑战。我们研究了至少两种技术方案,其中一种基于MPC协议。MPC协议在理论上只需要计算参与方之间的信息交互,不需要第三方介入,因此可以在MPC基础算子和函数算子之上实现协同机器学习,达成联邦学习效果,并规避第三方可信风险问题。但是,受限于MPC协议的复杂度和性能瓶颈,基于MPC的无可信第三方联邦学习方案所消耗的系统资源和通信复杂度相比典型联邦学习算法有很大的提高。

此外,我们还研究了一种全新的无第三方联邦学习(Non-Third Party Federated Learning,NTP-FL)方案。仍以回归算法为例,如图所示,NTP-FL从机器学习算法的数学原理出发,通过改变数学公式的解构方式及中间计算结果的交互流程去除了第三方存在的必要性,并且在计算梯度和损失函数过程中,通过加密和随机混淆算法,来进一步保证数据安全,特别是梯度信息安全。NTP-FL不但能够实现无第三方的协同机器学习,而且还能保留典型联邦学习算法架构的诸多优势特点,更适合金融风控联合建模的实际需求。

另外,NTP-FL还能克服典型联邦学习算法在计算损失函数时对数据拥有方数量的局限,增强算法延展性,并进一步降低密文计算和密文通信次数,提高计算效率,使其在计算性能方面的优势更加突出。

图5 无第三方的联邦学习方案

加可信第三方的匿踪查询

去除隐私计算中的第三方,能够提升整个系统的安全性和增强各计算参与方之间的信任度,但是在一些特定应用场景中,可信第三方又有其特定价值。

以银行信贷场景中的外部数据查询场景为例,当银行向外部数据源机构或数据流转服务机构发起查询时,传统模式下的数据源方或数据流转服务方会对银行查询条件中的用户身份信息(例如姓名、身份证、手机号)进行匹配,并返回对应的查询结果,这时数据源方或数据流转服务方就有机会获知银行方查询条件中的用户身份信息,并推测出该用户是银行哪些业务场景的目标客户,从技术逻辑上存在非法缓存甚至再次使用这些信息的可能。

隐私计算中的匿踪查询技术能够基于非对称加密、不经意传输等密码学技术,构建出多方查询时的数据交互加密通信通道,在整个查询交互过程中进行数据混淆、数据加密、数据传输、数据解密及精准匹配,从而让数据源方和数据流转服务方无从准确知晓银行方查询条件中的用户身份信息,而银行方也无法获知除预期查询结果返回信息以外的其余信息,达到数据隐私保护、避免数据缓存等目的。

图6 匿踪查询中的不经意传输

然而,在匿踪查询技术的实际应用中,对数据查询结果的精准计费却是一个现实难题。匿踪查询与传统的数据服务接口调用不同,数据提供者并不知道数据使用者的目标查询结果,因此在查得计费的情况下,难以对数据的真实使用情况进行精确计费,往往需要依靠查得命中率的历史经验数据进行模糊计费。

为了解决上述精确计费的问题,可以通过引入“可信第三方”,在保证各方数据隐私安全的前提下,对匿踪查询中的数据匹配费用精确计量。

图7 基于可信第三方的匿踪查询计费

● 数据使用方和数据提供方之间完成匿踪查询的数据混淆、结果候选集查询、秘钥生成和结果解密流程;

● 数据提供方将加密后的候选集结果返回给数据使用方之外,同时将候选集结果发送给双方共同指定的计费目的可信第三方;

● 数据使用方在完成秘钥生成流程后,将本轮次匿踪查询的动态秘钥发送给可信第三方;

● 可信第三方使用数据使用方的秘钥,对数据提供者的结果候选集进行解密,并按照三方约定的计费规则进行费用的精确计算;

● 数据使用者和数据提供者均不把被查询主体身份信息和混淆集发送给可信第三方,所以无隐私信息(被查询主体身份信息)泄露风险。

在此方案中,引入可信第三方能够解决匿踪查询中查得计费的业务难题,同时通过各参与方对查询信息的哈希签名来对可信第三方接收信息的正确性和完整性进行验证,确保计费逻辑的完备执行。但是,随着匿踪查询数量的持续增加,用于计费统计的查询结果集中的一些群体统计特征仍有可能暴露给可信第三方。

3. 可信第三方的应用总结

可信第三方的出现来源于算法技术的演进和业务场景落地的实际需求,是金融领域隐私保护技术发展的产物:

● 从技术上讲,无可信第三方是达成技术信任的更优方式。我们可以通过改变底层计算协议,或者通过特殊的数学解构算法设计秘钥交互的流程、加解密的操作等来实现去除可信第三方的需要,在数学和密码学原理上保证无需可信第三方仍然能够完成联邦学习等隐私计算,同时还能保证足够高的安全性强度;

● 从业务上讲,以银行为代表的金融机构一方面期望在监管允许范围内,以更低的信任代价、更安全和更高效的方式使用联邦学习等隐私计算技术,因此对于无可信第三方的技术方案有迫切诉求;另一方面,为了解决传统匿踪查询方案带来的计费难题,有时仍需引入可信第三方来保证场景落地时能够满足商务合作的现实要求。

综上所述,金融领域隐私计算中可信第三方的存在必要性,目前仍取决于金融应用场景中的具体需求,隐私计算技术解决方案只有面向业务场景特点不断深化迭代,才能取得更广泛的实际应用。【本文仅代表作者观点,不代表联盟观点】

作者介绍:

何浩,洞见科技CTO,前中诚信征信总架构师,主要从事隐私计算、大数据应用、区块链等领域研究。联系方式:hehao@insightone.cn

王湾湾,洞见科技数据智能总监,前中诚信征信数据科学家、建模咨询总监,主要从事隐私计算、机器学习、数据挖掘等领域研究。联系方式:wangwanwan@insightone.cn

强锋博士,加拿大滑铁卢大学计算机与运筹学双学士,英国剑桥大学硕士,爱丁堡大学运筹运化数学博士,清华大学-香港中文大学FMBA,主要研究方向为隐私计算技术在金融场景中的应用。联系方式:f.qiang@gmail.com

声明:本文来自隐私计算联盟,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。