【最近开始,我们将陆续对国际上比较有趣的研究工作进行推荐,供同行研究者参考,本次介绍一篇关于保护人脸照片的工作,防止你在社交网络上的人脸照被第三方滥用,该工作已在业界得到了广泛的应用。Shan, Shawn, et al. Fawkes: Protecting privacy against unauthorized deep learning models, 29th USENIX, 2020.】

在如今人工智能与大数据的大背景下,个人的照片很容易遭到滥用,任何人或者机构可以轻易的公开的社交网络与人脸识别算法训练得到一个人脸识别系统,因此人脸图像的隐私保护问题在如今有重要的研究意义。来自芝加哥大学的研究人员于2020年USENIX Security symposium大会上发表题为Fawkes: Protecting Privacy against Unauthorized Deep Learning Models的论文,防止人脸图像被滥用,题目Fawkes取自漫画《V字仇杀队》中的Guy Fawkes Mask(盖伊·福斯克面具)。

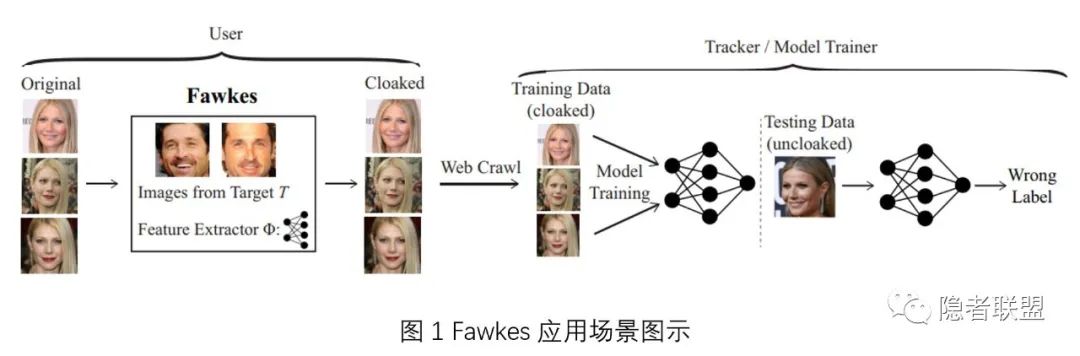

Fawkes的应用场景与方法如图1所示,用户通过在本地将图像处理带上“隐身斗篷”,需要注意这件“隐身斗篷”对于原图像的改动对于肉眼来讲是非常难以察觉的,因此不会对图像质量有较大的影响。而对于攻击者,他收集到带有”隐身斗篷“的图像并且通过他们训练得到一个分类器,但是当它识别真实人脸图像时,它会做出一个错误的判断。

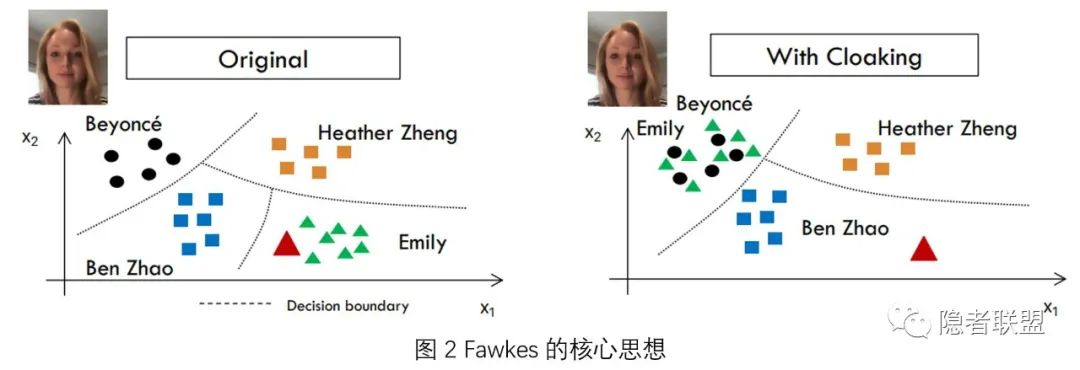

图2 展示了该方法的基本思想,左边部分为未经过Fawkes保护的人脸图像被人收集训练人脸识别分类器后的特征空间在经过降维后的分布图,可以看到决策面将四个人轻松地分开了,此时人脸识别系统也有很高的识别准确率。

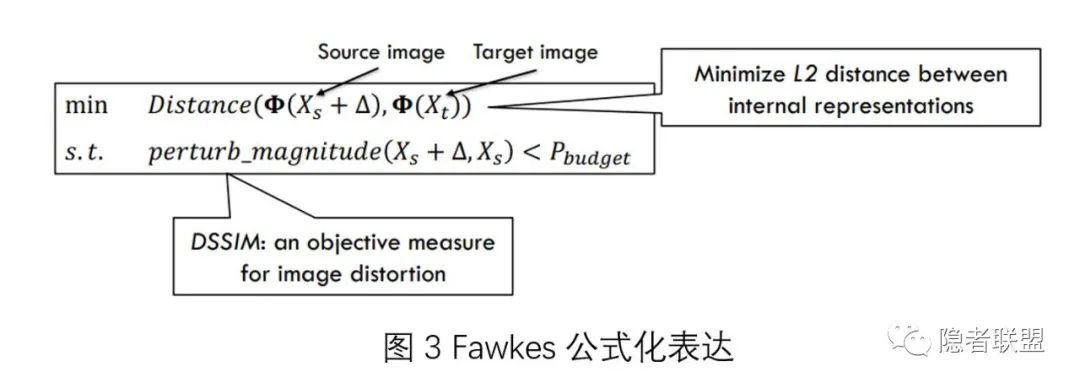

Fawkes的出发点就是通过添加“隐身斗篷”是的被保护人脸特征在特征空间与另个人脸图像尽可能地接近,具体可以由图3来表达,即最小化带有“隐身斗篷”与目标人脸的特征距离,同时满足约束“隐身”斗篷对于原始图像的影响较小,其中Φ表示人脸特征提取器。

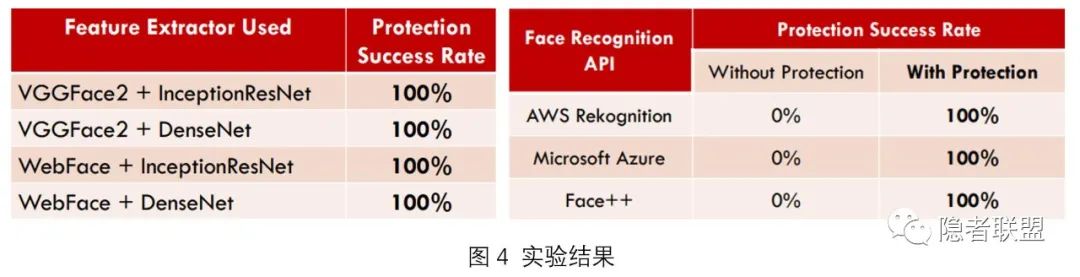

作者在多个数据集与人脸识别模型上进行了详细的实验,可以看到实验结果如图4所示,Fawkes都可以达到100%的保护成功率即当干净图像输入由经过Fawkes处理图像训练得到的人脸识别器时其分类准确率接近0%,同时作者也测试了Fawkes对于微软、亚马逊和旷视公开的人脸识别训练API,其也可以得到接近100%的保护成功率。

最后,作者已经开源该项工作的源代码以及可直接执行使用的软件(Win10版和MacOS版)。截至21年4月,Fawkes已经有超过50万次的下载量。

撰写人:复旦大学多媒体与AI安全实验室(Fudan-MAS Lab)博士生钟楠

声明:本文来自隐者联盟,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。