在大数据时代,定制化的商业信息推送日益普遍,作为消费者,人们在日常生活中时常能“感受”到它的存在。用户画像作为精准营销和个性化内容推荐的基础,需要获取和分析大量的个人信息,因此在实践中越来越受到监管部门的关注。如何在个人信息保护和商业利益之间寻求平衡?对于这一问题,本文拟从用户画像的各个阶段和环节出发,简要分析有关精准营销和个性化内容推荐的相关法律问题。

01 用户画像的定义及分类

从技术角度而言,用户画像是通过将用户标签化,刻画一个用户的需求模型[1]。在法律层面,用户画像被定义为通过收集、聚合、分析个人信息,对特定自然人的个人特征,如职业、经济、健康、教育、个人喜好、信仰、行为等方面做出分析或预测,形成其个人特征模型的过程[2]。

基于对用户需求描述方式不同,用户画像可以分为两类,即直接用户画像和间接用户画像:

直接用户画像

是指直接使用特定自然人的个人信息,形成该自然人的特征模型。直接用户画像的特征在于构建个人标签,形成用户信息全貌[3]。直接用户画像收集的信息更具有真实性和准确性,并需要数据处理者对相关数据实时更新和追踪以确保其有效性。直接用户画像的颗粒度粗细兼有,维度也更加丰富和立体。

间接用户画像

是指使用来源于特定自然人以外的个人信息,如其所在群体的数据,形成该自然人的特征模型[4]。间接用户画像通常用于勾勒群体画像,更侧重于关注具体应用场景下客户群的共性,并形成角色描述,如“00后”、“成年男性”、“白领”、“自由职业”者等。

直接和间接用户画像之间最主要的区别在于形成画像的模型不同。直接用户画像指向特定个人,为真实的用户数据集合,而间接用户画像是基于具有相同特征的固定人群形成的画像,具有抽象性和虚拟性。

间接用户画像信息颗粒度较大,与具体自然人的关联性并不紧密。而直接用户画像则不同,在进行直接用户画像的初期,其收集的相关信息就与特定个人直接相关联,如果后期的分析和处理过程没有剥离对特定个人的识别性和关联性,由此形成的直接用户画像通常具有个人信息属性,需要赋予与个人信息同等标准的保护。

02 精准营销与用户画像的应用

用户画像在早期主要应用于软件产品的设计和开发。随着大数据技术的发展,用户画像与商业逐渐相互结合,频繁出现在网络营销活动之中,并成为分析现有或潜在客户和向目标群体进行精准营销和个性化内容推荐的重要依据。

以汽车行业为例,对用户画像的常见需求是为不同的汽车品牌、车型和款式找到最合适的消费者群体。其用户画像主要通过追踪用户的行为轨迹(user journey),包括但不限于用户对线上和线下等平台渠道的访问,从而统计和形成用户对品牌、车型和价位的个性化需求和特定偏好的全貌。

企业通常通过线上、线下触点的分布,获取来自不同平台的信息流,以达到数据聚合的目的。在数据分析阶段,企业可以通过分析客户的基本个人信息,形成用户基本属性的画像。而通过对网页、App、小程序或用户社群等渠道中更具个性化的行为数据的分析,企业可以深度了解消费者偏好,并通过缩短此类数据的闭环周期,形成更加精准化的用户画像。该等用户画像不仅可以用于精准化营销和定制化内容推送,还可以反哺相关的产品设计和开发,或优化市场布局和运营。

与汽车行业略有不同的是,用户画像在金融行业的应用更侧重于对特定个人的资产信息、消费数据、信用数据等方面的分析。特别是对个人进行信用评级时,往往需要通过对特定客户进行直接用户画像才能实现。虽然在金融产品的开发以及市场分析方面,金融企业也可能通过分析客户的金融产品偏好和消费偏好,对具有共同群体特征和喜好的消费者进行群体画像,但总体而言,金融行业对直接用户画像的依赖可能更高。

03 用户画像与个人信息保护

用户画像最基本的要素为个人信息。企业需要通过收集与“人”相关的基本属性信息或行为数据等,描述“人”与其他要素如“物”和“环境”之间的关系[5],并最终形成特征模型。因此,直接和间接用户画像,都离不开对个人信息进行收集和处理。

一般而言,用户画像可以细分为三个阶段:

收集聚合:对个人信息以及相关市场数据进行“收集”和“聚合”;

识别分析:通过不同的数据算法进行差异化识别,“分析”出群体或个人的特征,并形成直接或者间接的用户画像;

具体应用:将用户画像与实际应用相结合,用于精准营销,个性化内容推荐。

对于前述每一阶段,企业需要关注的合规问题各有不同:

1. 个人信息的“收集”和“聚合”阶段

(1)保障权益:用户的知情权和选择权

对个人信息和相关数据的收集是进行用户画像的第一步。从个人信息的收集、聚合到用户画像的形成,企业均需要充分保障用户的基本信息权利。例如,依据《个人信息保护法》,企业在收集和处理个人信息用于用户画像时,个人信息主体应被充分告知相关处理活动的情况,并有权限制或拒绝企业对其个人信息进行处理[6]。同时,个人有权要求企业对其个人信息处理规则进行解释说明[7]。

去年,引发社会高度关注的“胡某诉某线上酒店预订平台案”中,除了使用用户画像进行“大数据杀熟”的问题外,法院还认定了一个关键性的违法事实,即通过“捆绑服务和强制停止使用等不正当手段,变相强迫、强制用户同意处理其个人信息行为”[8]。被告公司通过强行获取用户授权而采集个人信息进行用户画像,侵害了用户对其个人信息的法定权利。

(2)告知同意规则

告知同意是《个人信息保护法》下处理个人信息最为常见的合法性基础。实践中,企业通常会在其隐私政策中向用户告知个人信息的收集会被用于用户画像和个性化展示,并征得用户的同意。除满足一般合法性基础外,在特殊领域还应遵循其相应的信息收集规则及禁止规则。例如,在统计方面,统计机构对统计工作中知悉的个人信息负有保密义务[9];在医疗方面,收集人口健康信息时需要遵循“一数一源,最少够用”原则[10],采集人类遗传资源须获得主管部门的行政许可[11]。

一般情形下,企业在收集相关个人信息阶段,需要重点关注以下方面:

是否通过显著的方式向用户进行告知,并取得了个人同意;

是否涉及收集用户的敏感个人信息、使用自动化决策、向第三方提供个人信息等,并取得了单独同意;

在取得个人同意时,是否充分尊重个人意愿,给予用户不同意但继续使用相关基本功能的选项,以避免被认定为“过度索取权限”或“强制用户使用定向推送功能”。例如,避免在隐私政策或服务协议中默认自动收集用户的个人信息,或设置“不同意则退出”等强制选项;

向个人告知内容是否真实和全面,包括个人信息处理者名称和联系方式,处理目的、处理方式、个人信息种类、保存期限,行权方式,以及便捷关闭授权的路径和选项等。例如,收集用户在使用某一功能或服务时的相关信息用于其他的功能或服务中,需注意告知的个人信息处理目的是否全面。当进行个性化推送需要获取用户的手机号码、微信号、手机硬件识别码(IMEI)、浏览器cookie信息等个人信息时,应一并进行告知;及

直接使用已有的用户数据库或用户主动上传的内容进行用户画像和分析,需确保该部分数据在取得时已对用户履行了告知义务,且数据处理范围和目的不超过个人同意的范畴。

(3)默认不开启原则

鉴于我国对个人信息保护的力度不断加强,通过用户画像来实现精准的广告投放与追踪需要更加透明化的实施方案。《个人信息保护法》明确了取得个人信息的真实性、准确性、完整性告知规则,企业在收集个人信息进行用户画像时,应充分重视告知同意的质量,清晰地向用户告知精准营销或个性化内容推荐等处理活动的目的和方式,并取得个人同意。

我们建议企业在收集客户数据进行用户画像分析时,尽量避免对个人身份的识别,并在初始设置上给予用户更多的选择。例如,用户可以通过点击不同类别的标题,选择和改变默认设置。在用户关闭相关设置后,开发者或企业应当立即将用户的个人信息进行删除或进行匿名化处理、并停止使用相关信息。基于默认收集和投放个性化广告政策的企业需从技术设置层面进行部署调整,以实现个人信息处理的合规要求。

(4)最小必要原则

《网络安全法》要求网络运营者不得收集与提供服务无关的个人信息[12]。《个人信息保护法》也提出了处理个人信息两个最小原则,即对个人信息主体影响最小和处理目的的“最小范围”。而在处理目的“最小范围”内收集个人信息的规定是禁止“过度收集”,也是防止过度商业化利用的关键。

在“胡某诉某线上酒店预订平台案”中,被告通过概括授权的方式收集个人信息,包括用户的账户信息、设备信息和位置信息等,由于此类信息的收集并非向客户提供酒店等预订业务之必需,法院认定此“收集超出了最小范围”。江苏省消费者权益保护委员会发布的《新能源汽车行业不公平格式条款调查报告》[13]也对部分车企收集用户个人信息形成用户画像,向用户展示、推送商品或服务等信息的行为提出了质疑,认为涉嫌个人信息使用的过度商业化。

关于获取个人信息的“最小必要”原则,《信息安全技术 个人信息安全规范》(GB/T35273-2020)(以下简称“《个人信息安全规范》”)提出了以下具体要求:一是收集的个人信息类型应与实现产品或服务的功能直接关联,即没有该信息的参与,则产品或服务的功能无法实现;二是自动采集个人信息的频率应是实现产品或服务的功能所必须的最低频率;三是间接获取个人信息的数量应是实现产品或服务的功能所必须的最少数量[14]。上述要求分别从“强制”、“频繁”和“过度索取权限”三个角度对“最小必要”原则进行了阐述。

近年来国家对App平台收集和处理用户个人信息的行为进行了严格监管,从工信部通报要求整改的问题上看,涉嫌“超范围收集个人信息”和“App强制、频繁、过度索取权限”所占的比例非常大。由于不同业务对应的目的和需求也不同,如何认定“最小”和“必要”一直是困扰企业的痛点。随着相关立法的不断完善,特别是App应用方面,企业实践中的不可操作性和模糊性等问题正在逐渐被改善。根据《App违法违规收集使用个人信息行为认定方法》,仅以改善服务质量、提升用户体验、定向推送信息等为由,强制要求用户同意收集个人信息,可被认定为“违反必要原则,收集与其提供的服务无关的个人信息[15]。

《信息安全技术 移动互联网应用程序(App)收集个人信息基本要求》(GB/T41391-2022)围绕“最小必要原则”提出了App收集个人信息应满足的基本要求,以及常见服务类型App必要个人信息的使用要求,如地图导航类,网络约车类,网络购物类等。《信息安全技术 移动互联网应用程序(App)收集使用个人信息最小必要评估规范》进一步明确了关于个人信息收集和使用的具体评估要求、评估方法和流程,其中,值得关注的是除了一般告知同意,权限要求之外,与用户画像密切相关的内容,如App定向推送功能使用了第三方的个人信息来源时,应以个人信息处理规则等形式向用户明示业务功能使用第三方的个人信息进行定向推送,并向用户明示第三方的个人信息来源;在间接获取个人信息后进行加工处理形成新的个人信息并用于其他目的需要告知,并再次征得用户的同意[16]。

用户画像是基于用户数据而形成的模型。我们建议企业在进行用户画像的前期借鉴GDPR中的“设计和默认数据保护”概念(data protection by design and default)[17],明确和预先梳理进行用户画像分析之必要提取和处理的信息,避免在实践中造成大量个人信息汇集,增加数据合规风险。如企业自身意识到可能涉嫌超范围收集,应立即对相关的个人信息进行匿名化处理,并对相应的业务项目和程序设置及时进行整改。

(5)对未成年人的画像和算法推荐

我国对使用未成年人的个人信息进行了严格的限制。根据《个人信息保护法》,企业处理不满十四周岁未成年人个人信息时,应取得未成年人的父母或者其他监护人的同意,并制定专门的个人信息处理规则[18]。不满十四周岁未成年人的个人信息,均属于敏感个人信息的范畴,需要取得单独同意。

同时,《互联网信息服务算法推荐管理规定》对使用未成年的个人信息提出了更加具体的要求,避免未成年人陷入“信息茧房”带来负面影响。依据该规定,企业应当依法履行未成年人网络保护义务,通过开发适合未成年人使用的模式、提供适合未成年人特点的服务等方式,便利未成年人获取有益身心健康的信息。企业不得向未成年人推送可能引发未成年人模仿不安全行为和违反社会公德行为、诱导未成年人不良嗜好等可能影响未成年人身心健康的信息,不得利用算法推荐服务诱导未成年人沉迷网络[19]。

因此,企业应谨慎收集未成年人相关信息并进行用户画像,未取得监护人的同意,企业不得对未成年人进行用户画像,且不得向未满十四周岁的未成年人推荐个性化产品或者服务。此外,企业还需要制定专门的个人信息处理机制,并对制度内容进行严格的审查,避免涉及任何可能对未成年人造成不良影响的内容。

2. “识别分析”个人信息——用户画像的形成阶段

(1)一般禁止性规定

从内容层面,《个人信息安全规范》对个人信息处理者使用用户画像进行的描述内容做出了明确的禁止性规定。《个人信息安全规范》要求用户画像中对个人信息主体的特征描述,不应包含淫秽、色情、赌博、迷信、恐怖、暴力,表达对民族、种族、宗教、残疾、疾病歧视的内容。同时,在业务运营或对外业务合作中使用用户画像的,不应侵害公民、法人和其他组织的合法权益,危害国家安全和社会公序良俗[20]。

《信息安全技术 移动互联网应用程序(App)个人信息安全测评规范》(征求意见稿)(以下简称“《个人信息安全测评规范》”),该规范对企业通过App进行用户画像提供了更加具体的行为指南。除通过App和App服务端进行功能验证、服务端测评是否涉及禁止性内容外,还应关注所涉及的文档资料的合规性,并通过对内部相关人员的沟通访谈等方式进行合规审核[21]。企业开展限制性内容的内部审查,可以遵循以下步骤:

制度层面:审查企业内部个人信息安全管理政策和工具是否涉及禁止性的画像特征描述;

动态管理:询问相关管理人员、技术人员、产品经理,了解用户画像的分析活动;

技术排查:检查用户标签管理页面或包含用户标签管理的平台端中对用户标签的类型、列表与配置规则。

(2)对直接用户画像的场景限制

从应用场景层面,由于直接用户画像所需的个人信息比间接用户画像更加丰富,而且对个人具有直接的指向性,为了避免对个人信息的过度收集和滥用造成对个人权益的侵害,《个人信息安全规范》对直接用户画像的使用场景进行了限制。

具体要求包括:除为实现个人信息主体授权同意的使用目的所必需外,使用个人信息时应消除明确身份指向性,避免精确定位到特定个人[22]。例如,为准确评价个人信用状况,可使用直接用户画像,而用于推送商业广告目的时,则宜使用间接用户画像。企业可以通过查看内部管理制度中是否包含使用个人信息时应消除明确身份指向性,避免精确定位到特定个人的规定,并核查应用的App服务端功能或日志,确认是否存在非必要场景中使用明确身份指向性信息进行精确画像的情况[23]。

3. 精准营销——用户画像的使用阶段

(1)与自动化决策以及算法技术相关的规制

自动化决策,是指通过计算机程序自动分析、评估个人的行为习惯、兴趣爱好或者经济、健康、信用状况等,并进行决策的活动[24]。应用算法推荐技术,是指利用生成合成类、个性化推送类、排序精选类、检索过滤类、调度决策类等算法技术向用户提供信息[25]。

用户画像是进行个性化展示和推送的基础,而算法和自动化决策是其技术手段,其中个性化推送类算法与用户画像关系最为密切。用户画像在分析建模并进行个性化广告或内容推荐时,通过算法进行决策,还需要遵从自动化决策以及算法技术的相关要求。

需要注意的是,用户画像与自动化决策之间并不总是互相依存的关系。实践中,仅进行用户画像而不进行自动化决策,或者依据其他条件进行自动化决策的场景亦很普遍,需要依据具体的情形进行区分。例如,调度决策类算法常用于外卖以及网约车平台,主要目的是对订单和配送进行资源优化和分配。此类场景下的数据处理活动并不涉及用户画像,则仅需要适用算法和自动化决策的相关法律规定。

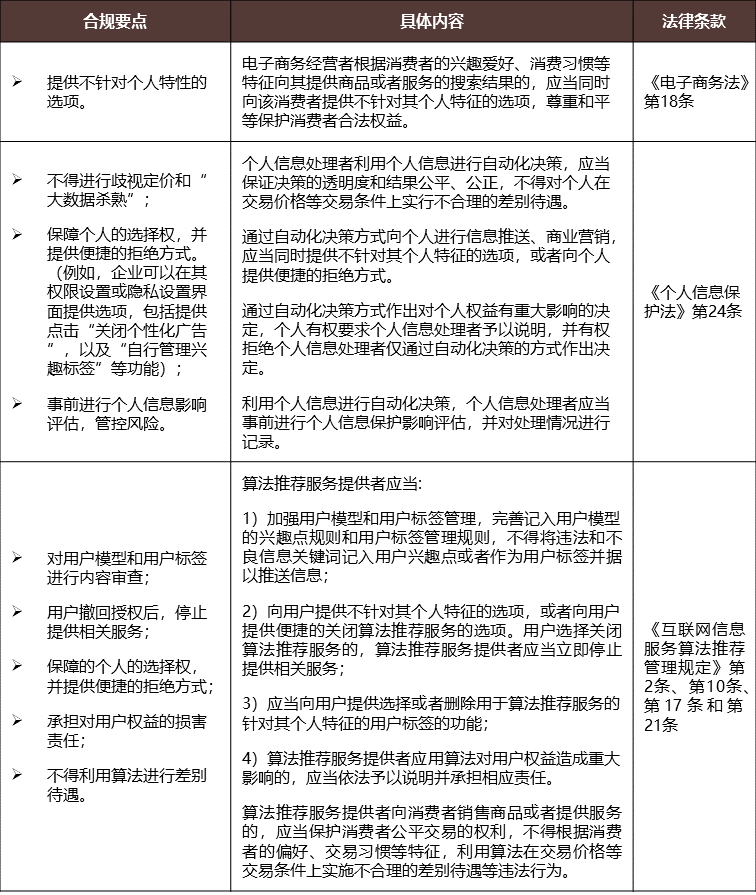

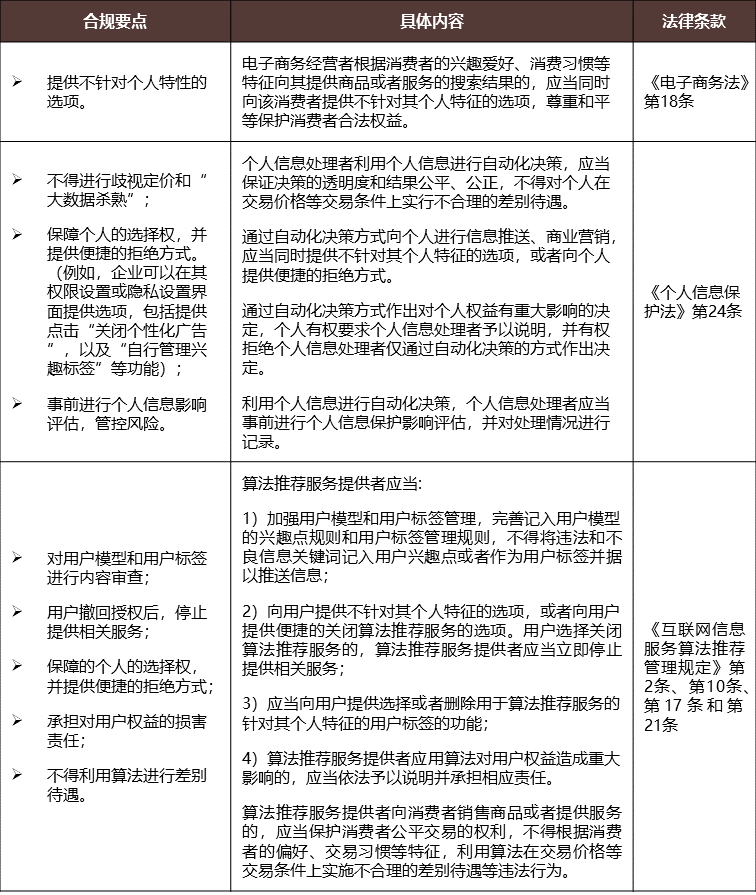

若企业在未履行全面的告知义务或未提供不针对个人特征的选项的情形下进行相应的算法分析,将有违自动化决策的透明度要求,并涉嫌侵害用户的选择权和拒绝权。继《电子商务法》之后,我国相继出台了《个人信息保护法》以及《互联网信息服务算法推荐管理规定》等强制性法律规范,对用户画像、算法推荐等新的大数据相关技术的应用提出了更加具体的要求:

(2)规范个性化广告的内容

用户画像形成后,据此对不同的客户群体进行个性化广告推送和内容推荐,是实现精准营销的重要环节。常见的推送方式包括:短信,微信,邮件和网页等。当向个人推送的内容属于商业广告类别时,除取得个人的同意外,还应当遵循以下具体规定:

(3)与商业伙伴的共享限制

我国并不禁止用户画像的共享,信息共享的过程也最大程度上发挥了信息价值。但是共享方和接收方都必需按照相关要求向用户清晰详细的告知并保障用户各项权利。

1)企业向合作伙伴共享

《个人信息保护法》对个人信息的共享场景提出了单独同意要求。若企业向第三方或其委托的代理商共享直接用户画像时,需要确认已告知个人关于用户画像处理的预期用途和后果,并取得单独同意。

共享间接用户画像的场景下,需要事先特别确认新生成的间接用户画像是否仍然包含个人信息,以及共享过程中是否会同时输出其他信息或个人信息(常见的如个人手机号,微信号,IP地址等)。当企业共享的信息可能关联识别到特定个人时,间接画像的共享仍须适用个人信息的传输规则,包括但不限于取得个人信息主体的单独同意。

在App应用场景下,若企业未经用户同意,也未做匿名化处理向第三方提供个人信息,很可能会被相关监管部门认定“为未经同意向他人提供个人信息”,面临责令整改或受到处罚的风险。

其中,向第三方提供的典型场景包括:

通过App客户端直接向第三方提供个人信息,包括通过客户端嵌入的第三方代码、插件等方式向第三方提供个人信息;

数据传输至App后台服务器后,向第三方提供其收集的个人信息;

App接入第三方应用向第三方应用提供个人信息[26]。

企业应确保个人信息主体的充分知情基础上做出的同意,同时需留意共享的数据范围不可超出收集时告知和个人同意的范围。通过内嵌SDK进行共享时,由于SDK通常无法独立展示前台页面,企业在向用户告知嵌入SDK共享的接收方名称、个人信息种类、处理目的和方式时,建议向用户提供向第三方提供的信息共享清单,以充分保障用户知情权。

需要注意的是,若向第三方共享和从第三方获取的是脱敏后的用户画像数据,不涉及对原始个人信息共享的情形下,该等数据由于不再具有个人身份特征,无法对用户进行识别关联,将不会涉及个人信息的交互问题。

2)从第三方合作伙伴获取

部分企业由于自身流量或技术等因素限制,需要当从外部第三方合作伙伴获取相关数据进行用户画像。在App应用场景下,从第三方获取个人信息的方式包括通过嵌入第三方代码、插件以及通过后台服务器传输等。例如,第三方平台可以通过access_token访问微信平台提供的调用接口,获取特定的用户信息[27],对用户进行画像。

从第三方获取用户画像时,企业需核实确保第三方提供的个人信息来源合法,例如第三方获取是否取得个人同意,且共享的信息没有超过个人同意处理的范围[28]。

在共享和从第三方获取个人信息的场景下,企业需与第三方之间对于数据安全进行明确的责任划分,并采取严格访问控制措施和权限管理。特别是在采用开放数据接口,或者使用第三方提供的云平台与第三方进行数据传输时,在用户个人信息泄露频发的当下具有重要意义。

小结

基于我国对个人信息保护的监管日趋严格,通过用户画像实现精准营销和个性化内容推荐需要更加周密的实施方案。企业需给予足够的重视,以满足数据处理的合规要求。无论是从相关法律文件的审阅更新(如更新隐私条款和用户协议),还是从内部合规体系上的完善,企业都需要密切关注和严格遵守相关法律法规要求。同时,建议企业加强内部培训,提高安全和合规意识。

脚注:

[1] 参见 刘启林《用户画像的基础、原理、方法论(模型)和应用》。

[2] 定义来源《信息安全技术 个人信息安全规范》第3.8条。

[3] 定义来源《信息安全技术 个人信息安全规范》第3.8条。

[4] 定义来源《信息安全技术 个人信息安全规范》第3.8条。

[5] 参见刘启林《用户画像的基础、原理、方法论(模型)和应用》。

[6] 参见《个人信息保护法》第44条。

[7] 参见《个人信息保护法》第48条。

[8] 访问于https://wenshu.court.gov.cn/website/wenshu/181107ANFZ0BXSK4/index.html?docId=ee72fdb858a74716a401ae2b00c66440

[9] 参见《统计法》9条。

[10] 参见《人口健康信息管理办法(试行)》第8条。

[11] 参见《人类遗传资源管理暂行办法》。

[12] 参见《网络安全法》第41条。

[13] 访问于http://web.jshcsoft.com/jiangsu/HTML/listDetails.html?id=2&channel_id=1033&type=undefined&textId=4153&category_id=

[14] 参见《信息安全技术 个人信息安全规范》第5.2条。

[15] 参见《App违法违规收集使用个人信息行为认定方法》第4条。

[16] 参见《移动互联网应用程序(APP)收集使用个人信息最小必要评估规范》第1部分:总则。

[17] 参见GDPR第25条所规定的“设计和默认的数据保护” Data protection by design and default),具体是指数据控制者(Data controller)在决定数据处理方式以及进行处理时以有效的方式采取适当的组织和技术措施保护数据主体权利,同时确保在默认情况下仅在具体目的的必要范围内处理个人数据。

[18] 参见《个人信息保护法》第3条。

[19] 参见《互联网信息服务算法推荐管理规定》第18条。

[20] 参见《信息安全技术 个人信息安全规范》第7.4条。

[21] 参见《信息安全技术 移动互联网应用程序(APP)个人信息安全测评规范》第6.3.4条。

[22] 参见《信息安全技术 个人信息安全规范》第7.4条。

[23] 参见《信息安全技术 移动互联网应用程序(APP)个人信息安全测评规范》第6.3.4条。

[24] 参见《个人信息保护法》第73条。

[25] 参见《互联网信息服务算法推荐管理规定》第2条。

[26] 参见《APP违法违规收集使用个人信息行为认定方法》第5条。

[27] 参见吴旭华:《推荐算法原理拆解》。

[28] 参见《信息技术安全 个人信息安全规范》第5.4(e)条。

本文作者

赵新华

合伙人

公司业务部

atticus.zhao@cn.kwm.com

业务领域:公司业务,在公司并购、外商直接投资、公司重组及其他公司事务方面具有丰富的经验

赵律师拥有十多年的法律执业经验,曾先后为多家知名跨国公司和国内大型企业提供并购、投资等方面的法律服务,包括股权或资产收购、转让、公司重组、设立合资公司、特许经营等,涉及的行业包括汽车、高科技、物联网、零售、教育、工业制造、船舶和医药等。

王哲峰

公司业务部

李雯婷

公司业务部

转载声明:好文共赏,如需转载,请直接在公众号后台或下方留言区留言获取授权。

封面来源:画作·林子豪

责任编辑:赵天园

声明:本文来自金杜研究院,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。