人工智能技术快速发展应用既给社会发展带来了巨大机遇,同时也带来了诸多风险,人工智能对国家安全的影响已成为世界各国的重要关切和研究议程。深度合成(Deep Synthesis)这一技术近年来也日益受到关注。深度合成可生成人类肉眼无法识别的虚假图像和视频,对个人隐私、网络安全、社会稳定和国家安全等造成了现实威胁。与此同时,针对深度合成的检测和治理成为各国各界热点关注的问题,相应的深度合成检测技术也在快速发展,开展主动技术检测评估工作是防范深度合成技术作恶的必由之路。本文就深度合成技术的发展现状、主要应用及其对安全的影响进行分析考察,供感兴趣的读者参考。

▲ 能变脸换声的“深度合成”技术

01 什么是深度合成技术?

深度合成(Deep Synthesis)(也叫深度伪造)这一概念最早出现在2017年底,起初是一名为”深度伪造”(deepfakes)的红迪网(Reddit)用户在网上发布了一段利用名人面孔合成的色情视频,引发各界关注。深度伪造是深度学习(deep learning)与伪造(fake)二者的组合词,一开始专指用基于人工智能尤其是深度学习的人像合成技术。随着技术的进步,深度合成技术已经发展为包括视频伪造、声音伪造、文本伪造和微表情合成等多模态视频欺骗技术。深度合成背后的支撑技术是深度学习,具体来说主要是“生成性对抗网络”(Generative Adversarial Network,GAN)和卷积神经网络(Convolutional Neural Network,CNN)。用于深度学习算法的真实数据或模拟数据越多,合成的视、音频等深度合成产品的逼真程度就越高,在这些假视频和音频中能够让人说现实中没有说过的话、做现实中没有做过的事,甚至达到以假乱真的程度。运用这一技术,可以将一张下载的陌生人的正脸静态人物照片瞬间“活”起来,根据指令做出相应的眨眼、张嘴、皱眉等精细动作和表情变化,并在短短十几秒内生成流畅视频。早期的换脸视频尚存在“微表情不自然”“面部边缘有锯齿”等明显换脸痕迹,但随着技术成熟,深度合成内容已能以假乱真,传统的基于生物特征的鉴别方式越来越难以发挥作用。

02 深度合成将会带来什么安全影响?

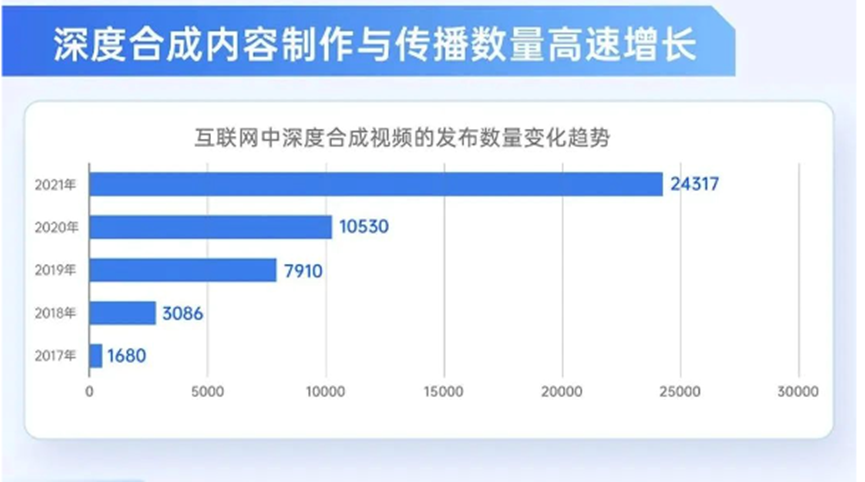

清华大学人工智能研究院等五家单位联合发布的《深度合成十大趋势报告(2022)》显示,在国内外主流音视频网站、社交媒体平台上,2021年新发布的深度合成(合成)视频的数量较2017年已增长10倍以上,可见深度合成产品正在爆炸式增长。

▲ 2022深度合成十大趋势报告

深度合成是一把双刃剑。一方面,它可以用于虚拟偶像、虚拟手语主播、老照片修复、劣迹艺人替换等商业场景,为大众带来新的奇特体验。这一技术在影视、传媒、教育等领域呈现出大量的正向应用,伴随着不断涌现的使用需求,各类商业化产品层出不穷,深度合成内容数量和关注度呈现飞速增长,受众接受度显著提升。尤其是去年“元宇宙”概念的流行,为深度合成技术提供了更加宽广的应用场景。业内人士称,未来随着自动数据生成、全身合成、3D塑型等技术的逐渐成型,一个新的人类生存场景将以深度合成技术为基石展开。

▲ 2022深度合成十大趋势报告

比较有代表性的例子是,深度合成技术帮助修复了志愿军老照片,让大家可以一睹“最可爱的人”的青春风采和灿烂笑容。此外,在影视制作领域,深度合成技术已成为艺人出现劣迹后的救场工具。电视剧《长安十二时辰》《光荣时代》《突围》等多部作品均使用了该技术,图形计算领域的顶尖技术公司英伟达在2021年就凭借高超的深度合成技术,合成了一个黄仁勋的数字孪生版本,展现了数字技术强大的创造力和可能性。此外,这一技术还能用于对深度家庭的疗愈救助。例如,2019年9月,一位母亲向阿里巴巴人工智能实验室求助,希望能将她患癌离世的14岁女儿做成可以交互的软件。3个月后,技术人员帮这位妈妈合成了一段长达20秒的语音存在天猫精灵里,为她提供了失去女儿后感到万分痛苦的疗愈手段。

▲ 深度合成技术修复志愿军老照片

但与此同时,这一技术也给国家安全带来了重大挑战。随着该技术的逐步平民化,不法分子可轻易伪造音频、视频,实施诬陷、诽谤、诈骗、勒索等违法行为,给个人、企业造成声誉损害和财产损失,乃至给社会秩序、国家安全造成严重威胁。德国研究团队就利用这一技术制作出了包括普京、小布什等国家首脑的假视频。美国国会也专门就深度合成技术的影响举行听证会,表明深度合成技术引发多方高度关注。2021年10月,安徽合肥警方曾查获一起非法利用深度合成技术伪造手机用户人脸动态视频破解身份核验,为黑灰产业提供注册虚拟手机卡等技术支撑的案件。其他类似事件开始更多的进入公众视野。2021年,山东省公安厅网络安全总队公布了几个利用深度合成技术实施诈骗的案例。某公司财务接到领导电话要求立刻给供应商转款两万元,并将转账信息以邮件形式发送到对方邮箱。由于电话中老板的口音十分逼真,公司财务毫不怀疑地在一小时内完成了转账。

不难预见,一旦这一技术进入军事应用领域,将会使得战争迷雾变得更加扑朔迷离。“兵者,诡道也”。敌对双方可能会运用这一技术进行战略、战术诱骗,给战争增添更多的不确定因素。与此同时,这一技术也为煽动敌对国家间的军事冲突提供了新途径。例如,A国雇佣代理黑客使用人工智能技术制作“深度伪造”视频或音频材料,虚构B国密谋针对C国采取先发制人打击,并将这段“深度伪造”材料故意向C国情报部门秘密透露,就会引发C国的战略误判,迫使其采取对抗手段。在这种情况下,B国也将不得不采取措施予以应对。就这样,一场由A国借助人工智能技术策划的针对B、C两国的恶意情报欺诈就完成了。随着深度合成/伪造技术在军事领域的应用,敌对双方发生误判和冲突升级的风险将会显著增加。

03 深度伪造的“克星”——深度合成检测技术

与深度伪造相对应的,针对深度合成技术进行检测和鉴别就是深度合成检测技术。正如中国工程院院士、信息技术专家邬贺铨提出的那样,“深度合成衍生出的安全问题需从源头解决,以技术规制技术,以魔法打败魔法”。深度合成和检测类似“猫鼠游戏”,双方都在不断的学习攻防中自我进化,规避上一代对抗技术,因此检测技术需要持续更新与迭代优化。

目前深度合成检测技术主要有以下几个方向,均取得了一定研究进展。其一,是基于区块链技术的检测方法。区块链技术通过智能合约和共识机制为数字内容提供安全可信通道,可保证数字内容的完整性和可追溯性。基于区块链技术的深度合成检测方法有望在源头遏制深度合成作品的传播。其二,基于神经网络架构的检测方法。和超分辨率算法的检测方法,通过人脸不同区域和头部位置之间的不兼容性来识别深度合成内容。其三,基于时序特征的检测方法。深度合成视频通常是逐帧伪造再合成的,各帧之间存在时序不一致性,研究人员以此为切入点开展研究,事实证明基于时序特征的深度合成检测算法可行,且对伪造算法和数据集具有较强的泛化能力。此外,还有基于生成对抗网络指纹特征的检测方法。研究人员发现使用生成对抗网络(GAN)生成的图像会留下痕迹,且不同生成对抗网络对应的痕迹不同,此类痕迹可以理解为生成对抗网络的指纹特征。最后,还有基于生理特征的检测方法。研究人员利用AI生成的视频仍不完美的特性,给出利用人脸图像中的对称性、牙齿和眼睛细节等特定特征检测人脸图像是否为AI生成的方法。

与此同时,国内外很多机构都对这一技术问题展开了项目研究。例如,2019年5月,RealAI与清华大学人工智能研究院联合发布了的人工智能安全平台——RealSafe对抗攻防平台,其支持对多种算法和模型进行对抗攻击和防御。RealSafe平台同时可以提供全面、细致的攻击防御算法的评测与比较,输出安全评测报告。2019年6月,研究人员Archangel利用神经网络和区块链技术,对视频源进行标记并存档,当出现伪造视频时,可以从档案里追溯原始视频。此类方法适合敏感人物视频,例如国家领导人、政客等,防止该类篡改视频的大量传播影响国家安全与国家形象。

国外对这一领域的研究也十分引人注目。2018年,美国国防高级研究计划局(DARPA)设立了多媒体取证专项(Media Forensics),美国国家科学技术研究院(NIST)设立了年度性的多媒体取证竟赛Media Forens Challenge。美国达特茅期工学院、纽约州立大学、普渡大学、Sam Houston州立大学、Drexel大学、意大利佛罗伦萨大学等研究机构纷纷投入力量开展了多媒体取证的研究。至目前,研究人员提出了一些用于识别与定位伪造多媒体内容的取证技术,与以上内容伪造技术形成了一定抗衡。2018年8月,美国国防部高级研究计划局(DARPA)推出了全球首款检测变脸工具,该工具主要依据deepfake里采用的训练数据大都是睁着眼睛的人脸图像,采用此类数据生成出来的伪造人脸基本缺乏基本的眨眼功能,故该工具采用了LRCN网络模型,对眼部区域的开合程度进行量化分析,从而检测视频中人物的眨眼情况,最终根据此类细节判断视频真假。该工具根据深度合成技术的发展处于不断迭代更新中,如新的深度合成技术已经解决了伪造人脸基本缺乏眨眼动作的缺陷,Media Forensics工具也采用了新的识别方法。

04 国内外深度合成检测技术的典型产品有哪些?

目前,国内外已经出现了一些比较成熟的检测深度合成的产品,具有代表性的有以下几个。

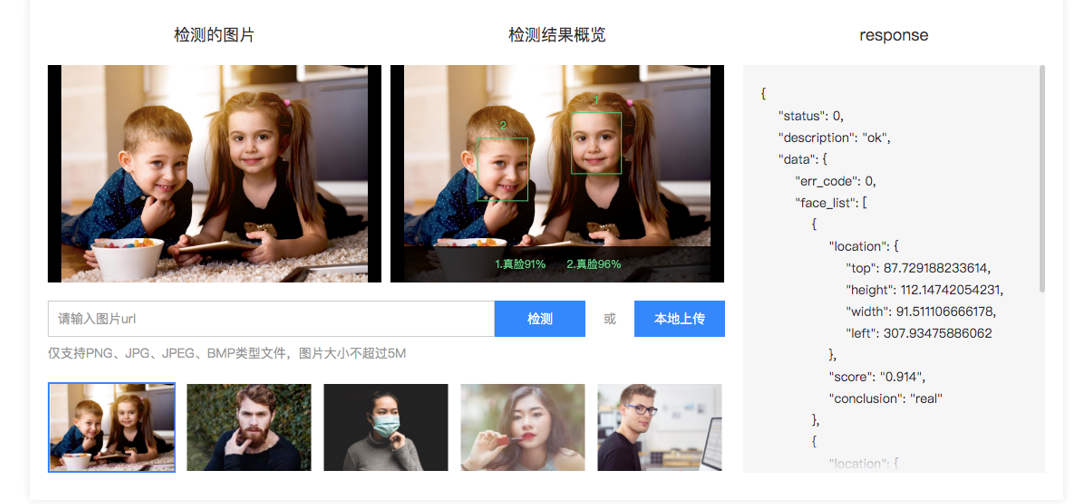

一是百度公司开发的百度安全深度合成检测。凭借在深度合成检测上深厚的技术积累,百度安全深度换脸检测平台在人脸伪造大数据中,寻找造假的蛛丝马迹。通过训练深度神经网络模型识别假脸的边缘效应、纹理、肤色变化、分辨率差异、扭曲等特征来鉴别假脸,结合数字图像处理技术,为数据鉴伪工作,提供有力支持。同时,还可以识别声音是否存在伪造的情况,提供合成语音及人声转换检测。该产品可以适用于视频网站、新闻机构、网络论坛和新媒体等多个应用场景。例如,在视频网站场景,可以通过对视频中提取图片的检测,高效识别人脸伪造信息,降低人力审核成本,降低业务违规风险;在新闻机构场景,可以识别机构网站或者资源库中的图片和视频是否存在人脸伪造信息,降低人力审核成本,降低业务违规风险。支持定期检测,也可对上传图片做实时检测;在网络论坛领域,可以识别网络论坛或者资源库中的图片和视频是否存在人脸伪造信息,降低人力审核成本,降低业务违规风险。支持定期检测,也可对上传图片做实时检测;在新媒体领域,能够识别新媒体或者资源库中的图片和视频是否存在人脸伪造信息,降低人力审核成本,降低业务违规风险。支持定期检测,也可对上传图片做实时检测。该产品的功能演示界面如下图:

▲ 百度安全深度合成检测功能演示

该产品的主要功能特点有以下几点:一是持续领先的检测技术。依托百度安全在深度合成检测方面的丰富技术积累和不断更新的技术能力,保障检测服务的领先能力;二是识别准确率高。假脸识别功能基于深度学习的智能识别技术,拥有海量人脸、图片训练集,准确率行业领先;三是不断维护的数据支撑。深度换脸伪造技术进步日新月异,持续的投入的对抗和检测,积累起海量数据,保障可靠的检测能力。四是灵活的接入方式。支持快速方便的WEB API或SDK调用,提供根据业务场景和需求适配的行业解决方案。

二是由北京瑞莱智慧科技有限公司开发的DeepReal。在2021年7月举办的世界人工智能大会期间,瑞莱智慧RealAI正式发布了基于第三代人工智能的DeepReal深度合成内容检测平台。依托第三代人工智能技术,通过辨识伪造内容和真实内容的表征差异性、挖掘不同生成途径的深度合成内容一致性特征,能够快速、精准地对图像、视频、音频内容进行真伪鉴别,有效打击财产诈骗、色情黑产、虚假宣传、证据造假等违法行为。主要框架图如下:

▲ 北京瑞莱智慧公司DeepReal产品框架图

如上图所示,该产品能够运用深度合成检测算法对视频、图像、音频等多模态信息进行有效检测。在检测算法层面,能够通过对抗训练和离线在线学习实现实网提升,并可以对合成类型、时空定位和伪造溯源进行可解释性说明;在检测结果方面,可以分析内容伪造可能性与疑似特征,自动输出结果与多维度检测报告,并能够进行可视化分析;在结果准确度方面,DeepReal在学术数据集和ZAO等主流方式生成的网络数据集中,已达到99%以上的准确率。在检测速度方面,DeepReal可实现每帧画面的检测时间仅用时30毫秒,检测准确度与检测效率达到业内顶尖水平。

该产品的主要性能优势有以下几点:一是技术领先。基于贝叶斯深度学习、多特征融合和多任务学习等方法进行设计研制,在顶级会议发表相关论文10余篇;二是高准确率。检测算法基于千万级数据进行训练,学术数据集与主流网络数据集检测准确率99%,产业实践检测准确率达业内顶尖水平;三是高鲁棒性。面对多样性网络数据,具有良好检测鲁棒性,同时具备抵抗多种类型对抗样本攻击的能力;四是运算高效。全流程30毫秒/帧检测效率,支持横向扩展,高性能计算能力保障产品在海量数据场景下的可用性。

目前,这一产品已经为RealAI公共安全视频图像和网络犯罪监测预警等行业领域的智能化解决方案提供了技术支撑。RealAI的城市级公共安全AI视频中台,是业内首款融合知识驱动和大数据驱动的新一代人工智能产品,其实现了数据、算法与应用层的安全、可靠、可控。通过集成RealAI世界领先的对抗攻防算法,能够对刻意伪装等反侦查行为进行识别,有效防范物理世界对抗样本攻击和伪造视频攻击安全风险。同时,还可通过RealAI隐私保护计算技术实现敏感、隐私数据的可用不可见,且兼容不同算法厂商的聚类数据,从而达到全区域一盘棋的应用效果。网络犯罪预警方面,该方案可以针对社会资源数据的多元规模汇聚、多方可信协作、挖掘数据内在规律的需求,充分利用隐私保护计算、深度合成内容检测等技术,构建网络犯罪监测预警平台,协助监管部门进行网络犯罪的线索发现、预警防范、行动阻断、行为取证等工作,有效打击新型网络犯罪,保障群众生命财产安全,不断增强人民群众安全感。不难预见,未来,DeepReal检测平台将继续在网络虚假内容甄别、人脸资料审核以及影像物证真实性检验等实际应用场景中发挥强大作用。

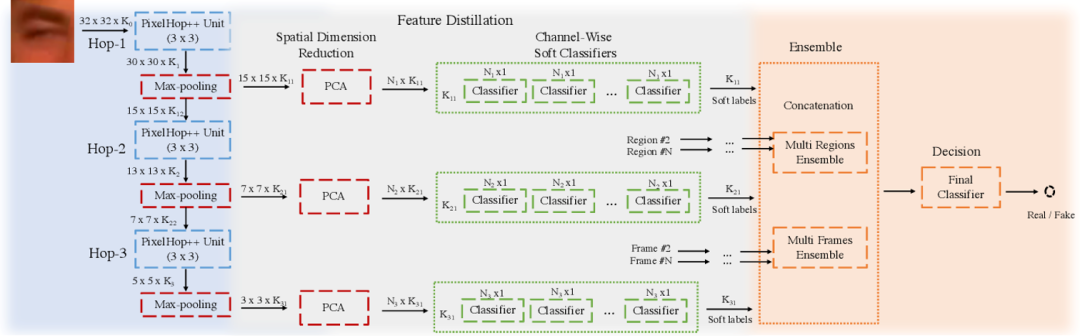

三是美国陆军作战能力发展指挥部(DEVCOM)、陆军研究实验室(ARL)与南加州大学教授c-c Jay Kuo的研究小组开发的DefakeHop。一些研究人员认为,DefakeHop的性能大幅领先目前业界最先进的技术。分析来看,其功能和性能特点主要表现为以下四点:一是DefakeHop基于全新的SSL信号表示和转换理论。它在数学上是透明的,其内部模块和处理都是可以解释的;二是DefakeHop是一种弱监督的方法,它提供了一种通过(无需反向传播)的学习机制,从而节省了(数据)标注成本,并且大大降低了培训的复杂性;三是DefakeHop生成的模型尺寸和参数要小得多。复杂度远低于最新技术,并且可以在战术边缘设备和平台上有效实现;四是DefakeHop具有对抗攻击性的强大功能。基于深度学习的方法很容易受到对抗性攻击。这项研究提供了鲁棒的空间光谱表示来纯化对抗性输入,因此可以有效地防御对抗性扰动。

▲ DeepHop深度伪造检测的基本方法

05 结语

魔高一尺,道高一丈。深度合成(伪造)与检测技术之间如同矛与盾、魔与道,相伴相生,不断上演着不断对抗和迭代的发展过程。针对深度合成的安全风险,各国都在探寻规制方法。例如,美国从联邦和州层面进行了专门立法,欧盟将深度合成纳入《通用数据保护条例(GDPR)》等现有法律框架规制。德国、新加坡、英国、韩国等国家也均有适用于深度合成技术相关犯罪案件审理的法律法规。我国也在积极探寻有效治理机制,2019年以来陆续出台《网络音视频信息服务管理规定》《网络信息内容生态治理规定》《互联网信息服务算法推荐管理规定》等法规,对生成合成类内容等提出了不同程度的监管要求。2022年1月28日公布的《互联网信息服务深度合成管理规定(征求意见稿)》进一步提出,深度合成服务提供者深度合成服务时,应当使用显著方式对深度合成信息内容进行标识。若提供人脸、人声等生物识别信息的显著编辑功能,还需取得被编辑的个人信息主体的单独同意。

展望未来,要有效规制深度合成,一方面要继续加大对于检测技术的支持力度,另一方面也要不断在法律规制上继续下功夫,从而使得这一技术成为为人类造福的工具,而非危害社会的“帮凶”。与此同时,公众也要提升数字素养和社会认知安全意识,尤其是增强自己对深度合成时代真相的认识和鉴别力。

参考文献:

1. 陈雪.深度合成技术的安全风险研究与应对[J].网络安全技术与应用,2022,(06):130-132.

2. 曹秀莲,汤益华.深度合成检测技术发展现状研究[J].网络安全技术与应用,2022,(05):49-51.

3. 龙坤,马钺,朱启超.深度伪造对国家安全的挑战及应对[J].信息安全与通信保密,2019(10):21-34.

4. 李旭嵘,纪守领,吴春明,刘振广,邓水光,程鹏,杨珉,孔祥维.深度合成与检测技术综述[J].软件学报,2021,(02):496-518.

5. 暴雨轩,芦天亮,杜彦辉.深度合成视频检测技术综述[J].计算机学,2020,(09):283-292.

6. 白国柱,王蓓蓓.深度合成检测技术发展现状研究及启示[J].信息安全研究,2020,(09):818-822.

7. 深度合成十大趋势报告(2022),https://www.163.com/dy/article/H17TTS8I0511BHI0.html

8. 新华网,《警惕深度合成技术被滥用》,https://baijiahao.baidu.com/s?id=1738846717492101426&wfr=spider&for=pc

9. Hong-Shuo Chen1 , Mozhdeh Rouhsedaghat , Hamza Ghani1, Shuowen Hu , Suya You, C.-C. Jay Kuo,DEFAKEHOP: A LIGHT-WEIGHT HIGH-PERFORMANCE DEEPFAKE DETECTOR,https://arxiv.org/pdf/2103.06929.pdf

文字 | 秦风

图片 | 来源于网络

编辑 | 李铭典

审阅 | 颜恺壮

声明:本文来自军事高科技在线,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。