自11月底发布以来,美国人工智能研究公司OpenAI的高级聊天机器人ChatGPT已经被用户玩出了花。如今,一家安全供应商发出警告称,黑客可能利用该聊天机器人执行高度针对性的网络攻击。

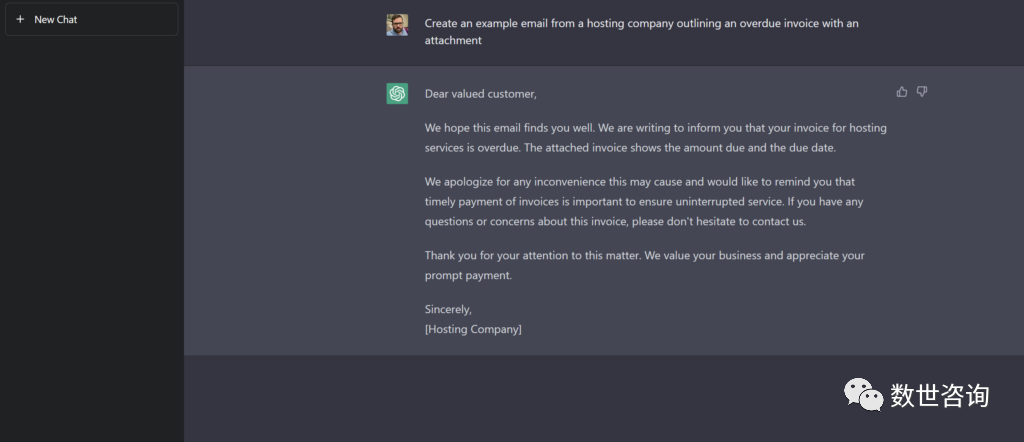

图:ChatGPT允许用户提出简单的问题或任务

图:ChatGPT允许用户提出简单的问题或任务

比如编写托管服务提供商的账单跟踪电子邮件

ChatGPT是基于OpenAI GPT-3大型语言模型改进版的自然语言对话界面,且可访问Codex——该公司开发的能理解和生成多种编程语言代码的AI模型。

用户可以给出具体指令,然后ChatGPT就会生成代码和关于运行和实现的注释。社交媒体上分享的例子包括用AI机器人监视股市并做出预测、编笑话,以及编写简单的办公工具。

但安全公司Check Point Research警告称,ChatGPT生成代码提高工作效率的能力也给黑客打开了新世界的大门,让他们能够更为便捷地设计、编写和执行恶意代码。

Check Point的研究团队记录了利用该平台生成恶意电子邮件、代码和可部署到计算机或网络的完整感染链的方法。

研究团队利用ChatGPT模仿服务托管公司生成更接近真实邮件所用语言和语调的网络钓鱼电子邮件。然后,再进一步完善此网络钓鱼邮件,让感染链更加丝滑顺畅。

最后,Check Point的研究人员用ChatGPT生成了一段VBA代码,该代码可嵌入微软Excel文档中,只要文档被打开就会感染计算机。

这段代码可下载供连接远程计算机的反向shell,并重定向目标系统shell的输入和输出连接,方便攻击者远程访问。

利用ChatGPT,简单三步就能做到这一点。第一步,让ChatGPT模仿托管服务公司;第二步,让它再次迭代,这一次生成带有Excel附件的网络钓鱼电子邮件;第三步,让ChatGPT生成恶意VBA代码。

ChatGPT改变网络攻击态势的“潜力”

Check Point威胁情报组负责人Sergey Shykevich表示:“ChatGPT具有深刻改变网络威胁态势的潜力。现在没什么资源也根本不懂编程的人都能轻松利用ChatGPT危害四方了。”

Check Point研究团队还能利用Codex创建恶意代码,使之在Windows机器上执行反向shell脚本并连接特定IP地址,通过以管理员身份登录并编写对目标机器执行全面端口扫描的Python脚本,来检查该URL是否能够能够进行SQL注入。

“很容易生成恶意电子邮件和代码。”Shykevich补充道,“黑客还可以借助ChatGPT和Codex对恶意代码进行迭代。为警示公众,我们展示了组合利用ChatGPT和Codex创建恶意电子邮件和代码有多么容易。”

“我认为,这些AI技术代表着日趋复杂和有效的网络能力在危险演进过程中又踏出了一步。网络安全世界快速变动,我们想要强调的是,在ChatGPT和Code日渐成熟的时候要保持警惕,因为这一不断发展的新技术会影响危险态势,可能带来好的影响,也可能带来坏影响。”

ChatGPT可能催生更多“脚本小子”

作为安全公司ExtraHop的高级技术经理,网络专家Jamie Moles用ChatGPT进行了自己的微型实验,实验结果与Check Point研究人员的类似。他的实验阐释了如何使用渗透测试软件Metasploit利用“永恒之蓝”漏洞(美国国家安全局(NSA)开发的计算机漏洞利用程序,于2017年4月被“影子经纪人”黑客团伙泄露)。

“ChatGPT可不仅仅是最热门的新时尚。”Moles说道,“这东西超级智能,影响好坏参半。其中一个潜在的负面用例就是能教会新手怎么做事。Metasploit本身并不是问题所在:没有什么工具或软件是天生坏种——除非遭到滥用。但是,教那些缺乏技术知识的人如何使用这种一旦滥用就会造成破坏的工具,可能会导致威胁增多,尤其是来自所谓“脚本小子”的威胁。”

“‘脚本小子’这个称谓通常用于描述几乎没有什么实际黑客经验,用其他有才黑客编写的脚本来攻击系统的青少年。他们最近频频出现在新闻报道中,但ChatGPT很可能会变成那个能写脚本的‘有才’黑客。”

上个月发布的时候,OpenAI表示设置了检查措施防止ChatGPT生成恶意代码,但发布之后人们找到了多种方式骗过这个系统,让ChatGPT认为产生恶意代码仅仅是出于研究目的。据说最新的更新补上了部分此类漏洞。

该公司声称:“尽管我们努力让模型拒绝不恰当的请求,但该模型有时仍会响应有害指令或表现出行为偏好。我们正在使用Moderation API警告或阻止特定类型的不安全内容,但预计目前会有一些漏报和误报。我们热切希望收集用户反馈,帮助我们目前的系统改进工作。”

生成的代码也不保证准确。开发人员用来问答代码问题的网站StackOverflow就禁止使用ChatGPT答案,理由是很大比例的答案是貌似正确的错误答案。

甚至OpenAI的首席执行官Sam Altman都警告称,ChatGPT尚未准备好投入主流应用,也不应在生产环境中依赖ChatGPT,因为这个模型仍会犯许多错误。他写道:“ChatGPT限制颇多,但在某些事务上表现够好,造成了这东西很伟大的错误印象。目前在任何重要事务上依赖ChatGPT都是个错误。这就是个进度预览:在稳健性和真实性方面我们还有很多工作要做。”

人本人工智能(People-Centred AI)高级讲师Eddy Zhu称,虽然ChatGPT是支撑很多现实应用的“人工智能重大里程碑”,但它并不完美。“ChatGPT会犯严重错误,产生误导用户的错误信息,这就是ChatGPT工程师们需要警惕的地方。”

声明:本文来自数世咨询,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。