联邦学习技术是一种分布式的机器学习框架。客户端通过共享梯度给服务器的方式保证了机器学习任务中客户端数据的隐私。近些年的研究表明,仅通过客户端共享的梯度信息仍然能够还原出客户端用户的数据信息。目前基于拉普拉斯机制与高斯机制的差分隐私技术被运用于联邦学习中,然而基于指数机制的差分隐私技术还未被完全探索。此外,客户端的身份信息与其梯度信息具有一定的关联性,联邦学习场景中客户端的身份隐私尚未被很好地研究。

为了解决联邦学习中存在的隐私问题,我们探索基于指数机制的差分隐私在联邦学习中应用的可能性,并提出FL2DP方案。该方案通过基于指数机制的差分隐私技术达到保护用户数据隐私与身份隐私的双重目的。

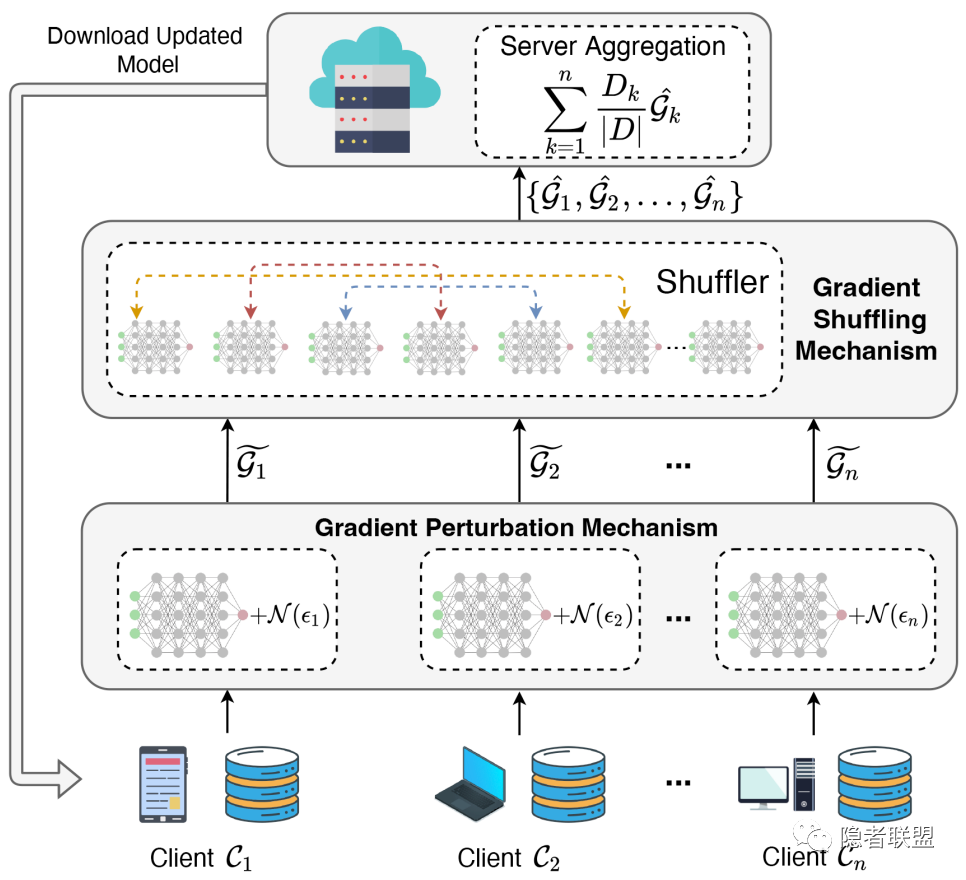

FL2DP的总体框架如图1所示。该框架包含梯度数据扰动与客户端身份扰动两个部分。客户端首先根据服务器下发的全局模型执行梯度下降算法,并根据历史梯度信息估算下一次梯度下降后,梯度中每个参数的范围 R,将 R作为该参数扰动区间。随后将扰动区间 R平均划分为 N 个候选扰动位置,最后根据差分隐私的指数机制选择最终的扰动位置。经过扰动的梯度上传至洗牌服务器对收集的梯度进行身份扰动。身份扰动方案使用欧氏距离与余弦相似度评估2 个梯度之间的差异性,根据基于指数机制的差分隐私对 2 个梯度的身份信息进行互换。最后,经过身份扰动后的梯度将被上传至服务器进行最终的联邦学习聚合。在实验方面,如图2 所示,FL2DP 方案在准确率、收敛速度方面均表现出了较好的性能。

图1 FL2DP框架示意图

图 2 MINIST数据集实验结果展示

论文信息

该研究已被IEEE TII 2023录用,作者是合肥工业大学计算机与信息学院的顾辰、崔选得、朱晓玲和胡东辉。

C. Gu, X. Cui, X. Zhu, and D. Hu*, “FL2DP: Privacy-Preserving Federated Learning Via Differential Privacy for Artificial IoT,” IEEE Transactions on Industrial Informatics, 2023, doi: 10.1109/TII.2023.3331726. (*通讯作者)

供稿:顾辰,合肥工业大学计算机与信息学院

声明:本文来自隐者联盟,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。