在2025年4月29日的RSAC大会上,思科执行副总裁兼首席产品官Jeetu Patel宣布其安全大模型即日起正式开源。

Jeetu Patel

Jeetu Patel指出:思科为其人工智能之旅的一个重要里程碑而感到自豪。我们新成立的基金会人工智能小组旨在为网络安全领域带来世界级的、特定领域的人工智能基础设施,我们自豪地推出其第一个版本:Llama-3.1-FoundationAI-SecurityLLM-base-8B(Foundation-sec-8b),这是一个80亿个参数、开放权重的大型语言模型(LLM),专为安全而构建。

该模型将深厚的领域专业知识与安全、现实世界部署所需的灵活性和控制相结合。使用Foundation-sec-8B,团队可以在整个安全生命周期中构建、微调和部署人工智能原生工作流。该模型旨在帮助安全团队更快地思考,精确地行动,并在不妥协的情况下扩展操作。

Jeetu Patel,2025RSAC大会现场

网络安全应用需要专门构建的、开放的、小型的模型。

如今,安全团队面临着前所未有的压力。威胁增长更快,攻击更加复杂,传统工具已经不够用了。人工智能正在成为一个关键的力量倍增器,但通用模型往往无法满足现实世界的安全工作流程。

提示和检索管道无法满足安全操作的精度、一致性和质量要求。微调封闭模型带来了自身的挑战:高成本、有限的控制和部署障碍——特别是在数据隐私、法规遵从性和环境内托管不可协商的情况下。与此同时,大多数开放模型缺乏安全团队所需的特定领域知识。

“Foundation-sec-8b是构建人工智能原生安全系统的基础一步,这些工具不仅可以处理数据,还可以真正理解安全领域。该模型为各地的安全团队提供了一个强大的构建模块,以加速防御,减少疲劳,并在复杂的威胁环境中获得清晰度。” Jeetu Patel如是说。

专门构建的安全模型

Foundation-sec-8b并不是为了安全而改装的通用模型。它的设计初衷是为了理解网络安全的语言、逻辑和工作流程。

使用Llama 3.1 8B框架,Foundation -sec- 8B已经在思科基金会人工智能精心构建的内部数据集上进行了预训练。该数据集是专门为捕获安全专业人员每天使用的现实世界知识和背景而精心策划的。它包括但不限于:

漏洞数据库和威胁行为映射(例如,cve、CWEs、MITRE ATT&CK)

威胁情报报告、红队剧本,以及真实世界的事件摘要

跨云、身份和基础设施领域的安全工具文档

遵从性参考和安全开发实践(例如,NIST、OWASP、安全编码指南)

这种领域一致性使得foundation-sec-8b 在分析人员的工作流程中立即有效-与通才模型相比,提供更深入的见解,更少的幻觉,以及更短的响应时间。

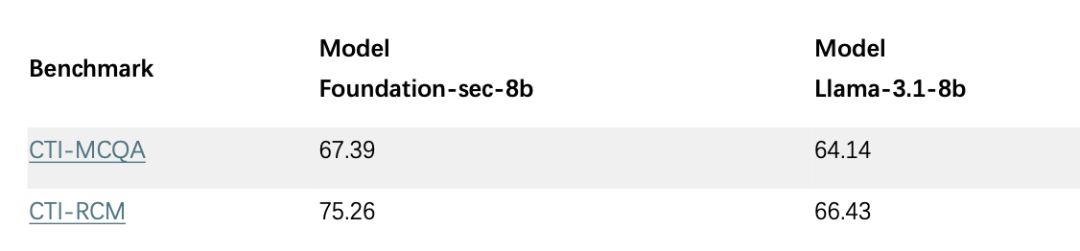

超出其重量的性能

尽管它的参数大小为8B,但foundation-sec-8b 的结果与大近10 倍的模型相当。在核心网络安全基准测试中,它的性能超过了Llama 3.1 8B,甚至达到或超过了Llama 3.1 70B,在成本和基础设施负担很小的情况下提供了强大的推理能力。

重要的是,foundation-sec-8b 保持了强大的通用语言性能,在MMLU 基准测试中与Llama 模型保持一致。这意味着它可以流畅地解释威胁行为,支持长篇调查叙述,并在基于聊天的工作流程中自然响应,而不会影响其安全重点。

通过微调,它的优势变得更加明显。在下游安全任务中——比如从非结构化威胁报告中提取MITRE ATT&CK 技术——经过微调的foundation-sec-8b 模型的性能明显优于同样大小的Llama 模型的微调。这加强了foundation-sec-8b 作为嵌入式安全工作流的基础模型和高影响力组件的价值。

实际应用-为适应您的环境而构建

Foundation-sec-8b 不仅仅是性能,它是多功能的。作为开放重量和建立在Llama 框架上,可以很容易地微调或扩展您自己的遥测,检测规则或威胁情报。无论您是将其嵌入到现有工具中还是构建全新的工作流程,foundation-sec-8b 都能适应您组织的独特需求。

安全团队可以在整个安全生命周期中应用foundation-sec-8b:

SOC加速-自动警报分类,总结事件,并协助调查

主动威胁防御——模拟攻击、对漏洞进行优先排序,并根据您的基础设施对威胁进行建模。

工程支持——交付人工智能辅助的代码审查,验证配置,并根据您的环境上下文评估合规性证据

自定义集成-微调模型以反映您的安全状态、语言和检测策略,确保在实际部署中的准确性。

“我们一直在与思科基金会AI 团队合作,探索如何在思科的内部安全堆栈中嵌入Foundation -sec-8b。我们对AI 模型的能力感到非常兴奋,它真正了解我们的领域,并可以跨用例扩展。”奥马尔·桑托斯,思科安全与信任组织(S&TO)杰出工程师指出。

从支持代理助理工作流到协助开发人员编写默认安全代码,foundation-sec-8b 是您可以构建的基础。

公开可用,考虑隐私和控制

在网络安全领域,信任是不可协商的。这就是foundation-sec-8b 是开放权重的原因,权重和令牌器是在许可许可下发布的。

这使得组织:

• 完全控制部署——在本地、气隙环境或安全的云飞地中运行模型

• 合规性信心——将敏感数据保留在本地;没有强制推理api 或第三方共享

• 自定义自由-适应和扩展模型架构或培训管道,以满足独特的安全和隐私需求

Foundation-sec-8b 现已可在hugsFace 上下载。

你也可以在我们的研究论文中阅读完整的技术细节。

在不久的将来,我们还计划将用于构建模型的训练管道开源。有关数据构建和训练过程的更多信息,请参考研究论文。

刚刚开始

Foundation-sec-8b 是思科基金会人工智能(Cisco Foundation AI)发布的第一个版本,该组织致力于构建推动未来十年网络安全创新的基础设施。这个模型为未来奠定了基础,在未来,人工智能不再只是一个附加功能,而是嵌入整个安全生命周期的基础功能。

而我们才刚刚开始。

在接下来的几个月里,思科基金会人工智能将发布:

一个网络安全推理模型,为复杂的安全工作流程带来可解释性和更深入的分析

一个新的基准套件,旨在评估现实世界的人工智能模型,从业者定义的安全任务

额外的工具和组件,帮助团队微调、操作,并将人工智能安全有效地嵌入到他们的安全堆栈中

Foundation-sec-8b开启了这扇门。接下来的事情将重塑防守者如何构建、应对和领导人工智能。

探索模型,加入社区,并帮助塑造下一代人工智能驱动的网络安全。

参考资料:https://blogs.cisco.com/security/foundation-sec-cisco-foundation-ai-first-open-source-security-model

作者:Yaron Singer

声明:本文来自数说安全,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。