引用格式

兰丽娜 黄莎莎 石瑞生.生成式人工智能教育应用的安全风险及应对策略,2025,31(03):046-056.DOI:10.3969/j.issn.1673-8454.2025.04.005

人工智能与未来教育

生成式人工智能教育应用的安全风险

及应对策略

兰丽娜 黄莎莎 石瑞生

摘 要:以ChatGPT为代表的生成式人工智能一经推出就在社会各界引起火爆反响,其强大能力预示着新的通用人工智能时代的到来,必将对各行各业产生深远影响。但相关安全问题引发人们对于其应用的担忧。对于以立德树人为根本任务的教育行业,如何在教育教学中安全、有效地使用生成式人工智能,是相关研究必须回答的关键问题。由此,从教育、技术、伦理多个角度分析生成式人工智能教育应用过程中的安全风险问题,并提出应对策略。其中,安全风险主要包括:生成式人工智能的不当应用,可能造成学生学习自主性降低、被错误信息误导等负面影响风险;生成式人工智能的数据安全和隐私保护不足,可能造成教育数据隐私泄露风险;生成式人工智能教育应用缺少伦理约束,可能带来伦理安全风险。据此,从教育理论、安全技术、科技伦理三方面提出对应的应对策略,主要包括:以培养学生批判性思维为目标的生成式人工智能与教育融合路径;面向生成式人工智能教育数据处理全生命周期的数据安全与隐私保护策略;生成式人工智能教育应用的科技伦理治理理念和方法。

关键词: 生成式人工智能;ChatGPT;人工智能教育;数据安全;隐私保护

中图分类号: G434

文献标志码: A

文章编号: 1673-8454(2025)04-0046-11

作者简介:

兰丽娜,北京邮电大学人文学院副教授,博士(北京 100876);黄莎莎,北京邮电大学人文学院硕士研究生(北京 100876);石瑞生,北京邮电大学网络空间安全学院副教授,博士(北京 100876)

基金项目:中国高等教育学会2023年度高等教育科学研究规划课题“生成式AI支持下的高等教育数字化推进策略与实践研究”(编号:23PXZ0419);2023年度中国—中东欧国家高校联合教育项目“人工智能时代生成式AI促进高等教育数字化变革研究”(编号:2023293)

一、引言

近年来,以人工智能为代表的数字技术正快速崛起,加速深化教育变革与创新发展[1]。党的二十大报告强调,要“推进教育数字化,建设全民终身学习的学习型社会、学习型大国”[2]。自2022年底以来,ChatGPT作为生成式人工智能工具的代表,因其高质量的回答、高效获取信息的方式以及自然连贯的对话等强大能力,在社会各界引起强烈反响,激起数字化教育时代人工智能教育应用的研究热潮[3]。生成式人工智能的强大能力预示着新的通用人工智能时代的到来,通用人工智能必将促进社会生产生活方式的深刻变革,对各行各业产生深远影响。然而,生成式人工智能也带来巨大的安全风险和伦理问题。一方面,生成式人工智能相关安全事件频发,凸显的安全风险不容忽视;另一方面,生成式人工智能相关的伦理问题,也引发人们对人工智能与人类科技伦理安全关系的思考。对于以立德树人为根本任务的教育行业,如何安全、有效地使用生成式人工智能是必须回答的时代之问。因此,需从教育理论、技术、伦理等多个角度开展研究。

基于此,本文对生成式人工智能在教育应用中可能存在的安全风险问题进行系统分析,探讨教育过程管理、数据隐私管理、伦理约束等三个方面的安全风险问题,并结合教育理论、安全技术、科技伦理,提出应对策略。首先,基于建构主义知识观理论,提出生成式人工智能与教育良性融合的路径,培养学生的批判性思维和解决问题高阶能力,实现生成式人工智能教育应用的正向积极影响;其次,从技术角度,提出面向生成式人工智能教育应用数据全生命周期的安全与隐私保护策略,以期实现教育数据的安全保护,减少教师和学生的隐私安全风险;最后,从科技伦理角度分析生成式人工智能教育应用的“师—生—AI”三维伦理关系,提出生成式人工智能科技伦理治理理念和方法,以期推进相关法律法规的制定,构建技术与教育互促共进的良性发展生态,促进人工智能教育应用健康发展。

二、生成式人工智能的特点与发展现状

ChatGPT以对话的方式进行人机交互,能够连续对话,可进行翻译、咨询、文案编写、编程等任务,生成内容堪比百科全书[4]。此外,ChatGPT不仅能够记忆上下文、连续回答问题,还能承认错误,质疑不正确的问题,并拒绝不适当的请求。ChatGPT于2022年底发布,是历史上用户增长最快的消费级应用[5],已有89%以上的美国大学生利用ChatGPT辅助学习和写作业[6]。ChatGPT升级版本GPT-4的能力有三个方面提升:①具有强大的识图能力,可以同时接受文本和图像形式的提问;②回答准确性显著提高;③能够生成歌词、创意文本、图像等。实验表明,GPT-4在各种专业测试和学术基准上的表现与人类水平相当,甚至超越人类[7]。生成式人工智能正在以惊人的速度迭代发展,对人类社会生产、生活和学习方式产生巨大影响。

根据对于ChatGPT等工具的基础测评,大语言模型在各类基础任务中取得了令人瞩目的效果,包括语言生成任务、知识利用任务和复杂推理任务。这三种能力极大地丰富了语言模型的教育应用场景。比尔·盖茨(Bill Gates)预言在未来5到10年内,ChatGPT等人工智能工具将革命性地改变人们的教学和学习方式[8]。国内外学者普遍认为,生成式人工智能在教育领域有巨大的发展潜力,可以使每名教师都拥有自己的人工智能助理,还可以帮助教师制定课程计划、批改作业等[9][10]。

然而,在普遍认为生成式人工智能具有赋能教育巨大潜力的同时,其安全风险和隐私保护问题也引发全球教育工作者的普遍担忧,甚至有批评者断言ChatGPT无非是“一台胡说八道的聊天机器人”。有研究提出,ChatGPT依赖的大语言模型算法可能存在偏见,导致生成价值观错误的信息,引发伦理问题[11]。王佑镁等认为,ChatGPT教育应用存在信息不实、伦理风险、学业诚信风险、过度沉迷依赖风险等,安全应用面临巨大挑战[12]。还有研究认为,在教育中使用ChatGPT存在隐私泄露风险,以及缺乏对学生的启发过程,影响学生创造力培养等问题[13]。

一系列ChatGPT相关安全事件的发生,凸显生成式人工智能应用的数据安全和隐私保护不容忽视。2023年3月20日,OpenAI发出公告表示ChatGPT因软件问题遭遇数据泄露事件[14][15],造成用户隐私泄露。由于存在安全问题,ChatGPT于2023年4月初在意大利被禁止使用[16]。该次禁用的主要原因是意大利数据保护机构认为模型存在隐私问题,并且没有限制用户的年龄,聊天机器人可能会对未成年人提供错误内容。意大利、法国、德国、瑞典、爱尔兰等欧盟国家就ChatGPT安全问题是否违反欧盟的《人工智能法案》(Artificial Intelligence Act)和《通用数据保护条例》(General Data Protection Regulation)展开讨论,意大利呼吁重视ChatGPT安全问题,其他国家表示该问题需要重视,但不会采用禁用的方式。同年4月末,在OpenAI满足意大利对于安全的一系列要求后,意大利解除对于ChatGPT为期一个月的禁用[17]。这次事件体现出各国对于人工智能安全的担忧以及政策的不确定性,要让生成式人工智能切实可靠地满足法律要求,必须把安全应用落到实处。

在教育领域,世界各国教育机构就生成式人工智能应用作出一系列规定。美国纽约教育局禁止学生在校园使用ChatGPT以规避可能发生的学术诚信危机[18];我国香港大学也公开制止学生在课程、评测、作业中使用ChatGPT,否则将视为抄袭[19]。由此可见,在生成式人工智能安全问题尚未得到解决,反应较快的教育机构采取禁用策略,以维护传统教学方式。这类政策在一定程度上可以维护教学质量,但在生成式人工智能高速发展的背景下,禁用并不能从根本上解决问题,教育机构必须直面生成式人工智能带来的挑战,提出一套实用、可靠的技术模型,并从教育伦理方面进行研究论证,找出其应用于教育实践的可行方式。

三、生成式人工智能教育应用

带来的安全风险

本研究从教育、技术和伦理角度,系统梳理生成式人工智能教育应用中可能引发的安全风险,发现问题主要聚焦在三个方面:①教育过程管理。生成式人工智能在教育中的不当应用,可能导致出现学生自主性被蒙蔽、被错误知识误导、创造力被弱化等负面影响风险。②数据隐私管理。教育大数据是一类深度涉及师生隐私的数据,对这些数据的不正当采集与使用,会造成信息的泄露、篡改和滥用,引发隐私安全风险。③伦理约束。目前缺少明确的限制规约与伦理准则约束生成式人工智能教育应用,可能存在“算法歧视”“责任推诿”“教育与技术伦理关系失衡”等科技伦理安全风险。

(一)负面影响风险

生成式人工智能的过度使用将蒙蔽学生的自主能动性。OpenAI的测试结果表明,目前GPT-4在现实场景中的能力可能不如人类,但在各种专业和学术考试如GRE、数学、法律、程序竞赛等方面明显超越人类。表面上看起来,生成式人工智能能够帮助学生快速获得信息、完成作业,使学习过程变得轻松愉悦,但知识探究、逻辑推理、总结归纳等学习过程的缺失使得学生难以深入理解知识。如果学生错误地将生成式人工智能看作“代替自己学习”的工具,结果会使其逐渐丧失自主学习能力,背离了智能技术助力学习和生命成长的育人初心。另外,生成式人工智能产生的错误信息可能会误导学生。ChatGPT工作原理是基于Transformer等基础算法对已有的知识、信息进行“遍扫”[20],理解信息间复杂逻辑的能力仍然有限,不能像人类一样完整理解知识体系与知识间的内在联系,因此很容易生成“看似合理、实则错误”的答案。例如,对于问题“边长为1、3、5的三角形和边长为2、6、10的三角形是相似三角形吗”,ChatGPT会非常自然地回答“是的”;但是这个回答并不正确,因为它不能发现“边长1、3、5和边长2、6、10是不能构成三角形的”。由此可见,如果对生成式人工智能生成的信息不能正确判断和使用,则可能对学生产生误导,引起学习迷航与认知障碍。

因此,如何将生成式人工智能恰当地融入教育过程,规避可能发生的教育负面影响,提升学生提出问题、分析问题和解决问题的高阶综合能力,是生成式人工智能教育应用的一个关键问题。

(二)数据隐私风险

ChatGPT等生成式人工智能工具在运行中会大规模收集和处理个人数据来训练其算法,数据收集、使用还缺乏必要的法律规范和约束,未采用有效的隐私保护措施对收集的海量数据进行安全管理。越来越强大的算力与模型,意味着面临更大的数据安全和隐私泄露风险[21]。生成式人工智能教育应用会产生大量的教育数据,包括师生输入的数据及教学过程产生的数据,内容包括学生的个人档案、问答记录、学习过程数据等。这些数据的重组、分析挖掘可能会对学生的隐私造成一定影响[22],侵犯教师、学生的人身安全和言论自由。固化的标签也可能会阻碍学生发展。如果这些数据被不法分子窃取、泄露、篡改,将对个人和整个社会造成巨大的损失和影响。

因此,生成式人工智能教育应用需高度重视数据隐私保护问题。而采取相应措施使生成式人工智能能够安全地采集、存储、使用和处理教育数据,避免隐私泄露,保障数据和用户个人隐私安全,是生成式人工智能教育应用健康发展的前提和关键。

(三)伦理安全风险

生成式人工智能教育应用是一种特殊的教育实践活动,涉及教育伦理和人工智能教育伦理。教育伦理是指在教育观念或原则的指导下,对一系列教育活动的开展进行约束和规范的行为准则,其目的在于促进个体自由而全面的发展;人工智能教育伦理则是进一步规范和约束人工智能应用在教育活动中的道德标准和行为准则,及时规约伦理风险的发生,正确权衡人和人工智能之间的关系,实现“智能育人”的价值[23]。

一方面,人工智能伦理约束指在道德的轨道上,制定人工智能技术开发、管理、应用等应遵守的伦理原则和行为规范。生成式人工智能的性能和可靠性,很大程度上依靠生成算法与训练数据的质量。因此,技术人员如何定义数据与算法,将对生成式人工智能教育应用的可靠性形成巨大冲击。技术人员选取数据、训练模型不一定能确切地体现出真实的现实情况,算法设计者和开发者很可能将其主观偏见带入算法系统,导致人工智能系统生成一部分错误决策。此外,技术人员使用的数据中,极有可能存在容易被人忽视的错误价值取向,以及当地风俗特征,一旦发生此类价值取向问题,便很难在短时间内纠正,极有可能对社会文化发展产生不利影响。

另一方面,如何理解生成式人工智能与教师、学生之间的伦理关系,成为教育实践需要解决的问题。教育数字化转型仍缺乏必要的伦理规约。教育的本质是育人,如果教师和学生未能以正确的、发展的眼光看待生成式人工智能应用场景下的师生伦理关系,将导致教育失去温度,妨碍教育育心、育德、育人本质的实现,使教育变得机械化。生成式人工智能是帮助学校提高教育教学质量的手段,教育立德树人的根本任务不能变,人文精神不能变,中华民族的优秀传统不能变。

四、生成式人工智能教育应用安全风险的应对策略

(一)培养学生的批判性思维

“知识”一词被《辞海》定义为“人类智慧的结晶,包括经验知识和理论知识”,而知识观是一种对知识的重新认知,指对知识的观点及看法。知识是教育的基础,其构成了课程和教材的核心内容,而教育则是以知识为载体促进学生全面发展的活动。教育学中的知识观是指对知识来源、价值、认识过程等的综合看法,以及在知识根本看法的基础上,对知识进行再组织、加工、转化和传播及综合运用[24]。可见,教育学中的知识观不仅关注知识的来源、具体内容等,还关注人对知识的意义建构过程。

生成式人工智能的出现使知识的获取方式变得高效便捷,通过与其“对话”就能够很容易地获得知识。可以说,生成式人工智能在人类已有的任何知识领域具有绝对优势,其作为对话机器人,准确来说是“续写”机器人,基本能力就是掌握已有知识中的组合规律,然后根据提问者给出的N个词汇,分析第“N+1”个词汇的最大概率。例如,ChatGPT很容易回答出“计算机的组成结构是什么”的答案是“处理器、RAM、存储设备、主板、显示器、GPU、输入设备、输出设备、电源”,因为它从大量语料的统计数据中分析出,“计算机的组成结构是”这几个词语后面大概率会出现这些词语。生成式人工智能基于已有大量数据训练而成,因此具有难以克服的缺陷:①由于无法了解客观事实,只了解词汇间的规律,因此很容易犯事实性错误,作出不符合客观事实的回答。②由于回答均源自人类已有的主流观点,因此可能加剧信息茧房现象,影响生成信息的全面性、客观性。由此可见,培养学生辨别知识真伪、生成新知识、运用知识解决实际复杂问题的能力,成为生成式人工智能教育应用的重点目标。

建构主义源自儿童认知发展理论,用以说明个体的认知发展与学习过程密不可分。20世纪90年代起,建构主义对教育的发展与变革产生了深远影响。建构主义知识观描述了知识的本质和如何建构知识[25],即知识并非仅仅是一种客观的反映,而是一种解释或者假设,也非一个绝对的结论。在解决特定问题时,必须根据特定环境对知识进行重新加工创造。知识“习得”过程必须建立在学习者的经验和背景之上,否则就不是“习得”,而是死记硬背或复制式学习。因此,根据建构主义知识观理论原则,在生成式人工智能应用于教育教学的过程中,学生如果不对其生成的答案基于自身的经历和知识背景,理解知识、分析知识的合理性,知识的接收是没有任何意义的。许多教育学者发现建构主义知识观的价值,将其作为进行更加有效的教学过程设计的理论基础,主要通过合作交互、小组作业、社会实践等方式实施教学过程[26]。

生成式人工智能允许学习者以问答的方式高效获取知识信息,建立与已有知识之间的联系,完成知识的建构过程。然而,决定学习者能否完成生成式人工智能支持下的知识建构过程的核心要素是“批判性思维”。批判性思维指学生独立评估知识的真实性、准确性和价值,从而对“相信什么”和“如何运用知识”作出合理决策的思维活动。提升学生的批判思维能力是生成式人工智能与教育融合发展的必然要求,面对生成式人工智能输出的看似合理、实则真伪难辨的信息,只有主动思考,从中发现并提出问题,才能获得创新的结果,“习得”新知。杜威在《民主主义与教育》中强调,通过设计真实的活动情境,可以唤醒学生的批判性思维,从而获得更多的创新思考和成果,而非仅仅依靠预先准备的知识[27]。因此,生成式人工智能是培养学生批判性思维的良好工具。

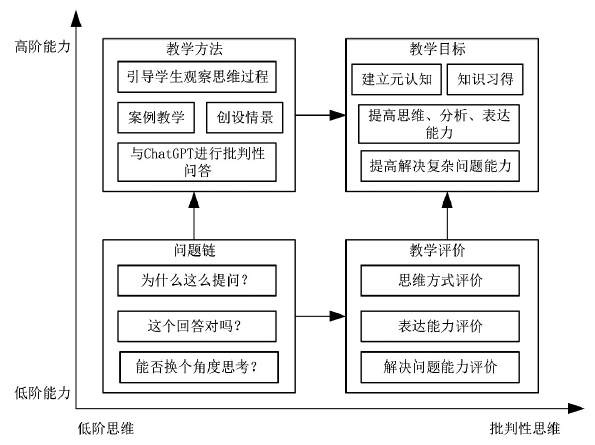

在生成式人工智能的支持下,本研究提出人机协同教学环境下知识建构和批判性思维培养策略,如图1所示。

图1 人机协同教学环境下知识建构和批判性思维培养策略

具体策略如下:

首先,以问题链驱动思考和思维过程,推动问题的解决。鼓励学生多提问,主动思考,勇于质疑生成式人工智能给出的答案。引导学生多与生成式人工智能进行“批判性对话”,让学生在对话与提问的过程中独立反思,多提出促进批判性思维发展的问题,如“为什么这么提问”“这个回答对吗”“能否从另一个角度思考问题”等。进而引导学生进行更深度的思考,自我补足知识探究、逻辑推理、总结归纳等学习过程,发现生成式人工智能给出的错误答案或不足之处,以达成知识建构、培养批判性思维、发展创造力的目的。

其次,教师在课堂上采取案例教学方法,创设真实情景,引导学生进行思考与辩论,各抒己见。在这个过程中,教师可以使用生成式人工智能等辅助工具,拓展讨论的广度与深度,同时要求学生在表达时加入自己的理解,用自己的表达方式陈述自己的观点。案例教学注重批判性思维过程本身,而非问题答案的正确与否。在案例教学中,学生会主动理解问题信息,识别判断信息,并尝试着理解事件冲突的原因,发现问题后主动与自身已具备的经验知识建立联系,最后通过收集和辨析更多的信息作出决策,并向同学陈述自己的观点。在案例教学中,生成式人工智能成为学生思维发展的辅助性工具,帮助学生学习知识常识,从而启发思维。

再次,注重对学生高阶思维能力、表达能力、解决问题能力的评价。在生成式人工智能协作学习环境中,传统的考核方式由于拘泥于学科知识而非思维能力产出,难以评估学生的真实理解程度,不能满足现代教育评价的需求,因此需设计新的生成式人工智能协作学习效果评价机制。考核内容需具备高阶性和开放性,与真实的问题情境相关,注重考查学生的批判思维能力、表达能力和解决实际问题能力,并重点关注学生与生成式人工智能协作过程中的思维过程(Q&A过程),以及学习成果中的生成性内容,促进学生在使用生成式人工智能的过程中,进行独立思考。

最后,在生成式人工智能支持下,促进学生对自身认知的认识和调节,建立起元认知,培养学生的自主学习能力。基于学生已有背景和经验,通过知识的加工创造实现知识建构,达成知识“习得”,最终提高学生的思维能力、分析能力、表达能力、解决复杂问题能力。

以上策略表明,生成式人工智能教育应用的关键在于培养学生的批判性思维,即在生成式人工智能的支持下,从问题链出发,通过批判性、反思性的问题设计,将问题链应用到教学方法中,培养学生从低阶能力向解决复杂问题综合能力等高阶能力发展;将问题链应用到教学评价中,培养学生从低阶思维向批判性思维、创造性思维等高阶思维能力发展,从思维能力培养和解决问题综合能力培养两个方向,实现高阶性、创新性教学目标。

(二)形成全生命周期的数据安全与隐私保护策略

生成式人工智能教育应用会产生大量数据,因此存在数据安全和隐私保护问题。研究者一直在努力解决教育数据的隐私问题。例如,有研究利用先进的大数据隐私保护技术解决教育数据共享和深度分析中的隐私泄露问题[21];有研究强调数据主体的知情同意权,认为数据所有者应该了解人工智能模型如何收集他们的个人信息。2021年9月,我国发布实施《中华人民共和国数据安全法》,数据采集方对于重要隐私数据的安全保护已经成为法律责任。

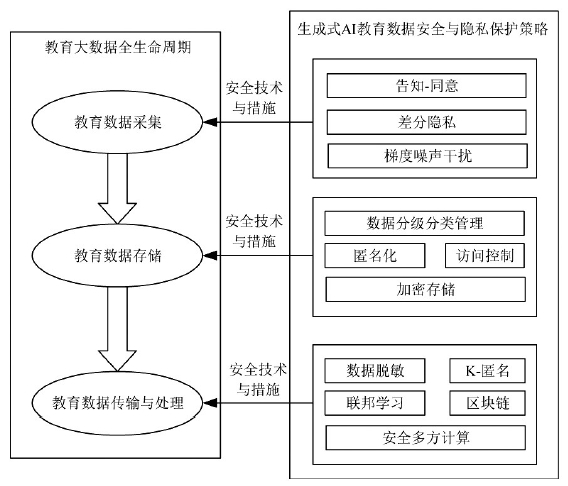

生成式人工智能教育应用中的数据安全和隐私保护,需要在技术和法律法规上进行规范治理。本研究面向教育大数据全生命周期,提出生成式人工智能教育数据安全与隐私保护策略,如图2所示。

图2 生成式人工智能教育数据安全与隐私保护策略

具体策略如下:

首先,在教育数据采集阶段,根据《中华人民共和国个人信息保护法》规定,应以“告知—同意”为核心处理原则,采集过程中必须事先告知数据所有者主体,采集哪些信息,以及采集信息的用途,保障师生在个人信息处理活动中的各项权利。同时可采用差分隐私(Differential Privacy)技术[28],在不破坏数据样本及其关联性的前提下采集数据并用于模型训练。差分隐私技术使得窥探者即使获得数据,也无法逆向推断出用户原始敏感数据信息。

其次,在教育数据存储阶段,应依法实施教育数据分级分类保护措施,按照数据内容特点和数据一旦泄露的危害程度将数据逐级归类。一般地,涉及师生姓名、身份证号、家庭住址等精度较高、规模较大,一旦泄露可能危害师生人身安全、危害国家公共安全的数据纳入核心级数据;精度较低或进行匿名化处理后的数据纳入重要级数据;其他数据归为普通级数据。对于核心级、重要级数据,必须进行加密存储,其中核心级数据可使用不可逆的加密算法,提高安全保护程度。对于普通级数据应做好访问控制等安全防护措施。

最后,在教育数据传输与处理阶段,必须重视隐私安全,数据处理过程应在不识别个人身份敏感信息的前提下进行,保护师生的名誉权、隐私权,维护师生的人格自由,最大程度避免“人肉搜索”等网络暴力事件的发生。在处理核心级、重要级数据时,采用区块链等技术验证数据的完整性,防止数据被恶意篡改。采用安全多方计算、联邦学习、k-匿名化、数据脱敏等技术手段实现对用户隐私信息的隐藏或混淆,在确保数据隐私不可追踪的前提下,满足生成式人工智能大语言模型的训练要求。

在采取技术手段保护用户数据隐私的同时,也要提高人们的数据隐私安全意识。美国《2024年EDUCAUSE地平线行动计划:统一数据模型》提出,教育数据隐私保护成功与否很大程度上取决于数据所有者和数据管理者的隐私安全意识、隐私保护参与程度[29]。未来需加强师生隐私保护、数据安全技能方面的培训和教育,尽量避免师生将个人隐私信息上传,从源头上降低教育数据隐私泄露风险。

(三)探索科技伦理治理理念和方法

生成式人工智能与教育教学过程日益融合,推动教育数字化的深化,其治理离不开相关伦理规范的约束,需有效引导该融合过程有序健康地发展,提升生成式人工智能教育应用的安全性、合理性。

生成式人工智能教育应用的科技伦理治理理念和方法如下:

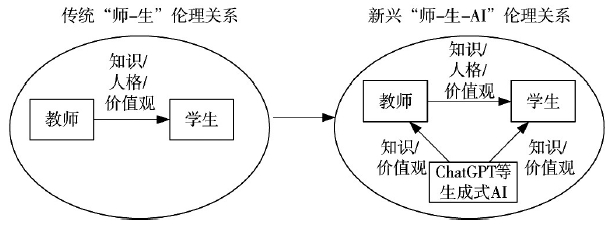

一方面,正确认识生成式人工智能支持下的“师—生—AI”三维伦理关系。人工智能是智能性协同工具,教师仍然是育人的责任主体,其道德传授示范作用不可替代。师者,传道授业解惑者也。从古至今,教师一直担当着文化传承、言传身教的培育重任,教师由于拥有更广阔的知识、更丰富的经验一直处于权威地位,形成师道尊严、学生听从敬畏教师的师生伦理关系。在传统的“师—生”二维伦理关系中,教师向学生传授知识,培养和影响其人格品质,传递正确价值观。

深入探究教育活动中的人机伦理关系是生成式人工智能教育应用的重要前提[30]。生成式人工智能凭借其高效的知识生成、内容创造能力成为新的知识中心。它的介入将师生关系由传统的“师—生”二元主体转变为“师—生—AI”三元关系。教师不再是学生习得知识的唯一来源,师生之间的伦理关系受到严重冲击,形成新的“师—生—AI”三维伦理关系。师生伦理关系的变化如图3所示。

图3 师生伦理关系变化

在新型的“师—生—AI”三维伦理关系中,学生不仅从教师处获取知识、受到人格影响和价值观影响,同时从生成式人工智能工具中获取知识和价值观;教师也从生成式人工智能工具中获取知识和价值观。生成式人工智能因其强大的生成能力和随时陪伴特点,成为师生的重要智能性辅助工具。需要注意的是,生成式人工智能欠缺人类基于基本情感、价值观念的直觉判断[31],在现实感知能力、道德传授和情感表达上具有局限性。学生受教师人格品质、道德修养的影响是生成式人工智能所不能替代的,因此,教师仍然是教育教学的责任主体,教师的作用并没有减少,仍是不可或缺的。

教师不仅是知识的讲授者,还是学生知识建构过程中的引导者、督促者。教师要引导学生使用好生成式人工智能工具,利用人工智能发展自己的能力、收获智慧。在生成式人工智能的支持下,教师应与学生进行有温度的交流,毕竟教育需将学生培养成“人”而非机器,塑造学生的灵魂而非灌输知识。教师还应引导学生负责任地使用生成式人工智能,告诫学生不要沉迷于向其索取帮助从而失去最珍贵的探索与分析能力,让学生懂得发展能力、收获智慧才是真正的成长[32]。

另一方面,加快完善生成式人工智能教育应用伦理规范,并将伦理规范嵌入应用的全生命周期中,从科研开发人员、人工智能产品和教育应用等方面全方位加强审查及监管力度,确保算法公正性和合规性,实现科技向善发展。随着生成式人工智能教育应用的纵深发展,其治理面临着伦理约束和制度监管的现实困境。生成式人工智能的运行高度依赖海量数据和模型算法,而数据的选择和算法的生成依赖于技术人员,因此应科学引导科研、开发人员充分认识人工智能伦理可能带来的影响,为开发人员制定相应的道德规范和行为准则,强化底线思维和风险意识,引导人工智能教育应用向上向善发展。此外,还要加强生成式人工智能产品及其教育应用中的算法监管,提高算法的透明度和可解释性[33],严格制定算法开发规则制度[34],坚持推进智能教育技术创新与风险防范相统一,确保生成式人工智能教育应用的公开透明、合法合规。

生成式人工智能的开发与改进是一个不断迭代的过程,从技术维度出发,需要仔细考虑模型输出的安全性、算法歧视和偏见等方面的问题,及时开展相关的伦理风险研判和预警,开展负责任的科技创新,始终坚持科技向善的观念,对违法行为进行有效监督和制止,从而促进人工智能教育应用的安全高效与可持续发展。同时,未成年人的保护工作也需高度重视,建立有效的未成年人身份识别机制,并严格执行“青少年模式”,对未成年人使用生成式人工智能的用途和时间进行限制,防范滥用、依赖等安全风险隐患;还要推动家庭和学校联动,指导学校深化家校共建,向家长开展有针对性的智能技术伦理安全教育。

五、结语

生成式人工智能助推教育数字化进程日益呈现“智能特性”,赋能教育无限潜能。生成式人工智能教育应用的安全风险涉及教育过程管理、教育数据隐私保护、科技伦理约束等方面问题,需要全面考虑,并采取多层次、综合性的应对策略,包括生成式人工智能与教育的深度良性融合路径、数据安全与隐私保护策略、科技伦理约束三方面的工作。未来,本研究将进一步深入探讨这些问题,并提出更加高效和可行的解决方案,以推动生成式人工智能教育应用的安全和可持续发展。

参考文献:

[1]卢强.教育数字化转型下技术革新教学推进路径的审视与展望[J].现代教育技术,2023,33(1):17-28.

[2]习近平.高举中国特色社会主义伟大旗帜 为全面建设社会主义现代化国家而团结奋斗——在中国共产党第二十次全国代表大会上的报告[EB/OL].(2022-10-25)[2024-7-20].http://www.gov.cn/xinwen/2022-10/25/content_5721685.htm.

[3]王佑镁,王旦,梁炜怡,等.“阿拉丁神灯”还是“潘多拉魔盒”:ChatGPT教育应用的潜能与风险[J].现代远程教育研究,2023,35(2):48-56.

[4]Bubeck S, Chandrasekaran V, Eldan R, et al. Sparks of artificial general intelligence: Early experiments with GPT-4[J/OL].[2024-10-14]. 2023,arXiv: 2303.12712v1.

[5]陈萍,杜伟.史上增速最快消费级应用, ChatGPT月活用户突破1亿[EB/OL].(2023-02-03)[2024-7-20]. thepaper.cn/newsDetail_forward_21787375.

[6]study.com. Productive Teaching Tool or Innovative Cheating?[EB/OL].(2023)[2024-10-14]. https://study.com/resources/perceptions-of-chatgpt-in-schools.

[7]ZHAO W X, ZHOU K, LI J, et al. A survey of large language models[OL].(2023)[2024-7-20]. Computer Science, 2023, arXiv: 2303.18223.

[8]BILL G. The Age of AI has begun.[EB/OL].(2023-03-21)[2024-10-14]. https://www.gatesnotes.com/The-Age-of-AI-Has-Begun.

[9]李志民.ChatGPT本质分析及其对教育的影响[J].中国教育信息化,2023,29(3):12-18.

[10]ROOSE K. Don’t ban chatgpt in schools. teach with it[EB/OL].(2023-01-12)[2024-10-14]. https://www.nytimes.com/2023/01/12/technology/chatgpt-schools-teachers.html.

[11]QADIR J. Engineering education in the era of ChatGPT: Promise and pitfalls of generative AI for education[EB/OL].(2022-12-30)[2024-10-14]. https://www.techrxiv.org/articles/preprint/Engineering_Education_in_the_Era_of_ChatGPT_ Promise_and_Pitfalls_of_Generative_AI_for_Education/21789434.

[12]王佑镁,王旦,梁炜怡,等.ChatGPT教育应用的伦理风险与规避进路[J].开放教育研究,2023,29(2):26-35.

[13]DAVID B, LETIVIA O A. Education in the era of Generative Artificial Intelligence(AI): Understanding the potential benefits of ChatGPT in promoting teaching and learning[EB/OL].(2023)[2024-10-14].https://papers.ssrn.com/sol3/papers.cfm?abstract_id=4337484.

[14]OpenAI. March 20 ChatGPT outage: Here’s what happened[EB/OL].(2023-03-20)[2024-7-20]. https://openai.com/index/march-20-chatgpt-outage/.

[15]网易.OpenAI 道歉:Redis bug 致 ChatGPT 故障、数据泄露(2023-03-25)[2024-7-20].[EB/OL]. https://www.163.com/dy/article/I0N6HEIT0511D6RL.html.

[16]RYAN B. Italy became the first Western country to ban ChatGPT. Here’s what other countries are doing[EB/OL].(2023-04-04)[2024-10-14]. https://www.cnbc.com/2023/04/04/italy-has-banned-chatgpt-heres-what-other-countries-are-doing.html.

[17]KRISTI HINES. ChatGPT ban bifted: OpenAI complies with italian privacy regulations as EU AI act moves forward[EB/OL].(2023-04-29)[2024-10-14]. https://www.searchenginejournal.com/chatgpt-ban-lifted-eu-ai-act-progress/485679/.

[18]BARRABI T. New York City schools block access to ChatGPT over cheating concerns[EB/OL].(2023-01-05)[2024-10-14]. https://nypost.com/2023/01/05/nyc-schools-block-access-to-chatgpt-over-cheating-concerns/.

[19]YAU C, CHAN K. University of Hong Kong temporarily bans students from using ChatGPT, other AI-based tools for course-work[EB/OL].(2022)[2024-10-14]. https://www.scmp.com/news/hong-kong/education/article/3210650/university-hong-kong-temporarily-bans-students-using-chatgpt-other-ai-based-tools-coursework.

[20]卢宇,余京蕾,陈鹏鹤,等.生成式人工智能的教育应用与展望——以ChatGPT系统为例[J].中国远程教育,2023,43(04):24-31,51.

[21]GURSOY M E, INAN A, NERGIZ M E, et al. Privacy-preserving learning analytics: Challenges and techniques[J]. IEEE Transactions on Learning Technologies, 2016,10(1): 68-81.

[22]李青,李莹莹.大数据时代学习者隐私保护问题及策略[J].中国远程教育,2018(1):29-36.

[23]陈倩倩,张立新.教育人工智能的伦理审思:现象剖析与愿景构建——基于“人机协同”的分析视角[J].远程教育杂志,2023,41(3):104-112.

[24]FOSNOT C T, PERRY R S. Constructivism: A psychological theory of learning[J/OL]. https://www.semanticscholar.org/paper/Constructivism%3A-a-psychological-theory-of-learning-Fosnot/a1430d67ee91e76226e26d8591bd47ea8cbc443c.

[25]DANIEL B K. Big data and data science: a critical review of issues for educational research[J]. British Journal of Educational Technology, 2019,50(1):101-113.

[26]STAGE F K, MULLER P A, KINZIE J, et al. Creating learning centered classrooms: What does learning theory have to say?[J/OL]. https://eric.ed.gov/?id=ED422778.

[27]DEWEY J. Democracy and Education[M].1916.

[28]牛翠翠,潘正芝,刘海.差分隐私生成式对抗网络的框架与方法综述[J].贵州师范大学学报(自然科学版),2022,40(4):84-99,120.

[29]屈冬,万伟韬.统一数据模型在高等教育中的未来趋势与实施路径——《2024年EDUCAUSE地平线行动计划:统一数据模型》解析与思考[J].中国教育信息化,2024,30(12):72-79.

[30]胡小勇,黄婕,林梓柔,等.教育人工智能伦理:内涵框架、认知现状与风险规避[J].现代远程教育研究,2022,34(2):21-28,36.

[31]孙那,鲍一鸣.生成式人工智能的科技安全风险与防范[J].陕西师范大学学报(哲学社会科学版),2024,53(1):108-121.

[32]刘三女牙,郝晓晗.生成式人工智能助力教育创新的挑战与进路[J].清华大学教育研究,2024,45(3):1-12.

[33]张伟.智慧教育赋能教育强国研究:大语言模型视角[J].中国教育信息化,2024,30(12):3-12.

[34]程乐.生成式人工智能的法律规制——以ChatGPT为视角[J].政法论丛,2023(4):69-80.

Security Risks and Countermeasures of Generative AI Educational Applications

Lina LAN1, Shasha HUANG1, Ruisheng SHI2

(1.School of Humanities, Beijing University of Posts and Telecommunications, Beijing 100876;

2.School of Cyberspace Security, Beijing University of Posts and Telecommunications, Beijing 100876)

Abstract: The emergence of generative artificial intelligence (GAI), represented by ChatGPT, has sparked widespread attention across society, with its formidable capabilities heralding a new era of general artificial intelligence that is poised to profoundly impact all sectors. However, its associated security concerns have raised apprehensions regarding its applications. For the education sector, whose fundamental mission is fostering virtue and nurturing talent, the critical question that must be addressed is how to safely and effectively integrate GAI into teaching and learning practices. This paper analyzes the security risks in the process of generative AI education application from the perspectives of education, technology and ethics, and puts forward corresponding countermeasures. Security risks include: (1) the improper use of GAI may negatively impact students’ learning autonomy and expose them to misinformation; (2) inadequate data security and privacy protections could lead to breaches of sensitive educational data; and (3) the lack of ethical constraints in GAI applications may result in ethical safety hazards. In view of the above risks, this paper puts forward corresponding countermeasures from three aspects of education theory, safety technology and science and technology ethics, including: the integration path of generative AI and education aimed at cultivating students’ critical thinking; Data security and privacy protection strategies for the full life cycle of generative AI educational data processing; The scientific and technological ethical governance concepts and methods of generative AI educational application. These strategies are expected to provide references for the research and practice of generative AI educational application and promote the healthy development of the educational application of AI technology.

Keywords: GAI; ChatGPT; AI education; Security risk; Privacy protection

编辑:王晓明 校对:李晓萍

声明:本文来自中国教育信息化,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。