你害怕吗?模型开源后有一天收到了海量用户的数据主体权利实现的请求,仅仅因为你基于某个开源AI模型进行了开发。

摘要

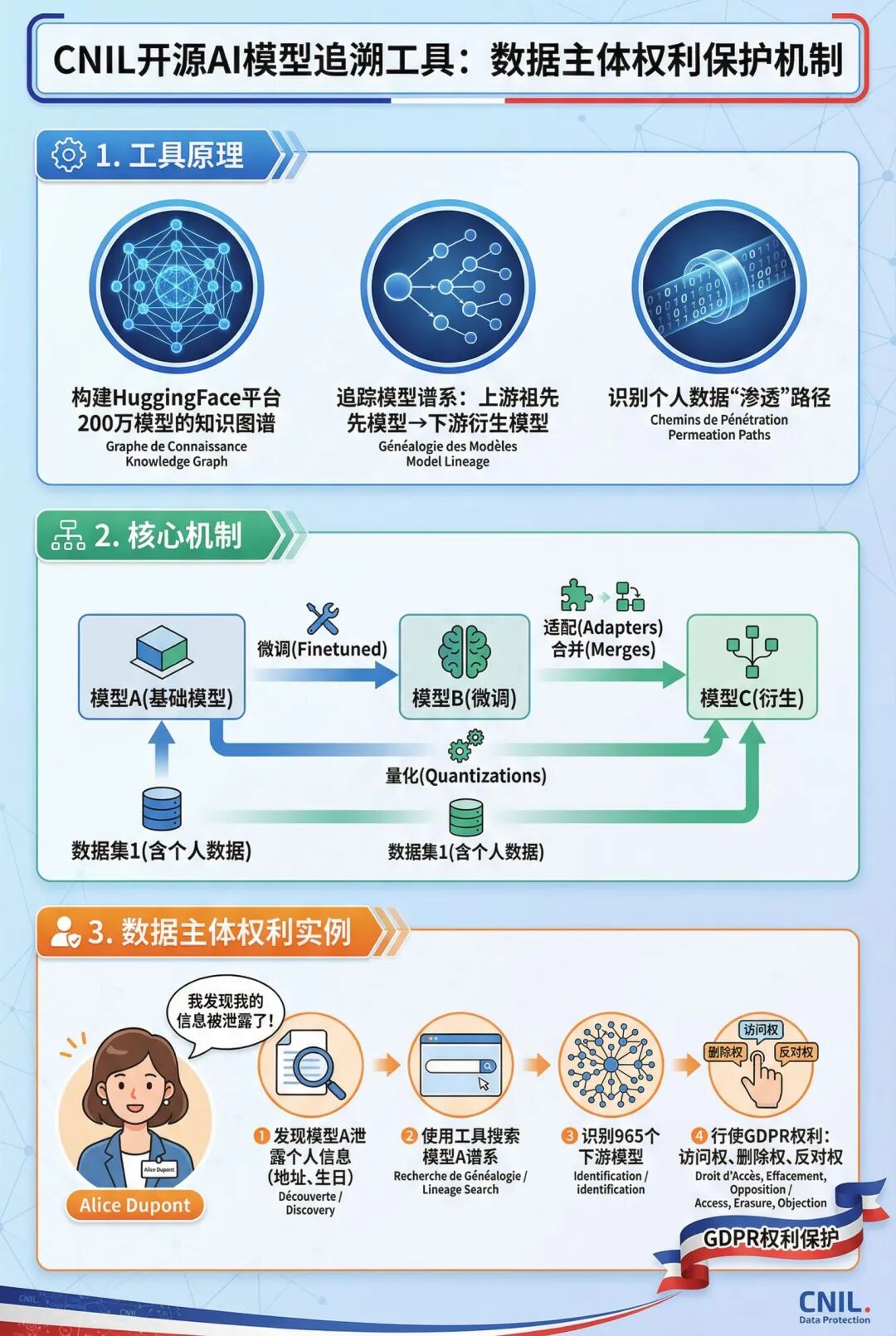

本文档概述了法国国家信息与自由委员会(CNIL)为应对开源人工智能(AI)生态系统中的数据保护挑战而开展的一个实验性项目。核心问题在于,AI模型可能“记忆”并“反刍”其训练数据中包含的个人信息。当这些模型被自由共享、修改和再发布时,个人数据会像水流一样“渗透”到下游的衍生模型中,形成复杂的谱系关系,这使得追踪数据和行使《通用数据保护条例》(GDPR)赋予的权利(如访问权、删除权)变得极其困难。

为应对这一挑战,CNIL开发了一个演示工具,该工具能够利用HuggingFace平台上的数据,构建并可视化AI模型的谱系图。该工具旨在探索在开源环境中行使数据权利的具体场景,帮助识别一个已知含有个人数据的模型的所有潜在受影响的后代模型。此项目不仅展示了技术上的解决方案,也旨在为CNIL在动态发展的开源AI领域如何适用GDPR提供决策依据,并凸显了在当前生态系统中明确模型发布者责任的必要性。

1. 背景:开源AI、数据记忆与GDPR

随着开源AI技术的发展,研究人员、企业和个人能够广泛访问、使用和修改AI模型,用于文本生成、翻译或音频转录等多种任务。用户在下载模型后,通常会使用新数据对其进行修改或专门化,然后将新模型再次开源。这一过程创造了一个复杂的模型生态系统。

1.1 模型谱系与数据记忆

模型谱系 (Model Genealogy):每个开源模型都属于一个谱系。这个谱系由两部分构成:

上游模型 (Ancestors):直接或间接用于创建当前模型的源模型。

下游模型 (Descendants):由当前模型衍生出的所有后续模型(子模型、孙模型等)。 因此,描述和检索模型谱系是理解模型构成的“不可或缺的一步”。

数据记忆与反刍 (Memorization and Regurgitation):学术界早已证实,AI模型,特别是生成式模型,会“记忆”其训练数据库中的信息。在特定条件下,模型会“反刍”(regurgitate)这些信息,即生成与训练数据高度相似的内容。如果训练数据包含个人数据(这在生成式AI中很常见),那么模型就有可能泄露这些敏感信息。

1.2 GDPR的适用性

欧洲数据保护委员会(EDPB)在其28/2024号意见中指出,当模型部分基于个人数据进行训练时,在大多数情况下应被视为受GDPR的约束。数据控制者有责任证明无法从模型中提取或推断出个人数据,才能豁免GDPR的适用。

对于受GDPR约束的AI模型,数据主体拥有对其数据的特定权利,包括反对权、访问权和删除权。然而,这些权利并非绝对。根据GDPR第12条,当请求“明显没有根据或过度”时,数据控制者可以拒绝;或者当控制者无法识别相关数据主体时,也可能无法履行义务。

2. 核心挑战:数据“渗透”与可追溯性

开源AI生态系统的核心挑战之一是个人数据的“渗透”(ruissellement)现象,这极大地增加了数据保护的复杂性。

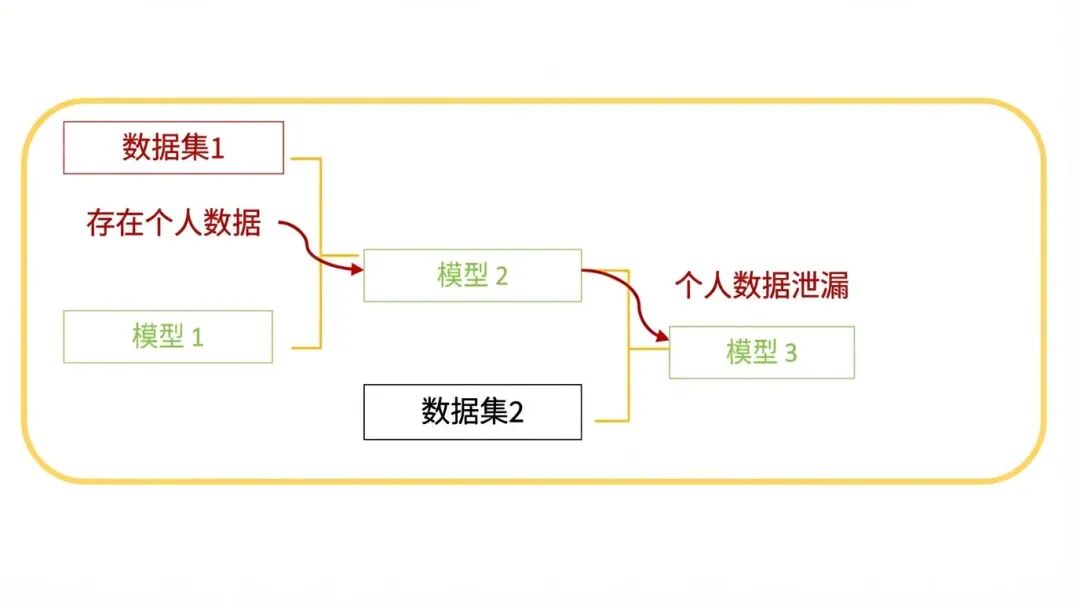

渗透机制:当一个模型(例如下图中的“模型2”)使用了包含个人数据的“数据集1”进行训练后,这些个人数据就被“记忆”在模型中。如果之后有其他用户基于“模型2”创建了新的“模型3”,那么“数据集1”中的个人数据就有可能随之传递到“模型3”中。因此,“模型3”也可能反刍这些个人数据。

风险传播:这种数据渗透意味着,模型 regurgitate 个人数据的风险会随着模型的发布和复用而不断传播和扩散。

可追溯性困境:在一个模型被发现记忆了某人的个人数据后,关键问题是如何识别其谱系中所有可能同样记忆了这些数据的下游模型。缺乏有效的追溯工具使得权利行使变得异常困难。

图1:模型谱系中的数据渗透示例

3. CNIL的实验性项目与工具

为了探索解决方案,CNIL的AI服务部门与CNIL数字创新实验室(LINC)合作,主导了一项实验,并开发了一个演示工具。

3.1 项目目标

该实验旨在探索数据主体在开源AI模型中行使其权利(如反对、访问、删除)的具体场景。项目的首要目标是:从一个已知记忆了某人数据的模型出发,识别其谱系中所有可能同样记忆了这些数据的其他模型。该项目旨在为CNIL关于GDPR应如何应用于快速变化的开源AI生态系统的思考提供依据。

3.2 数据基础与知识图谱构建

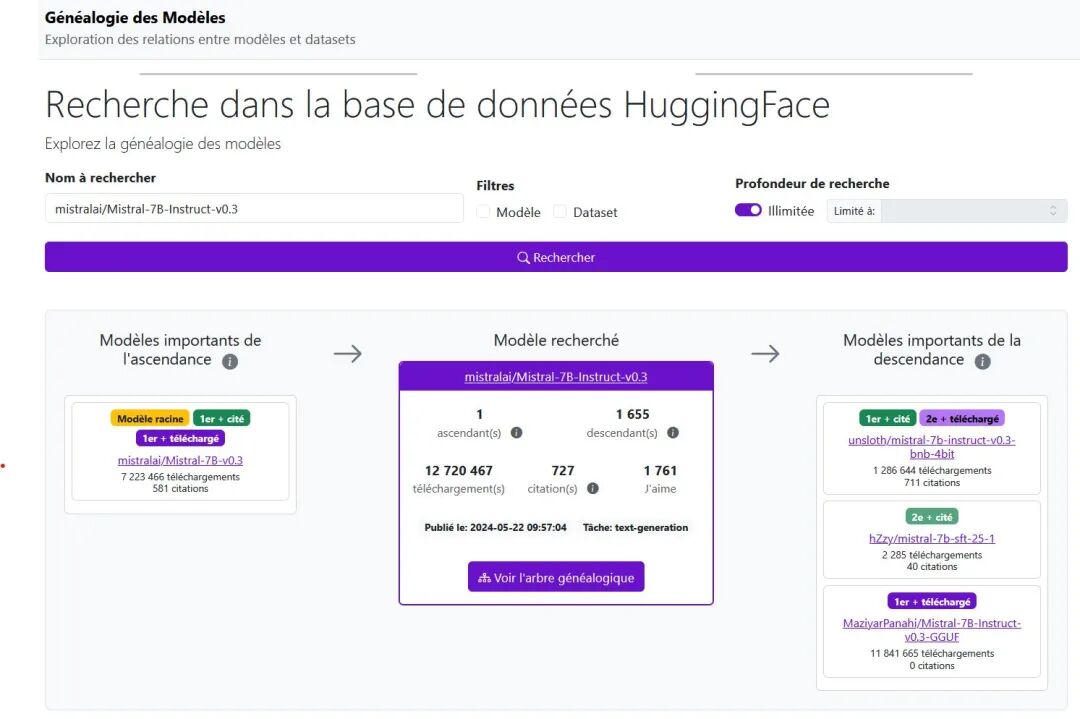

数据源:项目的起点是HuggingFace平台公开的数据库。该数据库每日更新,包含约200万个模型和50万个数据集的描述信息。这些信息大多由上传者自行申报。

关系链接:在HuggingFace上,一个模型可以指明其派生自哪个基础模型。例如,“mistralai/Mistral-7B-Instruct-v0.1”模型明确指出它是对“mistralai/Mistral-7B-v0.1”进行微调(finetuned)后的版本。同时,“Mistral-7B-Instruct-v0.1”本身也成为其他965个衍生模型的基础。

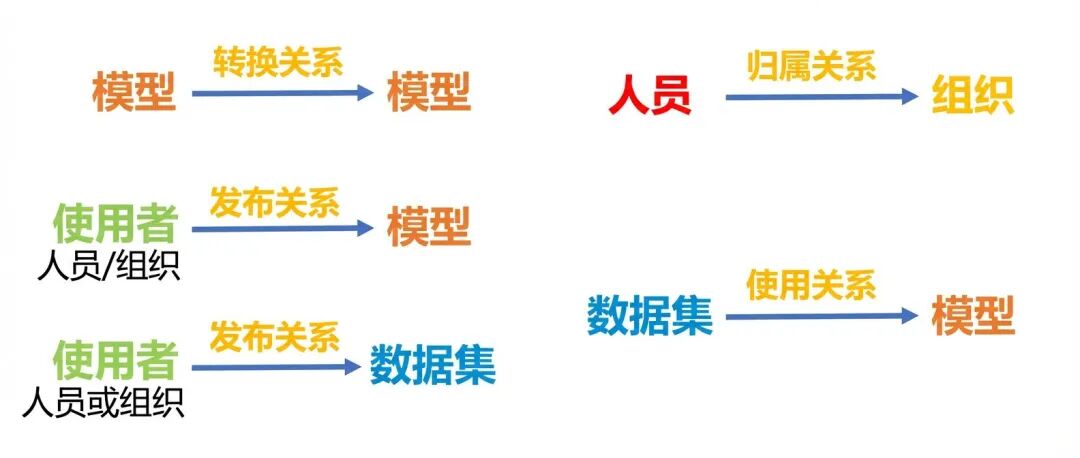

构建知识图谱:通过逐个梳理这些模型间的关系,可以构建一个覆盖整个平台的知识图谱。为此,项目团队定义了一套本体论(ontology),包括图谱的节点类型和关系类型。

图2:项目定义的知识图谱本体论

3.2.1. 知识图谱的定义与功能

来源明确指出,为了构建一个能够描述和搜索开源 AI 生态系统的工具,必须首先定义本体(Ontology),即规定图中顶点(顶点/Sommets)和边(链接/Liens)的类型。

结构化关联: 通过本体定义的规则,CNIL 能够将 HuggingFace 上的数百万个离散模型和数据集“逐个链接”(de proche en proche),从而生成一个结构化的知识图谱。

不可或缺的步骤: 来源强调,能够通过这种方式描述和搜索模型谱系,是理解一个模型是如何被构建出来的“必备步骤“。

3.2.2. 本体论的核心组成部分

根据项目定义的本体架构,知识图谱主要由以下要素构成:

实体顶点: 包括模型(Modèle)、数据集(Dataset)、人员(Personne)组织(Organisation)。

关系链接:

发布关系: 人员或组织“发布”了模型或数据集。

归属关系: 个人“属于”某个组织。

使用关系: 数据集被“用于”特定的模型。

转换关系: 模型之间通过特定的技术手段发生“转换”。

3.2.3. 对模型转换关系的精细化分类

在本体构建中,该项目特别注重对模型间动态演进关系的界定。来源提到了四种关键的转换类型,这些类型构成了谱系追踪的技术基础:

微调(Finetuned): 例如 Mistral-7B-Instruct-v0.1 是其原始版本的微调产物。

适配(Adapters)。

合并(Merges)。

量化(Quantizations)。

3.2.4. 解决“数据下渗”问题的技术前提

构建这一本体的根本目的在于应对“数据下渗”(Ruissellement)的风险。

风险识别: 只有通过知识图谱确立了模型间的“祖先”与“后代”关系,才能在发现某个模型记忆了个人数据后,迅速识别出哪些关联模型也可能存在相似的**数据复现(Régurgitation)风险,。

权利行使: 这一技术实现支持了实验性的“自动化查询”功能,允许用户顺着知识图谱的逻辑,向所有潜在的相关模型负责人行使 GDPR 权利,。

如果说 HuggingFace 上的海量模型是一堆散乱的、没有索引的书籍,那么“知识图谱构建(Ontology)”就是 CNIL 为这间图书馆编写的分类索引编码系统。它不仅定义了谁是作者(发布者)、哪些内容被引用(数据集),还理清了每一本书的修订版和翻译版(转换关系),从而让监管机构能像查阅家谱一样,精准锁定每一段信息的流转路径。

3.3 工具功能与用例

基于构建的知识图谱,CNIL开发了一个用户工具,用于探索和利用这些数据。

典型用例(Alice Dupont):

一个名为Alice Dupont的虚构用户向一个基于“模型A”的聊天机器人询问关于她自己的信息。

机器人回复了她的邮寄地址和出生日期。

Alice希望行使她的数据权利,并找出所有可能记忆了她数据的模型。

她使用CNIL的工具,搜索“模型A”,以查看其谱系,包括上游和下游模型。

工具界面与功能:工具提供了一个搜索界面,用户输入模型名称后,可以查看该模型的详细信息,以及其重要的上游和下游模型。用户还可以选择查看完整的谱系树。

图3:模型谱系可视化工具界面

探索性功能:

自动请求发送:设想了一个功能,允许用户(如Alice)自动向所有可疑模型发送一个预设请求,以观察它们的回复,从而筛选出确实反刍了其个人数据的模型。

自动联系作者:设想了另一个功能,即通过表单自动联系被识别为有问题的模型的作者,以要求访问、更正或删除数据。

实施挑战:这些功能目前仍是探索性和假设性的,因为HuggingFace平台并未强制要求模型作者提供公开联系方式。要使这些功能可用,平台需要进行改进,以更好地识别模型发布的负责人。

专家模式:该工具还提供一个“专家模式”,供研究人员使用。他们可以利用此模式分析特定模型的连通分量图,并将图谱以HTML格式导出进行深入研究。

4. 结论与意义

CNIL开发的模型谱系追溯工具是一个重要的演示项目,它直面了开源AI与数据保护交叉领域的严峻挑战。该项目清晰地揭示了在去中心化和动态变化的AI生态系统中,确保GDPR合规所面临的技术和法律障碍。

通过将模型间的关系可视化,该工具为数据主体、监管机构和研究人员提供了一种追踪个人数据潜在传播路径的方法。虽然其中一些高级功能(如自动联系作者)在当前仍是设想,但它们指明了未来平台责任和功能发展的方向。该实验为CNIL未来的政策制定和监管指导奠定了坚实的基础,强调了在促进技术创新的同时,建立有效的追溯和问责机制的紧迫性。

声明:本文来自那一片数据星辰,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。