随着大模型深度接入互联网与各类应用,全新的安全威胁正在逼近。近日,OpenAI正式宣布为ChatGPT引入锁定模式与高风险标签两项安全机制。为了应对日益猖獗的提示词注入攻击,OpenAI通过限制模型与外部系统的交互,为企业高管、安全团队等高危用户提供确定性的数据防护,进一步提升大模型的安全性。

大模型时代的新隐患:防不胜防的提示词注入

在过去,网络攻击往往针对系统漏洞;而在大模型时代,提示词注入成为了最棘手的新型威胁之一。攻击者通过在网页、文档或第三方应用中暗藏恶意指令,诱导大模型偏离既定任务,甚至窃取用户的敏感对话和隐私数据。

随着大模型开始接管越来越复杂的自动化任务——尤其是那些涉及网络和联网应用的任务,安全门槛正在急剧升高。OpenAI此次的更新,正是建立在其现有的沙盒机制、防止基于URL的数据防外泄保护以及企业级访问控制等基础之上的一把“加固锁”。

锁定模式:为高危用户打造的安全功能

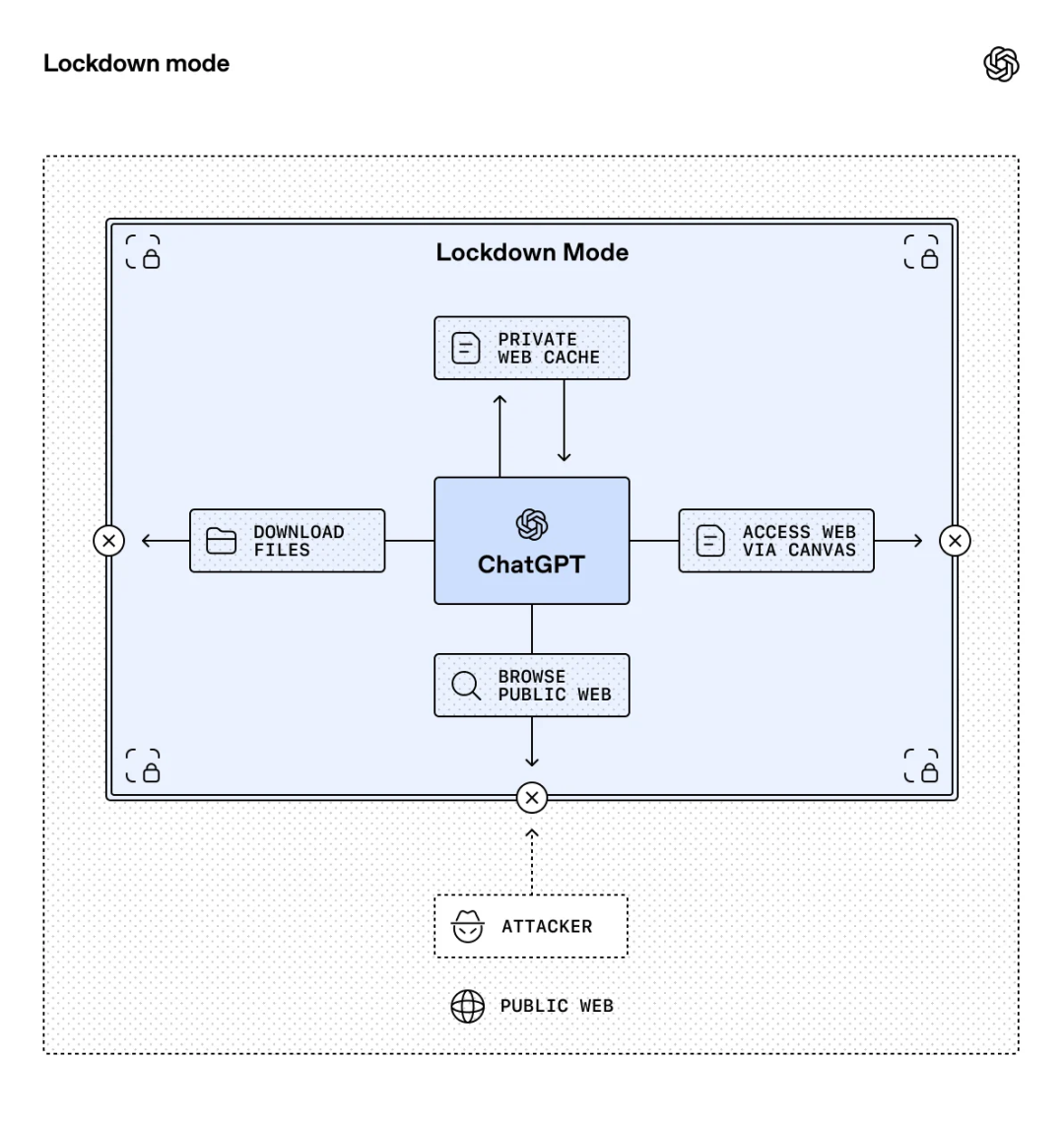

为了保护最容易受到网络攻击的人群(如知名企业的高管或核心安全团队),OpenAI推出了锁定模式。这是一种高级的可选安全设置,它通过确定性地禁用ChatGPT中可能被攻击者利用的特定工具和功能,从根本上切断了数据外泄的途径。

在锁定模式下,ChatGPT的网络浏览功能仅限于访问缓存内容,禁止发出任何实时的网络请求。这种物理级别的阻断,确保了敏感数据无法通过网络浏览被暗中传输给攻击者。如果某些功能无法提供绝对的数据安全保证,系统将直接将其完全禁用。

目前,该模式已面向ChatGPT企业版、教育版、医疗版及教师版开放。工作区管理员不仅可以为特定角色开启该模式,还能保留细粒度的控制权,精确决定哪些应用程序甚至应用内的哪些操作可以在锁定模式下使用。OpenAI也透露,计划在未来几个月内将该功能向普通消费者开放。

苹果在iOS 16中首次引入了“锁定模式”,而OpenAI如今在ChatGPT中也启用了这一概念。从产品哲学上来看,两者的核心逻辑高度一致:通过阉割危险功能,换取安全性。

共同的目标人群:它们都不是为普通大众高频使用的日常功能,而是专为极少数可能遭受定向高级网络攻击的“高危人群”设计。

相同的防御理念(减少攻击面):苹果的锁定模式会禁用信息中的复杂附件预览、阻断未知的FaceTime呼叫、甚至关闭Safari中容易被利用的复杂Web技术(如JIT JavaScript编译)。这与ChatGPT锁定模式限制网络浏览为缓存内容、切断实时网络请求的做法如出一辙。

“高风险”标签:把知情权与控制权交还用户

除了针对高危用户的强制性锁定,OpenAI还引入了“高风险”标签机制。大模型在连接外部应用和网络时虽然强大,但也伴随着尚未被行业安全措施完全消除的新风险。

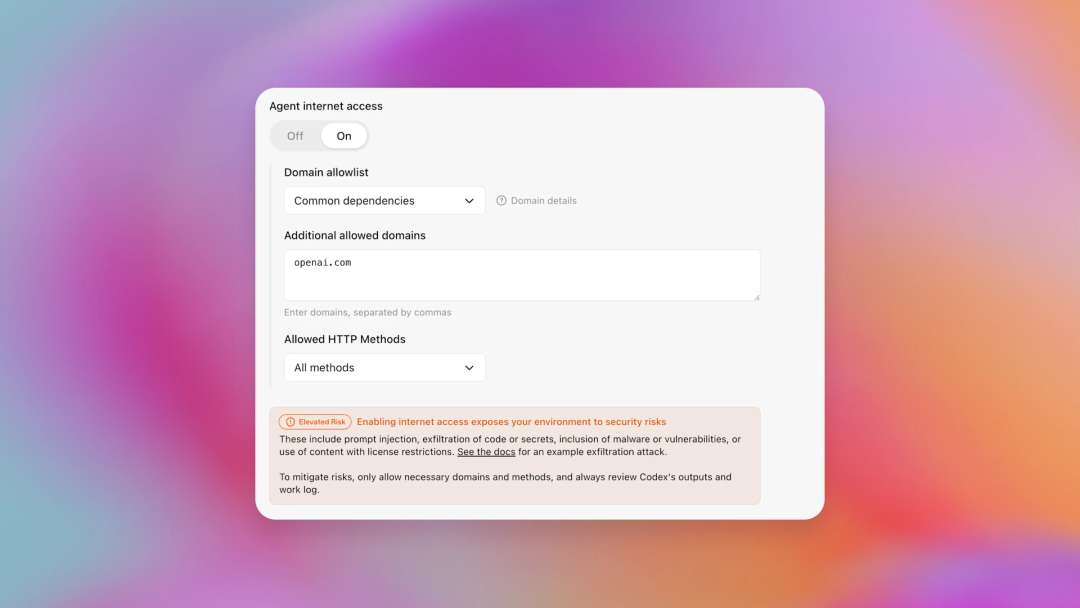

为了让用户在处理私人数据时能做出明智的选择,OpenAI决定在ChatGPT、ChatGPT Atlas以及代码助手Codex中,对具有潜在网络风险的特定功能统一打上“高风险”标签。

不仅是一次产品界面的调整,更是对用户知情权的保障。例如在Codex中,当开发者准备授予其网络访问权限以查找文档时,界面不仅会亮起“高风险”标签,还会解释该功能会带来什么改变、可能引入哪些风险,以及在何种场景下使用才是合适的。OpenAI表示,未来随着安全技术的进步,如果某项功能的风险被充分降低,将会移除该标签。

点评

小编认为,OpenAI此次的更新标志着他们的安全理念正在向“主动隔离”转变。提示词注入目前难做到100%免疫,因此通过“断网”或“限制交互”这种看似简单粗暴的硬核手段,反而是当下保护数据的最有效解法。

以上,既然看到这里了,如果觉得不错,随手点个赞、在看、转发三连吧,如果想第一时间收到推送,也可以给我个星标⭐~谢谢你看我的文章,我们,下次再见。

参考资料: OpenAI官方博客 - Introducing Lockdown Mode and Elevated Risk labels in ChatGPT https://openai.com/index/introducing-lockdown-mode-and-elevated-risk-labels-in-chatgpt/

声明:本文来自玄月调查小组,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。