美国福布斯新闻网2023年5月22日报道称,一张显示五角大楼附近发生爆炸的图片22日在推特上疯传。该图片在推特上流传的瞬间,美国股市应声下跌。目前,原始帖子已被删除,该图片的来源也尚未确定。

该事件中,有几点值得反思:其一,充分利用媒体网民的看客心理推动虚假信息的传播。即使这个AI假图片制作“拙劣”,仍遭到了“疯传”,一方面是抓住了五角大楼这个重要icon,另一方面充分利用了社交媒体场域中网民“认知盲区”的“吃瓜心理”。其二,虽然事件发酵时间不长,却在经济领域造成了极大的现实冲击和影响。假新闻虽然可以被快速识破,但真实的杀伤效果往往不可挽回。其三,此次虚假信息攻击更像一种“试探性”的尝试,其手法并称不上多高明,但成功地调动了美国军政、媒体相关力量与反应机制。

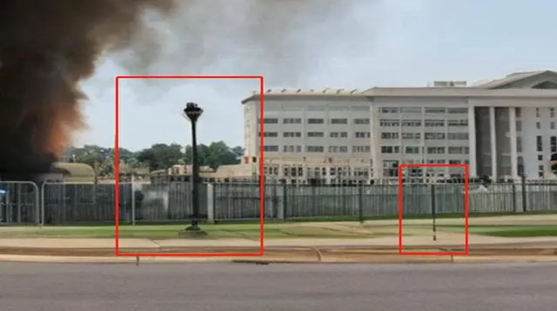

图:推特上疯传的“五角大楼附近发生爆炸”图片,来源:美国福布斯新闻网

“五角大楼”附近发生爆炸”图片疯传,凸显人工智能虚假信息危害

编译:网安观察员 温暖街灯

全文摘要与关键词

1. “五角大楼爆炸”图事件概况:AI生成虚假爆炸图→大量推特认证账户转发(俄官媒+彭博社假帐户)→美股险崩盘→美官方机构迅速证实

2. “深度伪造”现代认知战利器:危害影响极大;俄乌冲突频用;美西方国家将其用于认知战(美特种作战部队隐秘行动)

3. “深度伪造”应该如何应对和识别?DARPA两个项目(图像鉴定+媒体和语义取证);美国校企合作(Deepfakes鉴别挑战赛,“递归神经网络”算法);网民们的鉴别方法(信息来源是否单一,信息发布主题核实,使用开源情报工具,分析图像环境和人物动作是否有技术痕迹)

一家百万粉丝的俄罗斯官方媒体参与转发,冒充彭博社的虚假推特帐户同时遭暴露……

01

“五角大楼爆炸”图重挫美国股市

被疯传的AI假图。据美国有线电视新闻网(CNN)报道,这张人工智能生成的虚假图片被大量带有推特认证标志的账户疯传,其中包括一家拥有数百万粉丝的俄罗斯官方媒体和一个后经确认是冒充彭博社的虚假推特帐户。

美股险些崩盘。虽然推特删除了发布该虚假图片的帖子,并暂停了冒充彭博社的推特帐户。但这一系列措施并未及时消除这张虚假图片造成的影响。该图片开始在推特上流传的瞬间,美国股市出现了明显下跌。道琼斯工业平均指数在上午10点06分到10点10分之间下跌了约80点,而标普500指数上午10点06分时上涨0.02%,到上午10点09分却下跌0.15%。

美国官方多机构出面证实。

美国国防部发言人事后向福布斯记者证实,该图片传递的是“虚假信息”。

负责五角大楼所在地区安全的阿灵顿消防和急救部门通过其社交媒体账号表示,当天并未发生爆炸事故。

五角大楼保卫局(PFPA)推特账号随即也转发了阿灵顿消防和急救部门的该条推文。

来自独立新闻调查组织“贝灵猫(Bellingcat)”的尼克·沃特斯以及其他媒体记者,迅速判断这是一张人工智能(AI)生成的图片,并指出了该图片中存在的一些问题。

02

“深度伪造”技术现代认知战的利器

深度伪造技术的危害。

近来基于人工智能技术的伪造图像已经多次引发轰动效应,例如人工智能工具Midjourney生成的教皇方济各身穿时尚品牌羽绒服的图片,以及不久之前美国前任总统特朗普反抗当局逮捕的虚假图片等等。本次虚假的五角大楼爆炸图在网上疯传,凸显了深度伪造技术带来的危险。

深度伪造是在人工智能领域由“深度学习”(deep learning)和“伪造”(fake)合成的新名词。从技术来看,深度伪造利用面部映射、人工智能和深度学习模仿语音和形象,创造出另类“现实”,即制作合成逼真的音视频内容,展示人们从未做过或从未发生过的事情。

深度伪造已经成为现代认知战的重要利器。

现代认知战不同于以往认知战的一个显著特征在于,谋略的成分逐渐减少、作用逐步降低,而技术的应用更加频繁、作用更加凸显。深度伪造已经成为现代认知战的重要利器。

俄乌冲突可以说是历史上首次深入利用深度伪造技术的战争。2022年3月,一条乌克兰总统泽连斯基的伪造视频在推特上广泛传播。在这条大约一分钟时长的视频中,“泽连斯基”要求士兵们放下武器,放弃对俄战斗。乌克兰国防部随后在其推特官方账号进行辟谣,脸书和推特也宣布删除“泽连斯基宣布向俄罗斯投降”的造假视频。推特上还出现过一段“俄罗斯总统普京宣布投降”的视频,但事实上这也是一段经过剪辑处理后释放假消息的视频。此类深度伪造视频具有高度的视觉和听觉欺骗效果,甚至可以完全达到以假乱真的效果,让信息变得真假难辨。

美国等西方国家也将深度伪造技术应用于认知战。

其具体手法包括深度伪造视频、深度伪造声音、深度伪造图像等等。就特定的主题和目的大量生成虚假信息,其产生的破坏力可深入政治、社会等各个领域。尽管美国政府一直警告深度伪造技术可能会“破坏民主社会的稳定并威胁人类文明”,但据美国网站“The Intercept”披露,美国特种作战中央指挥部(SOCOM)也在使用“深度伪造”技术。根据该网站掌握的联邦合同文件内容,负责美国一些最为隐秘的军事行动的特种作战中央指控部的领导层,正准备使用倍受争议的深度伪造视频在网络上开展虚假宣传运动。美国特种作战中央指挥部的领导层在这份采购文件中概述了针对此类新型宣传活动的要求,列出了该指挥部希望尽快获取的能力,并要求那些认为自身可以打造这些能力的实体参与投标。

03

如何识别深度伪造技术产品

美国DARPA研究项目。美国国防高级研究计划局(DARPA)正在研发Forensic图像鉴定技术,涉及媒体取证(Media Forensics,MediFor)和语义取证(Semantic Forensics,SemaFor)两个项目。媒体取证项目将用于开发算法,以自动评估图片和视频的逻辑一致性,从而为分析人员提供伪造内容如何生成等信息。语义取证项目则寻求开发自动探测、界定和归类各种深度伪造产品的算法。

美国科技企业与高校联合研究。此外,Facebook公司和微软公司也联合来自麻省理工、牛津等大学的研究者,通过举办“Deepfakes鉴别挑战赛”等活动,探索如何通过数据集和基准测试来检测深度伪造换脸视频。加州大学河滨分校的学者也提出了检测深度伪造图像的新算法。该算法的一个组成部分是各种“递归神经网络”,可以将有问题的图像分割成“小块”,然后逐像素地观察和分析这些“小块”。

对于个人来说,当在网上看到号称是“突发新闻事件”的图片时,尽管多数人不掌握可以鉴定虚假视频和照片的专业工具,但也可以通过以下五种方法来鉴别:

一是新闻不会发生在真空之中。在发生类似大爆炸等突发事件时,不会只有单一的新闻,而是会看到来自不同渠道和不同角度的大量实地报道;

二是明确是谁上传了内容。可以查看发布新闻的帐户的相关信息,确认其位置是否与事件发生地点重合,以及该账户是否存在其他疑点;

三是使用开源情报工具。可以通过谷歌图片和TinEye等反向图像搜索工具,核实新闻图片首次被使用的时间和地点。还可以使用其他开源工具,例如查看公共交通摄像头实时画面,以验证该事件是否正在发生;

四是分析图像环境。在图片中寻找线索,例如附近的地标、路标甚至天气状况,以确定事件可能发生的地点或者时间。

五是分析人物动作。在分析人像时,尤其要注意人物的眼睛、手部和身体姿势。人工智能生成的深度伪造视频往往存在眨眼问题,因为大多数训练数据集都不包含闭眼的面孔。同理,没有正确抓握物体的手,或者看起来不自然的扭曲的四肢,也有助于辨别虚假内容。

小tips:观察图片是否存在内容多余或变形。当前许多生成式人工智能工具,例如Midjourney、Dall-e2、Stable Diffusion等等,都可以毫不费力地生成高度仿真的图像。这些工具通过学习大量真实图像数据来完成训练,在缺少训练数据时也会凭借自身的算法来填补空白。这就可能会导致图像中的人物出现多余的肢体部分,或者导致人物身体部位与周围环境同时发生变形。这种情况就为通过技术手段识别造假图像提供了可能。

参考资料:

https://www.theguardian.com/technology/2023/may/22/pentagon-ai-generated-image-explosion

文章内容编译自网络,本文观点不代表本公众号立场。欢迎交流讨论,批评指正。

声明:本文来自认知认知,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。