每年,RSA Conference 都会邀请网络安全领域最大胆的创新者参加 RSAC Innovation Sandbox 竞赛,该竞赛将焦点放在具有潜在改变游戏规则想法的初创公司上。由具有不同观点的行业资深人士组成的评审团面临着审查出色初创公司提交的材料的挑战。然后选出 10 名决赛入围者,在 RSA 会议上亲自提出他们的想法。决赛入围者有三分钟的时间在台上向同一个评委小组分享他们的突破性产品和解决方案。多年来,RSAC 创新沙盒已为 18 家公司加冕。自竞赛开始以来,前 10 名决赛入围者总共完成了 80 多项收购和 135 亿美元的投资。

2024 年 RSAC创新沙盒获胜者 Reality Defender(现实捍卫者),专注于开发用于检测和防御针对各种媒体(如音频、视频、图片和文本)的 AI 生成内容和深度伪造(deepfake)技术,他们的价值定位与他们公司名称一样,想在人工智能被大量滥用生成虚假信息的大背景下去守护现实。该公司利用多模型并行检测技术,能够识别和分析 AI 生成的威胁。Reality Defender 最初是一家非营利组织。然而,随着 Deepfake 问题的严重性日益显现,以及 Deepfake 检测技术的商业需求激增,该团队开始寻求外部融资。

AI元年人工智能生成式威胁激增

Reality Defender 的竞争对手 DeepMedia 报告称,2023年在线发布的视频 Deepfake 数量是 2022 年同期的三倍,语音 Deepfake 数量是 2022 年同期的八倍。这种激增可归因于生成式人工智能工具的商品化,这使得恶意行为者创建深度伪造内容变得越来越容易且具有成本效益。以前,克隆声音或生成深度伪造图像和视频需要大量的财政资源和专业知识。然而,ElevenLabs 等平台和 Stable Diffusion 等开源模型使个人能够以最低的成本发起深度造假活动。这种便捷的访问方式引发了一些问题,例如最近 4chan 上种族主义图像泛滥、模仿名人声音以及国家行为者生成的逼真人工智能头像等。

深度伪造与诈骗活动:

深度伪造技术(deepfake)可以创建极其逼真的音频和视频,使得个人的面孔和声音可以被操纵以说出他们从未说过的话或进行从未进行过的活动。这种技术的滥用可能导致多种形式的诈骗,如冒充他人进行金融诈骗、社交工程攻击、恶意软件传播等。例如,有诈骗者利用深度伪造创建了一位高管的视频,骗取员工转账资金。年初,香港警方披露了一起多人 “AI换脸”诈骗案,多人视频会议只有自己是真人,涉案金额高达2亿港元。虚假信息生成与舆论操纵:

生成式AI可以用于制造假新闻和虚假信息,这些内容可能看起来非常真实,从而误导公众、操纵公共舆论或影响政治活动。这种技术能够大规模生成符合特定叙述的虚假内容,加剧了信息环境的混乱和不信任感。认知战与心理操纵:

在更广泛的心理战略中,生成式AI的滥用可能用于制造针对特定群体或个人的心理压力。例如,通过生成某个社区或个人的负面或虚假信息,对其进行持续的心理打击,影响其心理健康和行为决策。这种技术在军事和地缘政治冲突中尤为关键,可能被用作非常规战争工具来破坏敌方的士气和团结。

尽管一些生成式人工智能平台实施了过滤器和限制来打击滥用行为,但挑战仍然类似于猫捉老鼠的游戏。

创始人 Ben Colman

Reality Defender的创始人兼CEO,Ben Colman,拥有广泛的经验在网络安全和数据科学领域。他在纽约大学斯特恩商学院(NYU Stern)获得了工商管理硕士学位,并持有克莱蒙特·麦肯纳学院(Claremont McKenna College)的学士学位。在创立 Reality Defender 之前,Colman 在高盛(Goldman Sachs)领导了网络安全的商业化工作,并在谷歌(Google)工作过。他在商业领导和创新技术开发方面具有丰富的经验,尤其擅长从事与深度伪造检测和人工智能相关的高技术项目。他在过去15年里成功扩展了多家公司,这些公司均位于网络安全和数据科学的交叉点。这些经验不仅提升了他的业务能力,也加深了他对于当前和未来数字威胁的理解和应对策略。

Reality Defender 核心技术

常见的人工智能生成威胁包括语音克隆、身份盗用、AI换脸等,Reality Defender 的核心技术基于一种革命性的多模型方法,专门设计来检测和防御深度伪造(deepfake)和其他 AI 生成的威胁。这种技术能够同时在多个维度(包括音频、视频、图片和文本)进行AI生成内容的检测,其结果是概率性的,这意味着它们不依赖于水印或先验认证来验证内容的真实性。

1. 图像检测

在像素级别分析图片,使用多模型并行处理每张图片,以确定其真实性。此外,通过可解释的 AI 提供的分析层,增加了对欺诈行为的洞察力和行动指导。

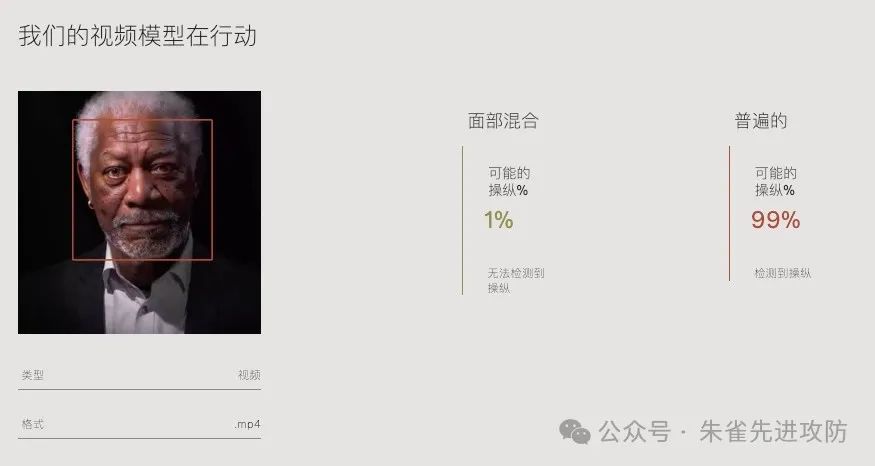

2. 视频检测

通过分析每个场景中的每张脸部图像,提供关键信息,帮助团队评估每个文件的真实性。

3. 音频检测

语音克隆就像按下按钮一样简单。人工智能生成的语音深度伪造的语音欺诈事件正在以前所未有的速度增长,风险、安全和身份验证团队也出现了新的担忧。实时声音检测帮助呼叫中心、验证团队及信任与安全小组识别和抓捕欺诈者。

4. 文本检测

诈骗团伙将大型语言模型 (LLMs) 武器化以针对普通公民和企业。Reality Defender 的文本检测平台可在造成任何伤害之前识别出真实内容和合成内容。

此外,Reality Defender 还提供了一种直观的网络应用程序和平台无关的 API,使组织能够上传大量内容并根据需要扩展其检测能力。这种多管齐下的方法查看每个文件的每个可能角度,具有行业领先的精确度。

针对特定行业的解决方案

Reality Defender 的解决方案针对金融、媒体、政府和技术等关键行业,提供了专门构建的工具,以帮助这些领域抵御由 AI 和深度伪造技术带来的安全威胁。

1. 金融行业

通过实时深度伪造检测技术增强反欺诈措施,帮助金融机构预防和对抗高级 AI 欺诈。这些解决方案包括声音克隆检测、欺诈性文件识别及加强身份验证和客户了解你的客户(KYC)流程,以防范展示和注入攻击。Reality Defender 的技术能够实时检测和识别AI生成的声音和文本,保护金融机构免受社交工程攻击和其他形式的高级欺诈活动的侵害。

2. 媒体行业

帮助新闻机构和媒体公司对抗由人工智能生成的内容和深度伪造所带来的挑战。Reality Defender 的技术设计能够无缝集成到现有的媒体工作流中,方便媒体机构采用而不会干扰当前操作。通过使用多模型方法,该平台提供了强大的检测能力,有效帮助媒体机构识别和对抗复杂的 AI 威胁,这对于在关键活动时间内保护信息的完整性和维护公众对媒体的信任尤为重要。

3. 政府行业

帮助政府机构识别和防御虚假信息、声音冒充和欺诈性通信,尤其是在关键的政治和公共安全领域中。Reality Defender 的平台通过实时检测深度伪造声音和验证政治宣传资料的真实性,增强了政府应对AI威胁的能力。平台无缝集成允许政府轻松地将这些工具融入现有的安全工作流程中,确保了公共信任和社会稳定。

总结

随着人工智能技术的迅速发展,AI生成式威胁,如深度伪造、虚假信息生成等,正在成为网络安全领域面临的一大挑战。这些技术的滥用可能导致个人隐私泄露、企业安全风险加剧以及公众信任的下降。网络安全行业需要不断创新,开发更加高效和智能的防御工具来识别和阻止这些威胁。同时,随着AI技术的普及,这一领域也呈现出巨大的发展机遇,尤其是在AI驱动的安全解决方案和实时威胁检测技术方面。因此,企业和政府机构必须投资于最新的AI安全技术和专业人才培养,以增强他们的防御能力,并确保能够应对不断演变的网络安全挑战。希望国内不久也能诞生此领域的黑马。

声明:本文来自朱雀先进攻防,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。