前情回顾·AI安全威胁态势

安全内参6月18日消息,云安全公司Wiz最新调查显示,尽管近九成组织已在云端使用AI服务,但部署专门AI安全控制措施的却不到七分之一。报告指出,随着影子AI激增以及混合云架构日益复杂,当前安全团队在技能和工具方面存在明显短板,可能影响企业AI项目的顺利推进。

Wiz在上周发布了《AI安全准备度:来自100位云架构师、工程师和安全主管的见解》。该报告基于Gatepoint Research于2024年末开展的调查结果,调研对象包括100位云计算专业人士,涵盖架构师、工程师、安全主管及高管,涉及96家来自多个行业的不同组织。

AI应用推进迅速,安全专业能力难以跟上

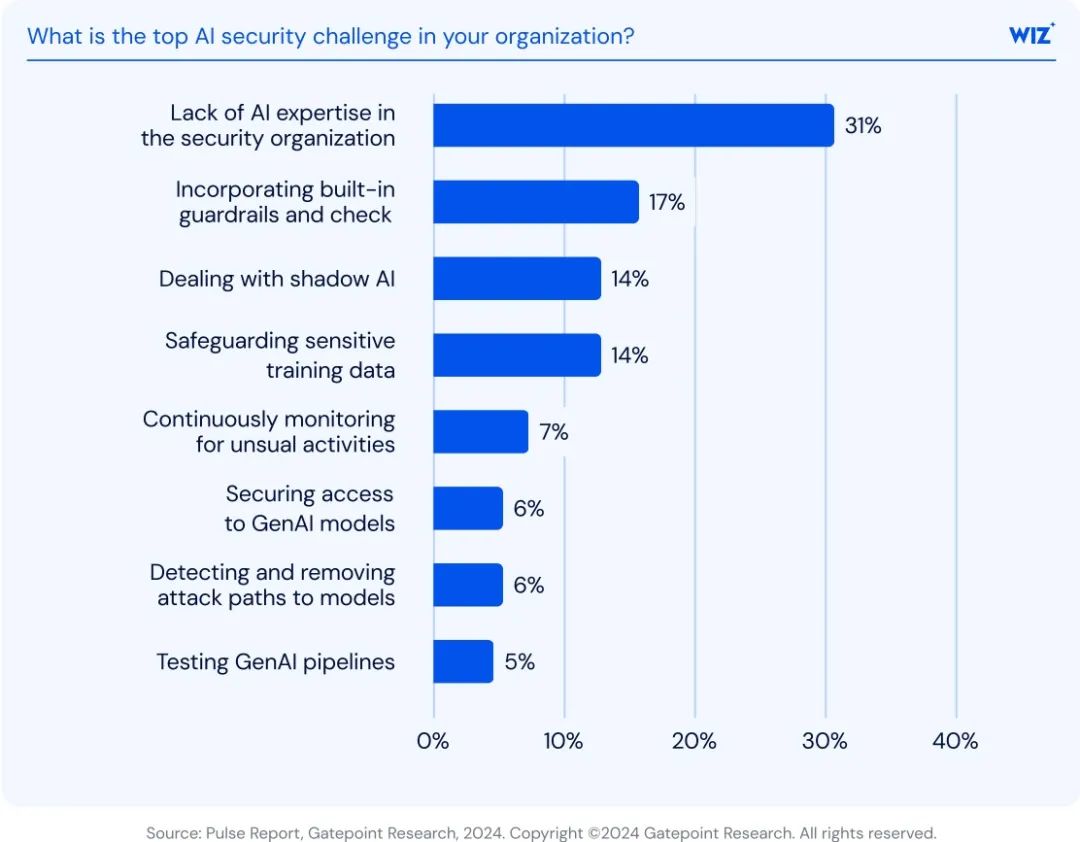

报告数据显示,87%的组织已在使用OpenAI、Amazon Bedrock等AI服务。然而,有31%的受访者将“缺乏AI安全专业知识”列为他们面临的最大挑战,这一问题也是被提及次数最多的。

图:您所在组织面临的首要AI安全挑战是什么?

报告指出:“安全团队正被要求保护一些他们并不完全了解的系统,这一技能缺口正在不断扩大企业的风险暴露面。”在弥补这一差距之前,工具和自动化能力被认为至关重要。

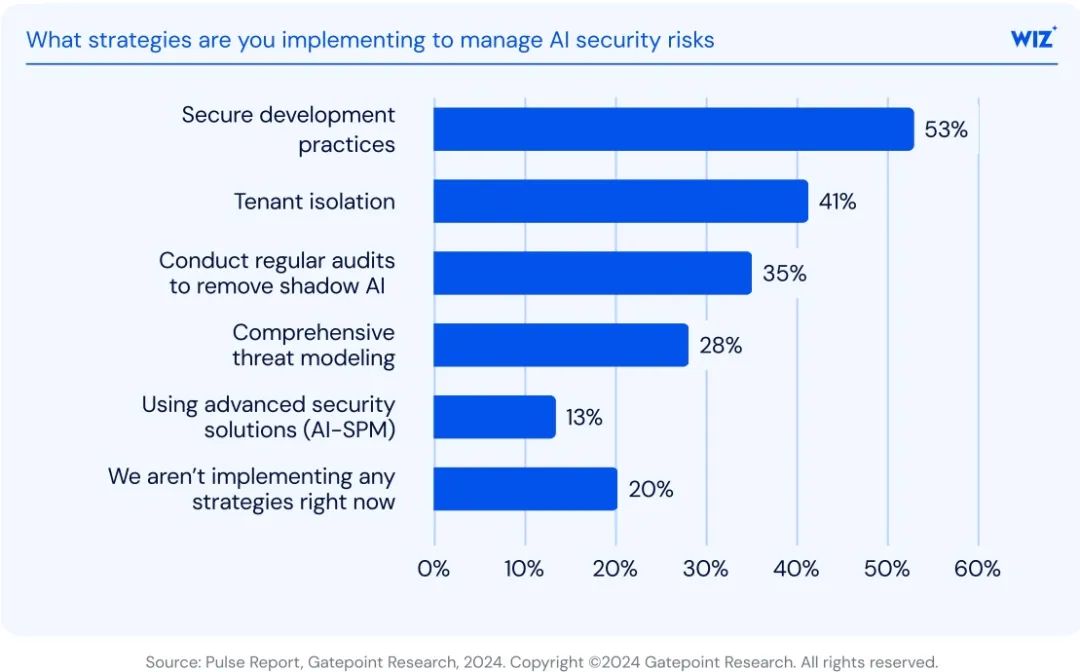

传统安全手段仍占主导地位

目前,仅有13%的组织使用AI专属安全态势管理(AI-SPM)工具。相比之下,大多数组织依然依赖适用于传统环境的控制手段:

安全开发实践:53%

租户隔离:41%

通过审计识别影子AI:35%

图:您正在采用哪些策略来管理AI安全风险?

尽管这些措施依旧具有重要意义,报告强调,它们并未针对AI系统的独特风险进行设计,例如模型横向访问、训练数据中毒以及未受监控的生成式API使用。

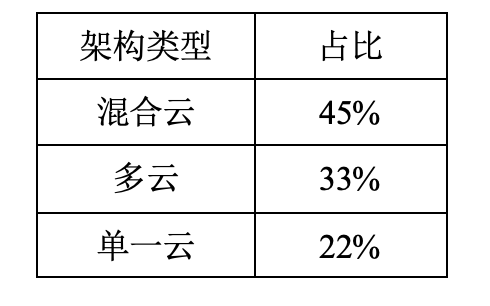

云架构日益复杂,风险上升,可视性减弱

混合云与多云部署已成为常态。调查显示,45%的组织运行在混合云架构下,33%采用多云架构。但仍有70%的受访组织主要依赖CDM端点检测与响应(EDR)平台,这类工具本是为集中式架构设计。

以下表格总结了受访组织的云架构分布情况:

与此同时,有25%的受访者坦言,他们并不清楚当前环境中运行了哪些AI服务。

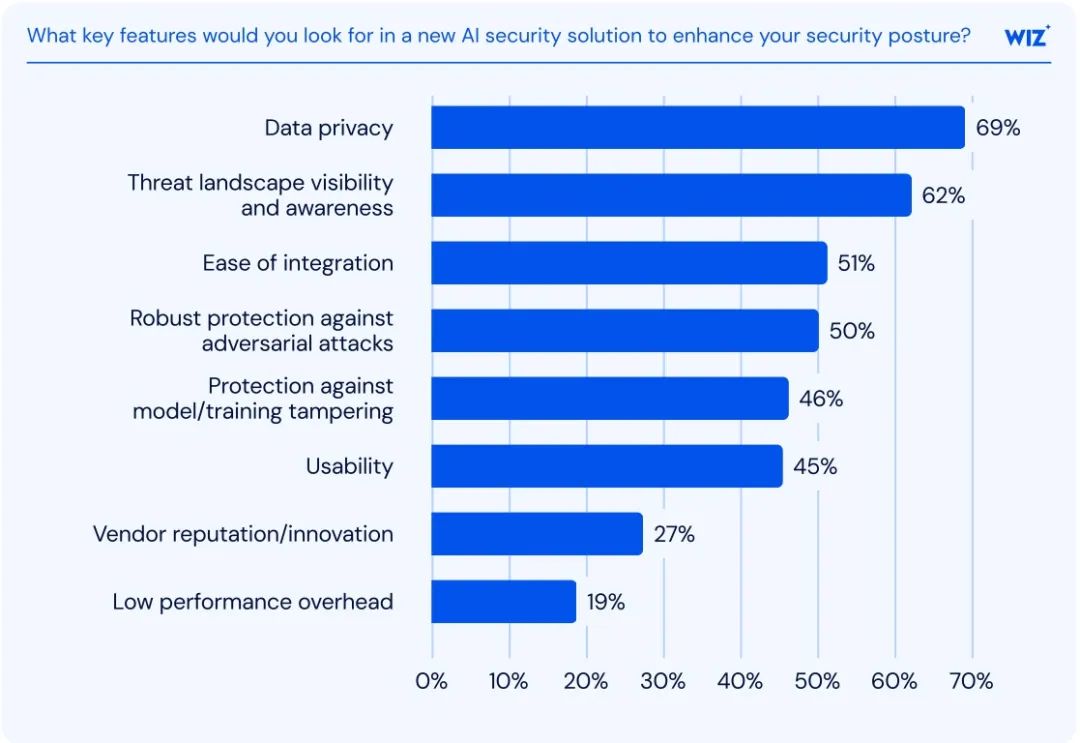

AI安全需求已超越技术范畴

调查显示,组织对AI安全工具的核心诉求,反映出更广泛的运维与工作流程需求:

69%的受访者将数据隐私视为首要需求

62%关注威胁的可视性

51%要求工具易于集成

图:您所在环境中目前运行的AI服务和技术有哪些?

报告指出,难以与DevOps工作流集成,是AI安全工具推广面临的主要障碍。同时,去中心化、实验性质的AI开发模式也制造出传统安全体系难以覆盖的盲区。

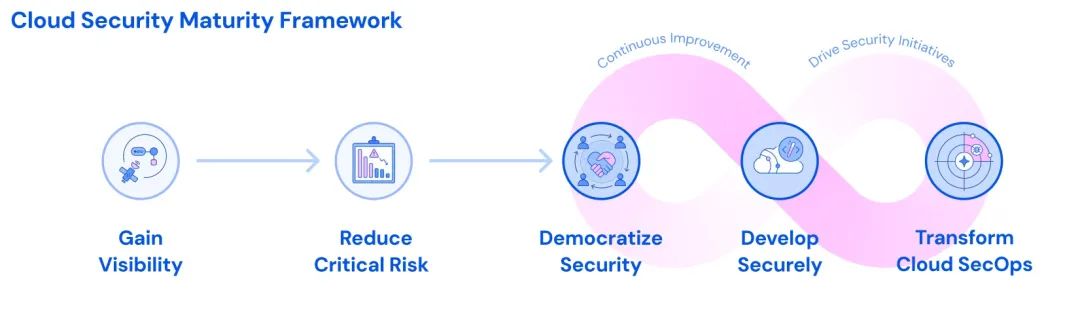

AI安全成熟度模型

Wiz将AI安全准备度纳入其更广泛的云安全成熟度框架,定义了对应于五个云安全发展阶段的四个AI安全成熟阶段:

阶段 | 成熟度级别 | 描述 |

1 | 实验性AI | 高风险使用AI,缺乏可见性,存在影子部署 |

2 | 初步治理 | 已建立基本控制措施,但尚未有效管理AI特有风险 |

3 | AI集成安全 | 控制措施实现集成,已使用AI-SPM工具,治理水平明显提升 |

4 | 主动AI安全运营 | 跨环境实现自动化,实时响应AI风险 |

图:云安全成熟度框架

报告指出,目前大多数组织仍停留在第1或第2阶段。

弥合差距的关键建议

为推动转型,报告向IT与安全团队提出了以下关键行动建议:

借助工具持续发现AI模型及影子服务

将安全“左移”,从软件开发生命周期早期就介入

确保安全策略能够在多云与混合环境中随工作负载迁移

为安全团队提供专门的AI安全培训

报告总结指出:“安全不能只是被动响应,必须持续推进,积极应对。”

参考资料:https://virtualizationreview.com/articles/2025/06/16/ai-booms-but-cloud-security-lags-just-13-use-ai-specific-protections-says-wiz.aspx

声明:本文来自安全内参,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。