一项最新研究显示,人工智能领域正面临严峻的数据安全挑战。网络安全公司 Wiz 发布的调查报告指出,《福布斯》AI 50强榜单中65%的头部企业都存在密钥泄露问题。

研究人员对50家顶尖私营AI公司进行深入调查,发现这些总估值超4000亿美元的企业均在GitHub平台上泄露过经过验证的敏感信息,包括API密钥、访问令牌等重要凭证。

研究表明,AI技术的快速创新已经超越了基础网络安全防护的推进速度。

值得关注的是,泄露风险与企业规模并不直接相关。

调查发现,一家仅14名员工、未设公开代码库的公司仍然发生密钥泄露,而另一家拥有60个公开代码库的企业却凭借完善的安全措施实现了零泄露。

深入挖掘

为全面评估风险,Wiz研究人员采用了创新的“深度、边界与覆盖”检测框架,将扫描范围从传统的GitHub搜索扩展到提交历史、删除分支、代码片段乃至贡献者的个人代码库。

这种方法成功发现了标准扫描工具经常遗漏的隐藏密钥。

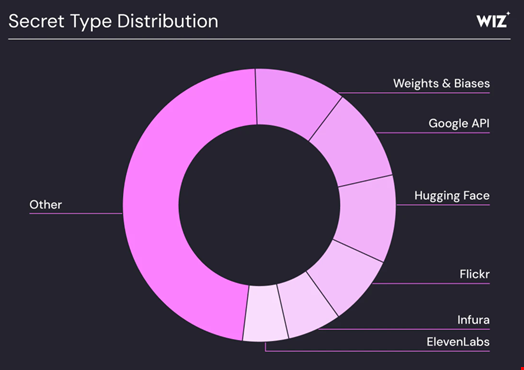

在最常泄露的凭证中,来自 Weights And Biases、Eleven Labs 和Hugging Face 等平台的 API 密钥位列前茅。

其中部分密钥一旦被恶意利用,将导致攻击者获取私有训练数据或企业机密信息——这些正是 AI研发的核心资产。

图源:Wiz

披露挑战

尽管Lang Chain、Eleven Labs等公司在发现问题后迅速采取了修复措施,但整体漏洞披露机制仍不完善。

近半数的安全通报未能获得回应或未能送达目标企业,许多机构甚至缺乏接收和处理漏洞报告的正式流程,暴露出企业安全防护体系的重大缺陷。

具体案例显示,Lang Chain 的 API 密钥在 Python 和 Jupyter 文件中被发现,而 Eleven Labs 的密钥则暴露在纯文本配置文件中。

更严重的是,一家未具名的AI 50强企业在已删除的分支中存有Hugging Face 令牌,导致约1000个私有模型面临泄露风险。

强化防御

为应对这些威胁,Wiz研究人员建议AI初创企业采取三项关键措施:对所有公开代码库实施强制性的密钥扫描、为外部研究人员建立明确的漏洞披露渠道,以及针对企业特有的密钥类型开发专属扫描工具。

报告最后强调,随着AI研发进程的不断加速,安全防护必须同步跟进。

“速度不能以牺牲安全为代价,”Wiz公司表示,“对于正在构建AI未来的团队而言,技术创新与安全保障必须齐头并进。”

转载请注明出处@安全威胁纵横,封面来源于网络;

消息来源:https://www.infosecurity-magazine.com/news/leading-ai-companies-secret-leaks/

声明:本文来自安全威胁纵横,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。