3月19日,欧洲议会通过名为《人工智能立法的数字综合法案》(Digital Omnibus on AI Regulation)的立法提案,对欧盟《人工智能法案》(EU AI Act)提出重大修订意见。该提案报告于3月18日已在欧盟委员会会议上正式获得通过,投票结果为赞成101票、反对9票、弃权8票。

图源互联网侵删

作为全球首部针对人工智能的综合性立法,《人工智能法案》发布一年半以来,除了在监管条款方面逐步明确,在落实过程中也面临变数重重。其发展历程,不仅是企业出海开展人工智能业务需重点关注的监管指向,也对我国人工智能监管设计具备借鉴意义。

回顾《人工智能法案》发布及施行的关键节点:

2024年6月13日,《人工智能法案》通过;

2024年7月12日,《人工智能法案》在欧盟官方公报上发布;

2024年8月1日,《人工智能法案》正式生效;

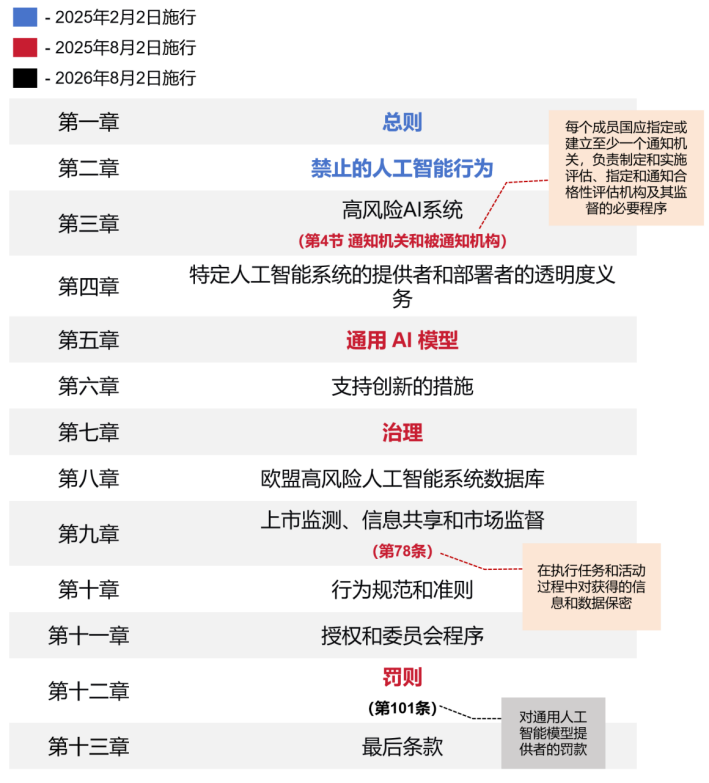

根据法案规定,《人工智能法案》的具体条款采用了分阶段施行举措。首先明确的是“2026年8月2日,法案全面适用”。其次,第一章(总则)和第二章(禁止的人工智能行为)自2025年2月2日起适用;第三章第4节(通知机关和被通知机构)、第五章(通用AI模型)、第七章(治理)和第十二章(罚则;除第101条对通用人工智能模型提供者的罚款要求外)和第九章的第78条,均在2025年8月2日起适用。此外,第6条第1段(关于哪些人工智能系统应被视为高风险系统进行监管的规定)和相应义务则是最晚于2027年8月2日起适用。

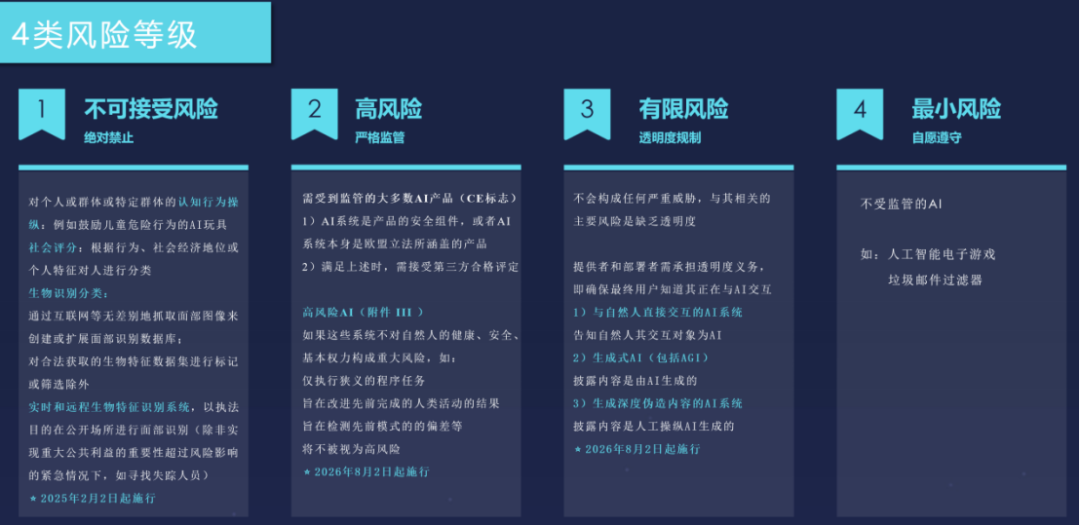

在监管方面,《人工智能法案》创新性地将人工智能系统定义为四种风险等级(见下图),“分级监管”“风险越高、监管越严”模式已经逐渐被其他国家及地区采用或者参考(我国在2025年发布的《人工智能安全治理框架》2.0版中也提出人工智能风险分级,分为低安全风险、一般安全风险、较大安全风险、重大安全风险及特别重大安全风险五个等级)。

一、关键进展

为推进《人工智能法案》的施行,在过去的一年半时间里,欧盟已经构建了在线互动平台,并且发布一系列配套方案、协议及细化规则。

单一信息平台

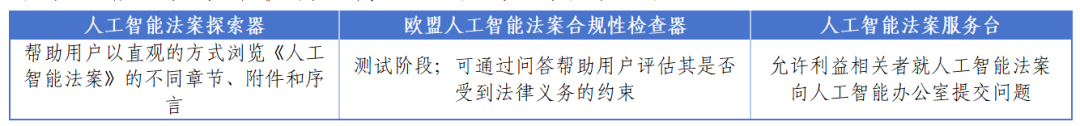

根据《人工智能法案》第62条规定,“需要开发并维护一个单一信息平台(AI Act Single Information Platform)”,基于平台为欧盟内所有利益相关者提供信息,帮助其了解是否要受到法律义务的约束,以及需要采取哪些步骤来遵守法律。目前,单一信息平台已基本构建,其中包括官方对法案的梳理、在线合规评估以及联络机制,构成面向公共的合规工具。

配套政策文件

在《人工智能法案》发布之初,为促进AI相关企业达成共识,以及应对法案条款分阶段施行造成的合规真空期间,欧盟委员会启动了一项《人工智能契约》(AI Pact)工作,主要通过组织研讨会,让相关者交流、理解《人工智能法案》,明确各自的职责以及考虑如何为法案实施做好准备,提供或部署AI系统的公司则签署了其在透明度和高风险要求方面的自愿承诺。据了解,在该项行动中,有230多家公司签署了承诺书。

在第二阶段的条款生效之前(2025年8月2日),欧盟委员会于2025年4月9日发布了《人工智能大陆行动计划》(AI Continent Action Plan),围绕五大战略支柱——计算基础设施、数据、(人员)技能、算法开发与采用、简化规则,全面提升欧盟在AI领域的竞争力。彼时,计划中提出“到2026年,至少有13家在运营的人工智能工厂用于训练和微调AI模型”“部署最多5个超级工厂来训练和开发复杂的人工智能模型”等目标,可理解为在监管施行前为产业发展注入强心剂。

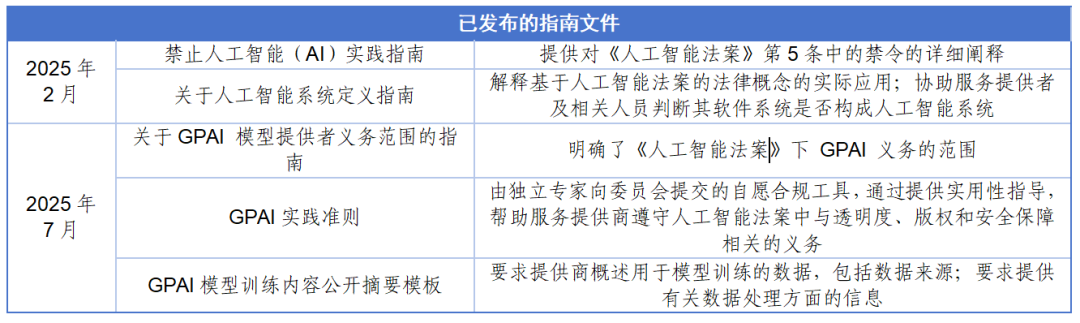

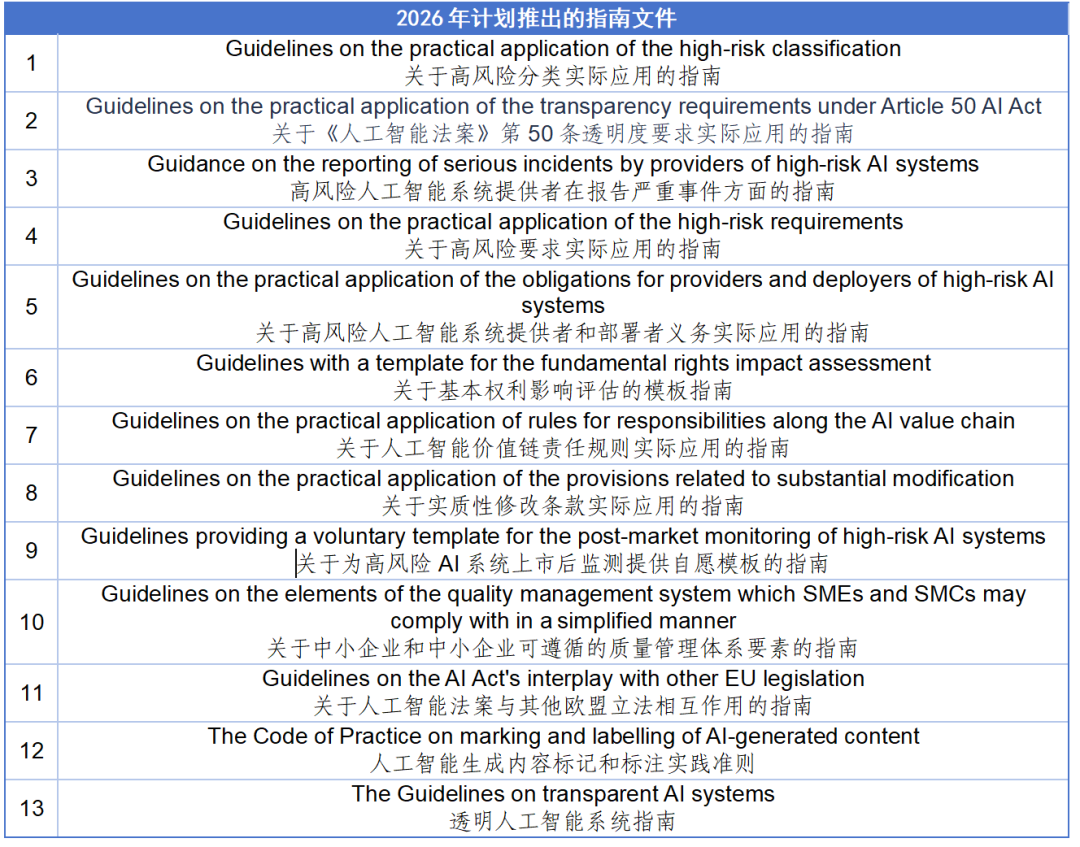

根据《人工智能法案》第96(1)(b)条的规定,欧盟委员会还需要制定关于第5条所禁止的人工智能实践的实施指南。为此,欧盟委员会于2025年2月发布了《禁止人工智能(AI)实践指南》。2025年7月,欧盟委员会又围绕GPAI模型(通用人工智能模型),发布了《关于GPAI模型提供者义务范围的指南》《GPAI实践准则》《GPAI模型训练内容公开摘要模板》三个文件,进一步明确GPAI模型的定义、合规义务以及数据透明度方面的要求。此外,欧盟委员会还计划在2026年推出系列指南,进一步支撑法案的有效执行。

二、监管变数

高风险AI系统相关指南:再次延迟发布

根据《人工智能法案》第6条第5款的明确规定,欧盟委员会应在咨询欧洲人工智能委员会后,不晚于2026年2月2日发布指南,具体说明第6条(高风险AI系统分类规则)的实际实施方法,并附上高风险与非高风险AI系统用例的完整示例清单。

目前时间节点已过,但官方指南迟迟未发布。根据行业预测,该指南可能在3月至4月间发布草案或最终版本,但仍存在不确定性。

高风险AI系统:明确延迟生效

2025年11月19日,欧盟委员会以“简化立法、降低合规成本、强化统一监管”为目的,推出了一揽子的数字改革方案,其中涉及对《人工智能法案》的修订设想。2026年3月13日,欧盟理事会就此提案进一步达成一致,3月19日,《人工智能立法的数字综合法案》提案通过。通过立法改革:

一是将“高风险AI系统”有关规则的生效时间,与相关支持工具及必备标准的落地情况等挂钩,最多推迟16个月(即至少等到高风险AI系统相关指南、标准等配套文件发布后)。2026年通过的改革提案进一步明确了时间,针对独立的高风险AI系统,监管举措最新生效日期为2027年12月2日;针对产品内嵌的高风险人工智能系统,监管举措最新生效日期为2028年8月2日。这一调整主要是由于支撑高风险要求适用的标准制定工作、欧盟各成员国主管机构的组建工作均出现延迟,导致规则无法在原定的2026年8月2日、2027年8月2日顺利实施。

二是对中小型企业的合规义务豁免范围扩大。为了保障创新活力,规避过度监管负担,引入小型中型企业(small mid-cap enterprise,SMC)类别,避免部分企业刚刚脱离小型企业范围,就被纳入需承担高负担合规义务的范畴。

三是监管职能的转变。最初提案提议AI办公室的监管与执法对象为“基于通用人工智能模型的特定AI系统、嵌入于超大型在线平台或超大型在线搜索引擎的AI系统”。此举意味着监管权力从相关资源几近于零的成员国集中到欧盟人工智能办公室,且针对高风险AI系统的执法“手势”或更严格,监管审查更直接。2026年通过的改革提案,进一步细化了对此修订的描述,即AI办公室的监管范围明确排除“AI系统本身即为产品,且属于法案附件一所列的欧盟统一立法的适用范围”“用作关键数字基础设施、道路交通以及水、气、暖和电供应的管理和运行,作为安全组件的AI系统”,这一修订意味着行业监管机构仍保留对相关AI应用的首要监管权。

三、对我国的启示

欧盟AI法案历经立法通过、分阶段生效与重大修订延期。虽然以风险分级奠定治理范式,通过单一信息平台、系列指南与行动构建全流程支撑体系,同步以AI大陆行动计划补齐算力与产业短板,推动监管与发展并进;然而,因配套标准滞后、执法能力不足,又被迫推迟高风险条款生效,并一再调整合规豁免的企业范畴,在严格规制与产业现实间反复衡量。其本质是从“规则制定”转向“规则落地”的过程性摩擦和妥协。

对于我国企业,涉及“在欧盟境内将AI系统投放市场或提供服务或将通用AI模型投放欧盟市场的、虽位于国内或其他第三方国家但AI系统输出用于欧盟的”等情形,需重点警惕欧盟AI法案的潜在监管变数,除了密切关注高风险AI系统监管要求的生效节点,以及针对企业的责任、义务条款的变化,同时需重点关注:

除了纳入欧盟AI办公室执法范围的AI系统,针对其他AI系统,欧盟各成员国可能存在分歧,导致后续执法可能出现松紧差异。

考虑到待出台的指南众多,针对大模型、智能体、高风险AI系统、数据透明度等热点问题,欧盟仍在修订补充细则,合规要求可能随时升级。

对于我国人工智能监管体系,主要的深层启示在于:

第一,坚持分级分类精准治理,借鉴欧盟风险锚定逻辑,完善《人工智能安全治理框架》2.0版风险体系,对禁止类零容忍、高风险严准入、低风险促创新,避免“一刀切”的监管体系。

第二,构建立法、标准、工具协同落地体系,参考欧盟单一信息平台与指南矩阵,加快推出高风险认定、事件报告等细化规则,搭建或培育建设一站式合规服务入口,降低企业合规成本。

第三,平衡安全与发展,吸取欧盟延期教训,设置与产业能力、标准进度挂钩的弹性过渡期,建立中小企业合规减负机制,避免监管先于发展,造成监管难落地、且遏制创新。

文章作者:赛博研究院智库组总监 周雪静

声明:本文来自赛博研究院,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。