在多模态的谣言检测方向,除了将新闻内容进行编码以外,最近的很多工作通过使用图神经网络来描述用户间的关系,通过将不同模态的信息结合,可以显著提高谣言检测的效果。

相比于之前的工作,本文从一个特殊的角度出发来使用GCN。以前使用GCN搭建用户、评论、转发等之间的关系网络,其所依赖的一个先验知识或者说基本假设是,相关联的用户、评论、转发等的可信度是呈正相关的,即物以类聚,人以群分。但是本文指出,现在的一些谣言制造者常常以伪造信用的方式来提高谣言的可信度。

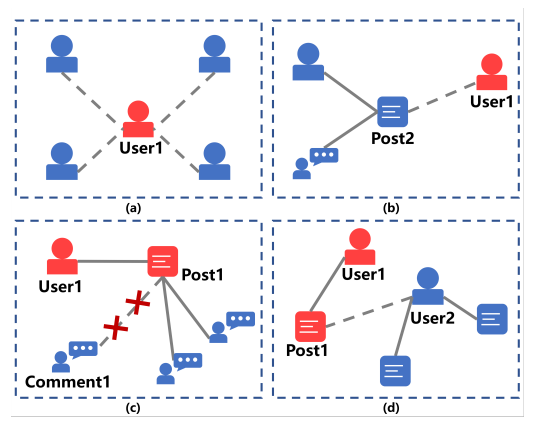

图1 四种谣言伪装方法

图1所描述的是四种常见的谣言伪装方法,图中红色的用户是曾发出或转推过谣言的用户,称之为“坏用户”,蓝色的“好用户”则未曾发出或转推过谣言,同理红色的推文为谣言,蓝色的则是真实或无关的推文。(a)指的是坏用户买粉或是被一些不明真相的好用户所关注,(b)指的是坏用户发布真实推文来提高自身可信度,(c)指的是坏用户删除负面评论,(d)指的是坏用户盗用好用户的账户来散布谣言。首先根据用户、推文、评论、关注与被关注的关系来生成一个关系图,再根据上面的四种方式来添加或删除边以模拟伪装,(a)即添加好用户和坏用户之间的边,(b)即添加坏用户和真实推文之间的边,(c)即删除谣言和负面评论之间的边,(d)即添加好用户和谣言之间的边。

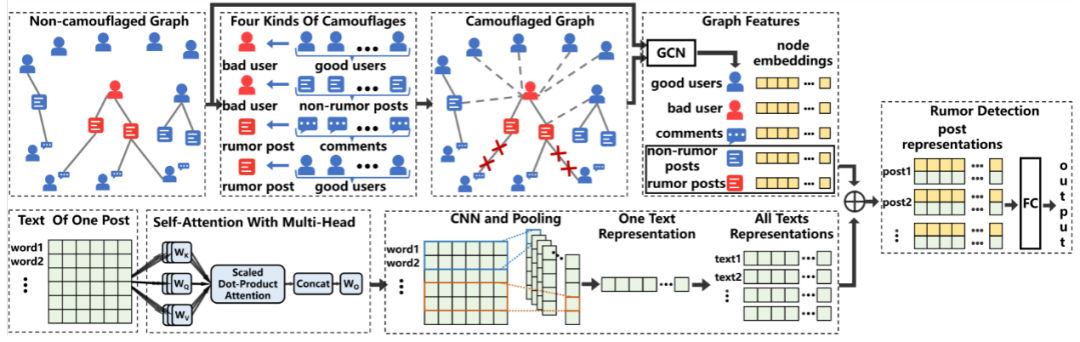

图2 模型总体结构

模型的整体结构如图2所示,使用GCN对真实的和伪造的关系图进行编码以用于对抗学习。再使用transformer的多头注意力、CNN和池化来生成推文的文本表示,再将二者生成的特征进行拼接,组成最终的推文表示,最后通过一个全连接层进行二分类。

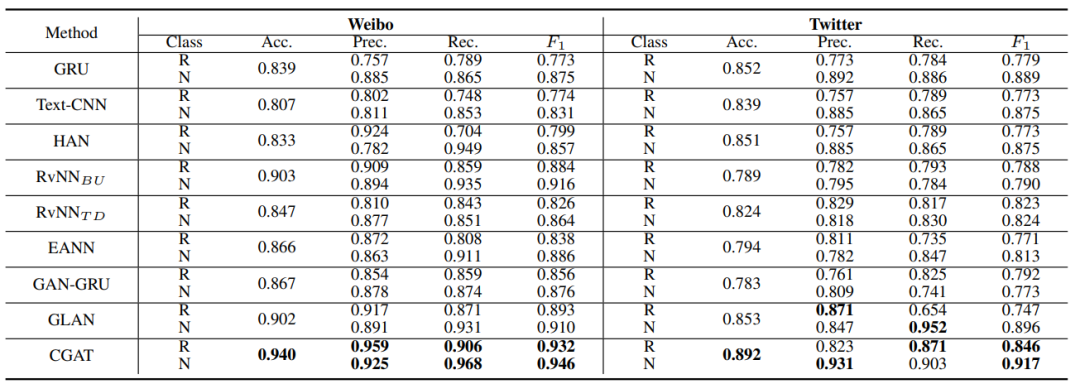

图3 实验结果

相比于之前方法,本文的方法CGAT在微博和推特两个数据集上都达到了很好的效果,且并没有因为语言种类的不同而导致检测效果有所偏差。

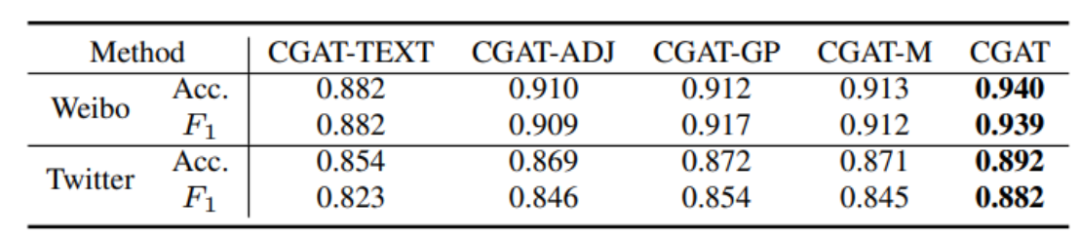

图4 消融实验

在消融实验上,CGAT-TEXT、CGAT-ADJ、CGAT-GP、CGAT-M分别表示只使用文本、只使用真实关系图、使用另一种图对抗攻击方法[Aleksandar Bojchevski and Stephan Gunnemann. Adversarial attacks on node embeddings via graph poisoning. In ICML, pages 695–704, 2019.]、不使用action mask矩阵M,使得两个节点间的边可被添加或删除。可见本文方法的不同模块都对检测效果的提升做出了贡献。

论文信息:Yang X, Lyu Y, Tian T, et al. Rumor detection on social media with graph structured adversarial learning[C]//Proceedings of the Twenty-Ninth International Conference on International Joint Conferences on Artificial Intelligence. 2021: 1417-1423.

论文链接:https://www.ijcai.org/Proceedings/2020/0197.pdf

声明:本文来自隐者联盟,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。