前情回顾·大模型重塑网络安全

安全内参4月10日消息,随着生成式AI的兴起,网络攻击变得越来越常见且复杂。据研究显示,2022年至2023年间数据泄露增加了20%。然而,生成式AI也可能成为应对这些威胁的关键工具。

4月9日,谷歌在Google Cloud Next "24大会上宣布,正在利用AI技术对安全产品线进行创新,以改进威胁检测、强化洞察并提供针对性解决方案。这两项创新工具都已内置在谷歌的SecLM API中,并由AI聊天机器人Gemini支持,以协助安全团队并提高生产效率。

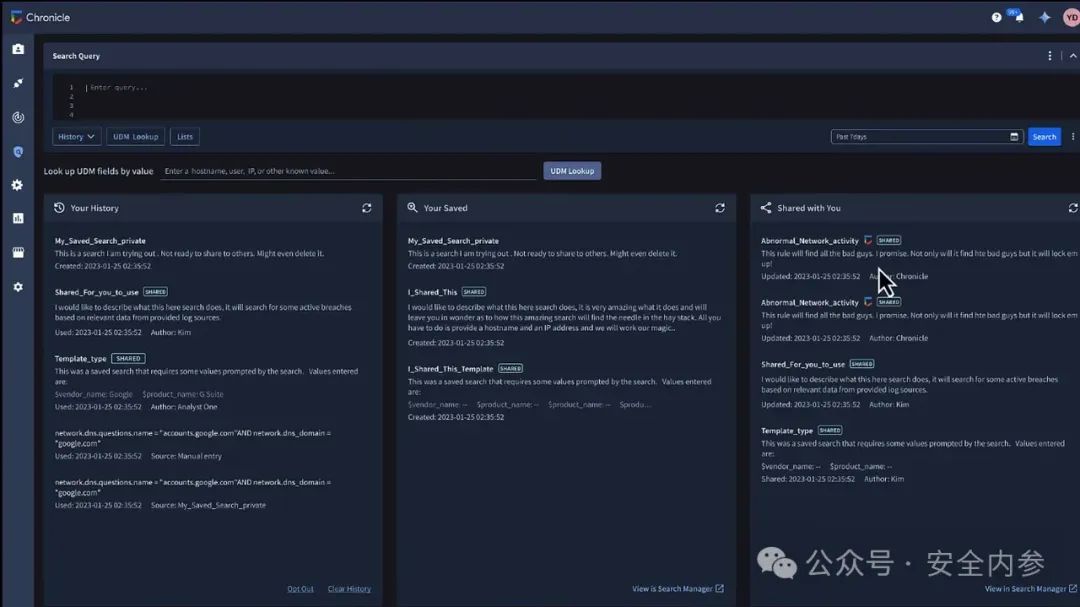

图:在Chronicle中运行的Gemini in Security平台。

威胁情报场景

Gemini现已能通过对话搜索,访问谷歌威胁数据服务Mandiant,获取有关恶意行为的洞见。谷歌希望,通过使用Gemini,安全团队能够更精确地识别可疑活动,并更快速地捕获威胁。

根据谷歌博客文章,这一功能还能“自动在网络上爬取相关的开源情报文章,提取信息并提供简洁的摘要,以协助分析师”提高威胁研究效率。与目前大多数AI应用程序一样,Gemini in Security平台旨在通过提高基础防御效果,使安全分析师能够集中精力处理高级威胁。

据谷歌表示,Gemini允许安全团队分析更大的代码样本,以寻找潜在的恶意活动迹象。谷歌称:“Gemini提供了一个较大的上下文窗口,允许分析模块之间的互动,为代码的真实意图提供新的洞见。”该功能目前正处于公开预览阶段。

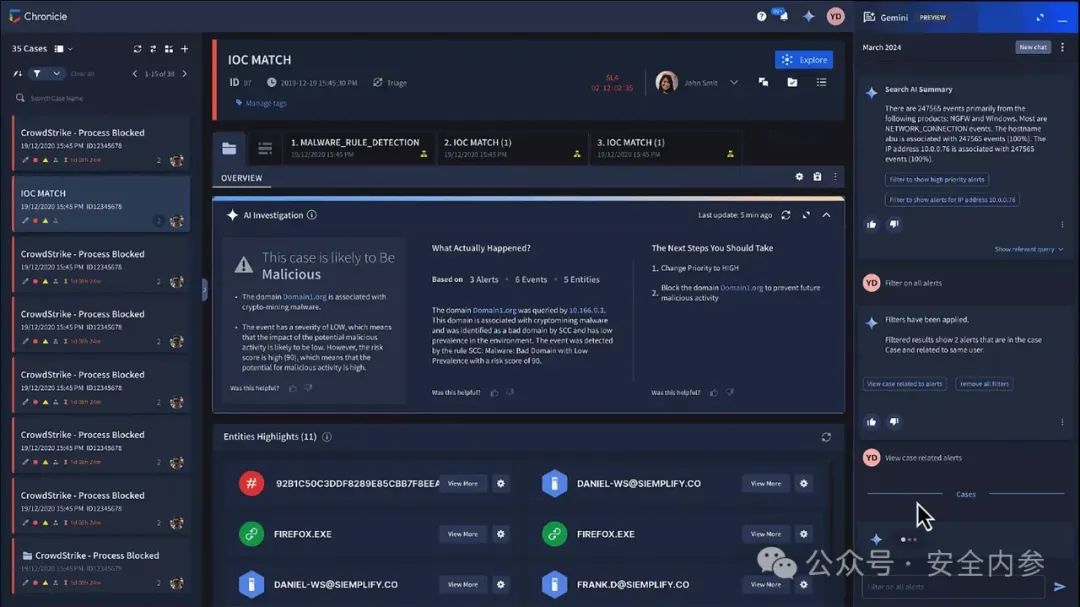

图:使用Gemini进行查询

安全运营场景

继2023年12月全面开放Duet AI in Security Operations功能后,谷歌现在正将Gemini in Security Operations功能组件加入其安全运营平台Chronicle中。这一功能允许使用自然语言总结洞见,可以增强安全团队检测和应对威胁的能力,并使Chronicle更易于使用。

此次更新还新增了辅助调查功能。据谷歌称,这一功能可以“将自然语言转换为新的检测请求、总结事件数据、推荐应采取的行动,并通过对话式聊天指导用户浏览平台。”Gemini in Security Operations功能将于2024年4月底正式推出。

这两项Gemini的更新,旨在帮助用户构建更强大的数据代理,以加强安全。

图:Gemini for Security提供的洞见。

对Workspace和Gmail的改进

谷歌还宣布了一个Workspace的附加组件,允许IT团队使用AI模型和数据防泄漏(DLP)控制措施对敏感材料进行分类和保护。这些控制措施是基于他们组织的数据进行训练的。Workspace管理员可以自动保护公司范围内的文件,并能够持续评估所有员工的任意网盘文件。

该附加组件能够利用公司特有数据训练模型,进一步个性化隐私保护工作,并有助于团队更好地预测安全需求。用户每月需支付10美元。这一附加组件将适用于大多数Workspace套餐。谷歌没有明确指出该功能组件具体针对哪些用户,或何时会向所有用户开放。

谷歌在其公告中表示,Gmail和Workspace都是基于零信任安全方法构建的。因此,公司正在针对Gmail推出扩展的DLP控制措施和分类标签(目前处于测试版)。谷歌声称,Gmail已经能够阻止“超过99.9%的垃圾邮件、钓鱼尝试和恶意软件进入您的收件箱”;而且,大型语言模型现在还有能力再多屏蔽20%的可疑内容。

通过这次升级,谷歌将“每天评估Gmail用户报告的垃圾邮件数量将增加1000倍”。

专家表示,总有一天量子计算会对我们当前的加密方法产生影响。为了应对量子计算机攻击,谷歌还宣布正在与第三方合作伙伴Thales和Fortanix合作,“尝试在客户端加密中增加支持后量子密码学(PQC)功能”。

参考资料:https://www.zdnet.com/article/google-unveils-new-gemini-powered-security-updates-to-chronicle-and-workspace/

声明:本文来自安全内参,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。