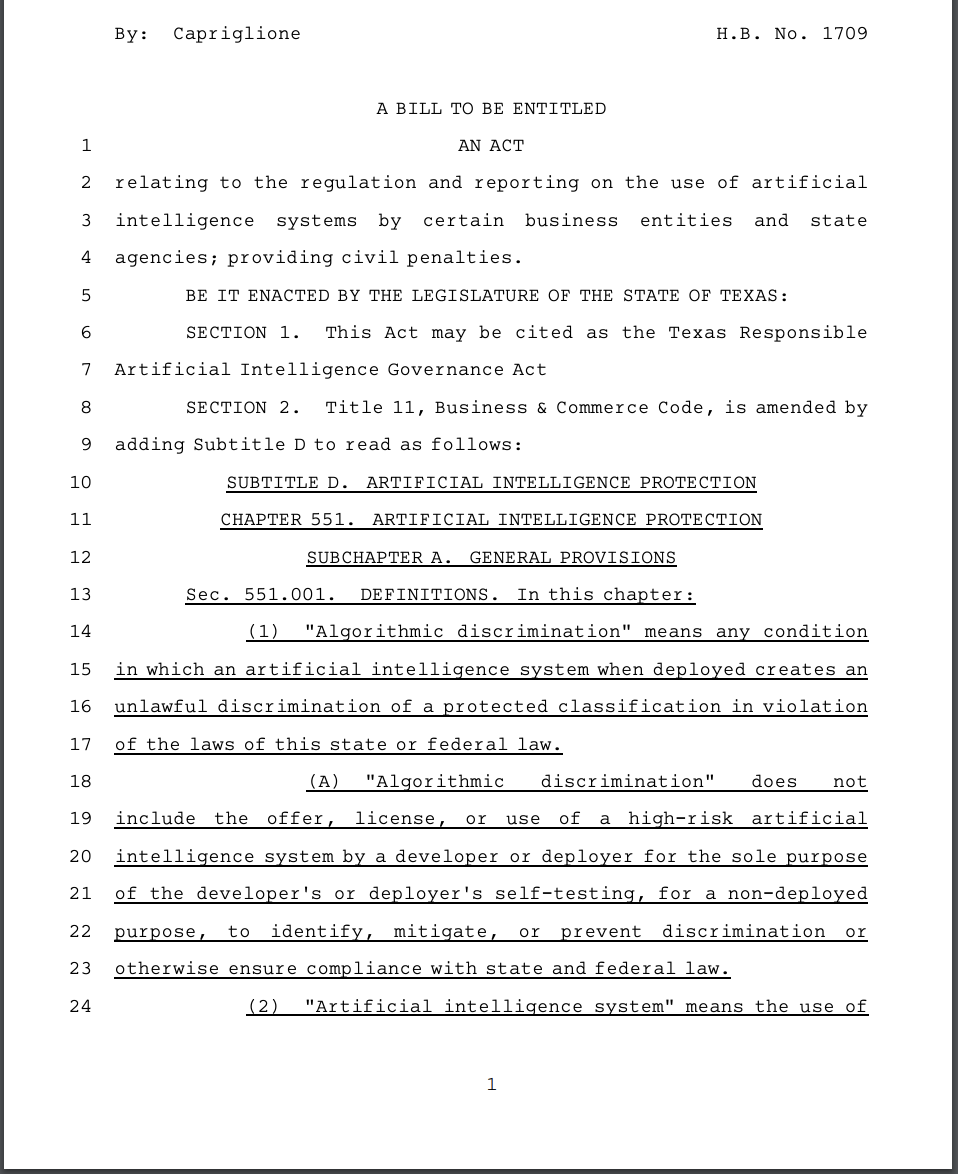

2024年12月23日,美国德克萨斯州众议院第1709号法案《负责任的人工智能治理法案》提交议会审议,旨在规范人工智能系统,防止在就业和医疗保健等关键领域出现算法歧视。

该法案要求对高风险的人工智能系统进行年度影响评估、消费者信息披露和监督程序,同时豁免不受法案直接监管的小型企业。开发者必须提供风险评估并召回不合规的系统,由德克萨斯州总检察长负责执行该法案。

该法案可能于 2025 年 9 月 1 日生效。

该法案适用于,在得克萨斯州运营的大型企业和实体,这些企业和实体开发、部署或分发的高风险人工智能系统影响着就业、医疗保健、住房和金融服务等重要决策;为使用高风险人工智能系统提供便利的数字服务提供商和社交媒体平台,特别是如果它们使用户受到算法歧视或被禁止使用;以及总部位于得克萨斯州以外,开发、分销或部署由得克萨斯州居民使用或消费的高风险人工智能系统,或运营收集和处理得克萨斯州居民数据的平台或服务的企业。

该法案的大部分内容集中在“高风险人工智能系统”上,其中包括在部署时会做出重大决策或以其他方式影响重大决策的人工智能系统。该法案特别排除了许多系统,例如旨在检测决策模式的技术、反恶意软件和反病毒程序、计算器等。

另外,该法案还根据当事人的角色规定了具体义务,包括:“部署者”是指在德克萨斯州开展业务并部署高风险人工智能系统的一方。“开发者”是指在德克萨斯州开展业务,开发高风险人工智能系统或对此类系统进行重大或故意修改的一方。确定一方的角色是评估其根据该法案所承担的义务的关键。

关于开发人员的职责,该法案要求高风险人工智能系统的开发者必须采取合理的谨慎措施,保护消费者免受已知或合理可预见的风险。 此外,该法案还要求开发者在向部署者提供高风险人工智能系统之前,向部署者提供一份书面的“高风险报告”,必须包括:

关于应如何使用和不应如何使用高风险人工智能系统的描述,以及当系统被用于做出“重大决策”(或成为做出“重大决策”的重要因素)时应如何监控该系统的描述。对系统已知局限性的描述、衡量系统性能的指标以及系统在这些指标下的表现。对任何已知或合理可预见的可能发生的算法歧视、非法使用/披露个人数据、或欺骗性操纵或胁迫人类行为的风险的描述。对用于编程或训练系统的数据类型的描述。概述为涵盖训练数据集及其收集而实施的数据治理措施、用于检查数据源适用性的措施、可能存在的歧视性偏见以及为减轻此类风险而采取的措施。

在部署高风险人工智能系统之前,开发人员必须采用并实施正式的风险识别和管理政策,该政策必须满足一些规定的标准。此外,开发人员还需要保存用于开发生成人工智能系统或服务的任何生成人工智能训练数据集的详细记录。

该法案要求高风险人工智能系统的部署者采取合理的谨慎措施,保护消费者免受算法歧视引起的已知或合理可预见的风险。 此外,如果部署者认为或有理由认为某个系统不符合上述义务,该法案要求部署者暂停使用该系统,并将此类问题通知相应系统的开发者。此外,高风险人工智能系统的部署者必须对此类系统做出的后果性决定进行人工监督。

如果部署者得知已部署的高风险人工智能系统已经造成或可能导致算法歧视或不适当或歧视性的后果性决定,该部署者必须在获悉此类问题之日起十 (10) 天内通知人工智能委员会、德克萨斯州总检察长或监管部署者行业的州机构负责人。

另外,该法案还要求高风险人工智能系统的部署者每半年完成一次影响评估,并在对系统进行任何故意或重大修改后的九十 (90) 天内完成。该法案概述了评估中必须解决的一些问题,包括但不限于分析该系统是否存在任何已知或合理可预见的算法歧视风险,以及描述为减轻此类风险而采取的步骤。此外,在对高风险人工智能系统进行故意或重大修改后,部署者必须披露系统的使用方式与开发者预期用途一致或有差异的程度。

此外,该法案还要求开发人员每年审查高风险人工智能系统的部署情况,以确保该系统不会引起算法歧视。

该法案还规定,数字服务提供商和社交媒体平台必须采取商业上合理的努力,防止服务或平台上的广告商部署可能使用户遭受算法歧视的高风险人工智能系统。

该法案对特定活动进行了多项限制,例如:(1)操纵人类行为 ——该法案禁止使用人工智能系统,该系统采用潜意识或欺骗技术,目的或效果是显著削弱个人或群体做出明智决策的能力,从而严重扭曲个人或群体的行为。(2)社会评分 ——该法案禁止使用开发或部署的人工智能系统,根据自然人或自然人群体的社会行为或预测的个人特征对其进行评估或分类,以确定社会分数或类似的估计/估值。(3)生物特征识别信息 ——该法案禁止使用为收集或以其他方式收集个人生物特征识别信息而开发或部署的人工智能系统。此外,该法案还禁止使用通过生物特征识别信息推断或解释个人或群体敏感个人属性的系统,但对合法获取的生物特征识别信息数据进行标记或过滤除外。(4)受保护的特征 ——该法案禁止使用基于个人种族、肤色、残疾、宗教、性别、国籍、年龄或特殊的社会或经济状况的特征的人工智能系统,其目的(或效果)是实质性地扭曲个人行为,从而导致或可能导致个人或他人受到重大伤害。(5)情感推断 ——该法禁止在未经自然人明确同意的情况下使用推断或能够推断自然人情感的人工智能系统。

部署、提供、销售、出租、许可、赠送或以其他方式提供与消费者交互的高风险人工智能系统的部署者或开发者必须向消费者(在交互之前或交互时)披露以下内容:消费者正在与人工智能系统互动;该系统的目的;系统可能会或将会做出影响消费者的重大决定;系统是或可能是促成因素的任何后续决策的性质;做出任何重大决定时要考虑的因素;相关部署人员的联系方式;对系统中任何人为组件的描述;系统任何自动化组件的描述;关于如何使用人力和自动化组件来为后续决策提供指导的描述;以及消费者权利宣言。前述披露必须显而易见,并以通俗易懂的语言表达出来。

另外,该法案还允许消费者对侵犯其在该法案下的权利的开发商或部署者(包括从事上文讨论的任何明确禁止的活动)提起诉讼。尽管有上述规定,但消费者似乎只能寻求宣告性或禁令性救济,而不能寻求损害赔偿,尽管消费者可以收回成本和合理必要的律师费。

值得注意的是,该法案赋予德克萨斯州总检察长调查和执行该法案的管辖权,包括通过禁令。

此外,该法案还授权根据具体情况处以行政罚款,例如,如果开发商或部署者未能及时纠正禁止使用违规行为,每次违规将被处以 40,000 美元至 100,000 美元的罚款。

法案全文:https://www.mba.org/docs/default-source/policy/state-relations/draft_texas-ai_10.28.24.pdf?sfvrsn=9f83267e_1

声明:本文来自互联网法律匠,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。