原文标题:From Risk to Resilience: Towards Assessing and Mitigating the Risk of Data Reconstruction Attacks in Federated Learning

原文作者:许向蕊;李志泽;韩宇飞;王滨;刘吉强;王伟原文连接:https://zenodo.org/records/15612436发表会议:USENIX Security 2025主编:黄诚@安全学术圈编辑:张贝宁@安全学术圈

本次分享论文由北京交通大学作为第一单位,SMU、 INRIA、浙江省 AIoT 网络与数据安全重点实验室为合作单位共同完成,通讯作者单位为北京交通大学和西安交通大学。

该研究深入探讨了联邦学习中的隐私风险量化评估与防御。建立了 “逆向损失”(Invertibility Loss, InvLoss)理论框架,为跨数据集、跨模型下的数据重构风险提供了通用度量。基于该框架,设计了两种自适应噪声扰动防御策略,有效增强了联邦学习中隐私保护与模型效用的平衡。

1. 背景概述

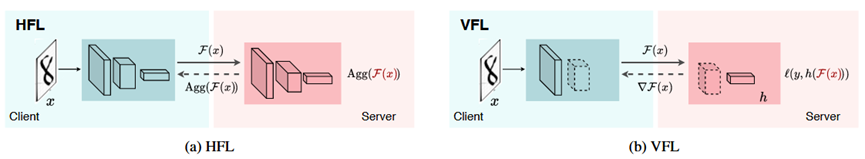

联邦学习(Federated Learning,FL)作为一种隐私友好的分布式训练框架,允许各方在不共享原始数据的前提下协同建模。然而,近年研究发现,即使原始数据不出本地,攻击者(中央服务器)仍可通过利用联邦学习中共享的中间结果(如横向联邦中的模型更新或纵向联邦中的特征嵌入)反推原始数据,导致严重的隐私泄露。

图1 联邦学习架构(HFL 和VFL)

图1 联邦学习架构(HFL 和VFL)

目前主流的数据重构攻击风险评估方法,主要通过量化中间结果中所包含的原始数据信息(如互信息或费舍尔信息)来构建隐私风险评估框架。然而,这类方法存在显著局限性:对于高度非线性的深度模型,互信息往往难以直接计算,通常需要在数据空间中进行近似估计,导致难以准确刻画数据与模型之间的关联性,从而限制了跨模型的风险评估能力;而费舍尔信息依赖于无偏假设,实用性较差,且不同模型间缺乏可比性。此外,现有方法多针对特定的联邦学习场景(如横向或纵向联邦学习),尚未形成统一、通用的风险评估框架。

因此,亟需一种统一且精确的风险评估方法,能够在不同输入样本与模型配置下量化隐私泄露程度,为联邦学习训练和部署中的隐私保护决策提供科学依据。

2. 核心贡献

本文从参数-数据空间映射的“可逆性”本质出发,提出了与模型架构及攻击方法无关的“逆向损失”(Invertibility Loss, InvLoss)理论框架,为数据重构攻击风险的量化评估与防御机制设计提供系统性支撑,具体贡献包括:

1)理论突破:建立了 InvLoss 理论上界,证明了联邦学习中的数据重构风险由共享中间结果的雅可比矩阵谱特性主导,揭示了影响攻击有效性的统一规律。

2)评估创新:提出了融合不同逆向能力及对应概率的数据重构攻击风险估计器 InvRE(Invertibility Risk Estimator),可提供跨数据实例和模型架构的隐私风险评估。

3) 防御演进:设计了基于雅可比矩阵谱分析的自适应噪声注入策略,包含 InvL-DNP 和 InvL-GNP/ENP 两种优化方案,所提策略可实现高效防御且几乎不损失模型准确率。

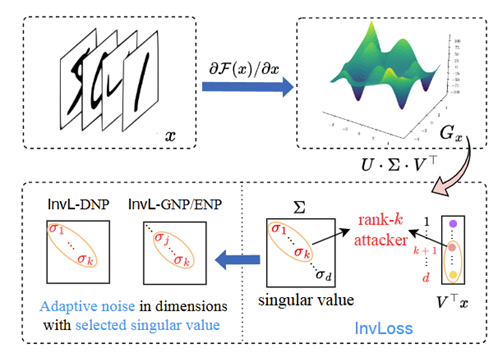

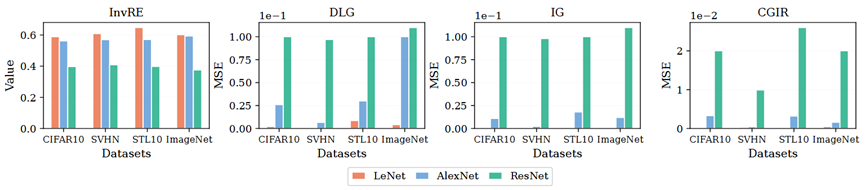

图2:InvLoss与InvL-DNP和InvL-GNP/ENP 示意图

图2:InvLoss与InvL-DNP和InvL-GNP/ENP 示意图

3. 方法详解

3.1 InvLoss:攻击可行性的上界度量

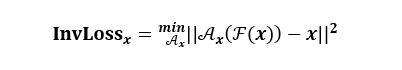

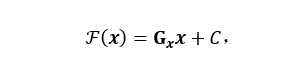

定义1(逆向损失). 给定数据实例 x,设 F(x) 为联邦学习中共享的模型更新或特征嵌入。定义逆变换函数 (∙) 可将 F(x) 逆映射回数据空间。数据重构攻击的目标在于估计 ,从而最小化 x 上的逆向损失(Inversibility Loss, InvLoss):

其中,||∙|| 为欧氏距离。 逆向损失反映了最优逆变换 所能达到的最小重构误差。

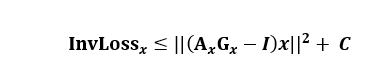

其中, C=o( δ ) , 通过Cauchy-Swartz不等式, 满足以下不等式:

最优逆变换 为 的Moore-Penrose伪逆。在实际攻击中,较弱的攻击者无法达到逆变换的最优解,只能近似地得到秩为 k(不大于 的非零奇异值数量)的 。

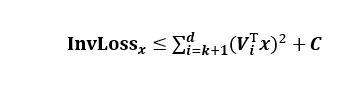

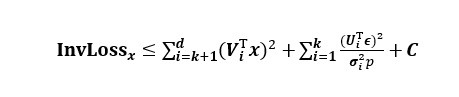

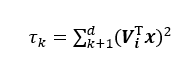

定理1 (rank-k攻击者的逆向损失). 对于归一化数据实例 x∈ 及对应共享参数 F(x)∈ 其逆向损失逆向损失上界为: 其中, d=min{m,p}。 表示 x 在奇异向量 上的投影。

其中, d=min{m,p}。 表示 x 在奇异向量 上的投影。

3.2 InvLoss对现有隐私防御策略有效性的解释

基于定理 1,可以从逆向损失的视角系统地分析现有数据重构攻击防御策略的有效性。

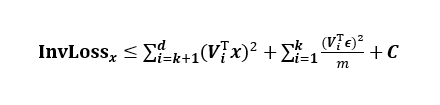

定理2 DNP防御下的逆向损失. 对于归一化输入实例 x∈ , 攻击者可访问的共享信息为F(x)∈ ,当对 x 应用基于数据级噪声扰动(DNP)防御策略时,rank-k 最优攻击者在 DNP 下的逆向损失上界为: 其中,ϵ 是注入到 x 的噪声扰动,k 表示攻击者所能估计的秩。

其中,ϵ 是注入到 x 的噪声扰动,k 表示攻击者所能估计的秩。

定理 3 GNP/ENP防御下的逆向损失. 对于归一化输入实例x∈ ,攻击者可访问的共享信息为F(x)∈ ,当对 F(x) 应用基于梯度级(GNP)或嵌入级(ENP)的噪声扰动防御时,rank-k 最优攻击者的逆向损失上界为: 其中,ϵ 为注入到 F(x) 的噪声 σ 为 的第 i 个奇异值,p 为噪声维度 为与 F(x) 第 i 个最大奇异值对应的左奇异向量。

其中,ϵ 为注入到 F(x) 的噪声 σ 为 的第 i 个奇异值,p 为噪声维度 为与 F(x) 第 i 个最大奇异值对应的左奇异向量。

3.3 InvRE:模型无关的“风险计量器”

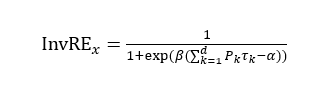

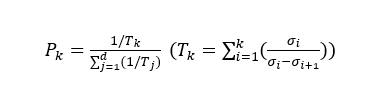

根据定理 1,秩 k 的大小直接反映了攻击者的能力,随着 k 的增加,攻击者可利用更多奇异向量来计算雅可比矩阵的 Moore-Penrose 伪逆,从而提高数据重构精度。同时,奇异值的幅值与谱间距决定了攻击者在秩 k 下执行数据重构攻击的可行性(概率)。为此,我们提出InvRE方法,通过融合不同攻击强度及其对应概率,量化数据泄露风险。定义如下:

其中,

表示攻击者成功恢复 前 k 个最大奇异值的可能性,

表示秩为 k 的最优攻击者下逆向损失的上界。

α 为在不同数据集上的经验平均值。β 为经验选择的缩放因子,用于避免 softmax 计算中的数值饱和问题。

3.4 基于InvL的自适应防御策略:精准加噪,低损防护

现有噪声防御方法普遍采用全维度盲目加噪,虽然能提升隐私保护,但往往带来显著的模型性能下降。然而,根据定理2和定理3的逆向性损失上界分析表明:有效防护只需在关键奇异子空间注入噪声,其他方向的噪声几乎无效。

基于此,本研究提出一种频谱自适应的噪声注入策略:通过将噪声精准投射到前 k 个关键奇异子空间,在维持同等防护强度的前提下显著降低噪声总量,从而在保障隐私安全的同时最小化对模型性能的影响。

4. 实验验证

在4个常用图像数据集(CIFAR10、SVHN、STL10、ImageNet)和多个模型结构(如HFL中的LeNet、AlexNet、ResNet或VFL中的ResNet-cut1、ResNet-cut2、ResNet-cut3)上进行了大量实验,结果表明:

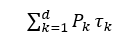

4.1 InvRE与真实攻击重建效果(MSE)显著负相关,能准确反映不同数据、模型下的隐私泄露风险;

图3:不同样本的InvRE 与重构MSE之间的相关性

图3:不同样本的InvRE 与重构MSE之间的相关性

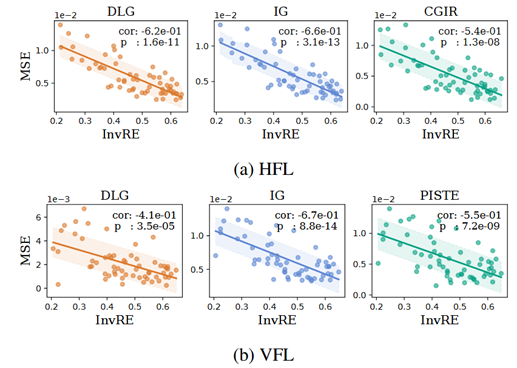

图4:不同模型结构下InvRE 与重构MSE之间的相关性

图4:不同模型结构下InvRE 与重构MSE之间的相关性

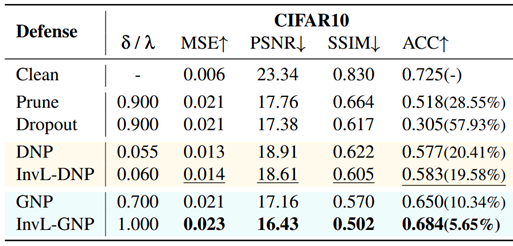

4.2 自适应防御策略在实现最佳防御效果的情况下,对模型主任务的影响最小;

表1 :不同防御下,模型准确性(ACC)和重构MSE的性能对比

5. 总结

本文首次将“逆向损失”引入到联邦学习数据重构攻击的风险量化评估中,不仅构建了统一的风险评估框架,还基于理论推导提出了实用的防御策略。这项工作为联邦学习隐私保护提供了一个从“风险评估”到“防御决策”的闭环系统,具有重要的理论与应用价值。

6. 团队介绍

一作许向蕊,北京交通大学2021级博士研究生,导师为韩臻/王伟教授,2025年6月获得博士学位,将于2025年8月入职青岛科技大学信息科学与技术学院担任教职。2024年至2025年分别在新加坡管理大学(SMU)及法国国家信息自动化研究所(INRIA)交流访问。2024年获得首届中国科协《青年人才托举工程博士生专项计划》(中国电子学会)。主要研究方向为人工智能安全与隐私保护。目前已发表网络安全领域CCF-A类顶级会议/期刊发表论文4篇(包括四大顶会之一的USENIX Security 1篇,IEEE TIFS 1篇,IEEE TDSC 2篇);发表领域综述论文1篇,单篇引用量已超过220次,并获Cybersecurity 2024年度优秀论文奖。此外,已授权国家发明专利9项(其中包括1项美国专利),参与编写学术专著2部。

通信作者王伟教授致力于人工智能系统安全、数据要素高效安全流通和区块链技术研究,任西安交通大学教授、软件学院院长,2011-2024年就职于北京交通大学。已培养毕业研究生70余名。主持了国家重点研发计划项目、国家自然科学基金联合基金重点项目、专项项目等多个重点项目。获中国自动化学会科技进步奖一等奖等科技奖励,获CCS 2023杰出论文奖。研究成果在多个大型企业得到应用。

安全学术圈招募队友-ing

有兴趣加入学术圈的请联系 secdr#qq.com

声明:本文来自安全学术圈,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。