LiteLLM是全球广泛使用的AI大模型调用库,Xinference则是下载量超68万次的国产AI模型部署与推理工具,在2026年3至4月期间,二者接连遭软件供应链投毒攻击,导致大量AI项目面临云凭证、密钥等核心资产泄露风险。此类事件表明,攻击者正绕过传统防御,对AI技术栈中模型网关、推理框架等高价值节点实施精准打击,从单点突破演变为沿“上游工具—核心组件—下游应用”的连锁信任链渗透。本文分析当前AI开源供应链攻击的新趋势与深层风险,提出构建“源头可溯、过程可控、风险可知”的全链路安全防御体系建议,为企业应对AI供应链威胁提供参考。

态势研判:AI供应链攻击“精准化”

随着AI技术栈的日益复杂,针对上游开源组件的供应链攻击呈现爆发式增长态势,安全风险已从传统的代码漏洞利用演变为针对开发工具链与信任关系的系统性攻击。

(一)攻击目标从广撒网转向高价值场景

2026年上半年发生的连续攻击事件表明,AI供应链攻击的目标选择已发生根本性位移,即攻击者不再满足于随机漏洞扫描,而是主动锁定AI技术栈中的关键枢纽节点实施定向打击。

在LiteLLM事件中,攻击者利用窃取的CI/CD凭证,向PyPI仓库发布恶意版本1.82.7与1.82.8,导致数千家企业面临云凭证泄露与内网渗透风险。仅一个月后,国产AI推理工具Xinference同样因维护者权限泄露,在2.6.0、2.6.1、2.6.2三个版本中植入恶意代码,波及大量企业私有化部署与推理服务场景。两起事件并非孤立个案,标志着攻击范式的转变:攻击者已从传统的“广撒网”漏洞扫描,转向对AI技术栈中模型网关、推理框架、训练工具等“高价值、高权限、高依赖”关键节点的精准打击,以极低成本实现大范围渗透。

(二)攻击手法从显性破坏转为隐蔽持久

与攻击目标趋于精准同步,攻击手法也在快速迭代升级——从过去追求短期破坏效果的显性攻击,转向以长期潜伏、静默窃密为目的的隐蔽持久化渗透。

在LiteLLM事件中,攻击者利用Python的.pth文件自动执行机制,实现“安装即感染”,开发者无需import即可触发恶意代码,全程无感知;Xinference事件中,恶意代码被深植于项目核心初始化文件,经多层Base64编码混淆伪装,可有效规避传统静态代码扫描。同时,两起事件中的恶意代码普遍具备自清理、反调试、加密回传等能力,呈现出静默潜伏、持久驻留、痕迹自毁的攻击特征,使得传统基于文件扫描和运行时检测的防护手段难以及时察觉。

(三)攻击链条呈现连锁化特征

更具威胁性的是,本轮攻击并非孤立打击单一组件,而是展现出沿信任链逐级渗透、联动突破的连锁化攻击模式。

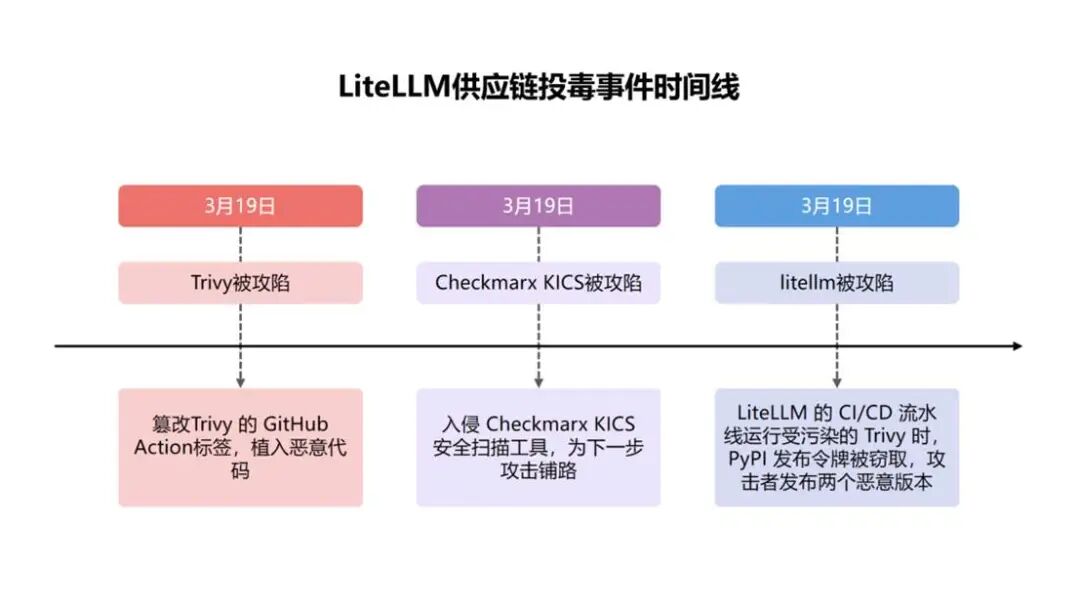

LiteLLM事件的复盘清晰揭示了这一攻击链条,攻击组织TeamPCP并非单点发起攻击,而是采用了信任链渗透方式:首先攻陷了上游开源安全扫描工具Trivy的CI/CD流水线,使其成为攻击载体以窃取敏感凭证,再利用获取的权限横向渗透至 LiteLLM 核心项目,形成了“上游工具—核心组件—下游应用”的完整攻击链条。这种类似APT的信任链渗透攻击模式,意味着AI供应链安全已从“单点防御不足”进入“信任链全面承压”的新阶段,传统的边界防御在连锁攻击面前形同虚设。

风险剖析:AI开源生态的脆弱性

AI开源供应链攻击频发的背后反映出当前AI生态在快速迭代中存在的安全风险。

(一)社区信任机制存在安全盲区

传统软件供应链安全依赖“社区信任机制”的声誉信任模型。然而,LiteLLM、Xinference供应链投毒事件表明,即便是官方仓库中的知名开源项目,也可能因维护者账号被盗、CI/CD流程被劫持而沦为攻击载体,开发者极易在无感知情况下拉取、引入恶意版本与恶意代码,导致供应链“源头污染”。这一现实揭示了基于声誉的社区信任模型的深层局限:维护者身份的可靠性无法等同于其发布版本的安全性,社区信任无法替代技术验证。源头可信不等于版本安全,软件来源合法也不等于代码可信。

(二)依赖关系深耦合引发级联风险

AI应用具有依赖层级深、组件关系复杂的特点。一个典型的AI应用可能间接依赖数百个第三方库。一旦处于依赖链上游的基础组件被投毒,风险便会沿着依赖链急速传导至所有下游应用,大幅增加了漏洞修复与影响范围评估的难度。这种“一损俱损”的传递性级联效应,意味着单一组件的安全事件即可动摇整个AI应用生态的稳定性,修复成本随依赖深度呈指数级增长,传统的漏洞分段修补模式难以为继。

(三)核心资产高度集中放大攻击危害

AI开发环境通常集成了云原生基础设施,持有AWS/GCP访问密钥、SSH私钥、Kubernetes集群配置、数据库连接串等高权限凭证。若研发流程所依赖的开源工具遭遇供应链投毒攻击,可能导致代码仓库令牌、部署凭证等核心资产沿信任链泄露。对AI产业链各企业而言,此类风险不仅直接危及企业自身的核心资产安全与业务连续性,更可能沿AI服务链向下游应用蔓延,由于涉及关键生产和服务环节,进而威胁整个产业生态乃至国家安全与社会稳定。

破局之道:重构AI供应链信任体系

面对AI开源软件供应链从单点突破转向连锁化渗透的信任危机,开发者需改变对传统社区声誉的盲目信任,企业需从被动防御转向主动破局,构建覆盖全生命周期的AI软件供应链安全防御体系。

(一)以技术验证代替盲目信任

针对社区信任机制存在的安全盲区,需摒弃“开源即安全”、“官方即可信”的惯性思维,全面落实AI组件分级分类准入机制与AI物料清单(AI-BOM)管理机制,对引入的第三方开源组件进行完整性校验与深度扫描,搭建隔离沙箱开展安全验证,以技术核验代替主观声誉信任,从源头防范供应链投毒风险。

(二)有效斩断隐蔽持久的攻击链条

针对依赖深耦合引发的级联风险,需基于AI-BOM构建自动化的组件识别与依赖关系图谱,实现供应链资产的全透明化,精准评估漏洞影响面。在代码构建环节,强制采用不可变的代码提交哈希值替代易被劫持的版本标签,从源头规避标签篡改风险;同步建立动态运行监测机制,识别静默潜伏、加密回传等隐蔽恶意行为,及时阻断横向渗透的攻击路径。

(三)构建高韧性应急响应与恢复机制

针对AI开发环境核心资产高度集中、攻击危害易被放大的风险,需严格遵循最小权限原则,实施细粒度的访问控制,避免供应链感染直接导致核心基础设施失陷。同时,应建立常态化的安全准入审查、监测及应急替换机制,确保在遭遇投毒攻击时,能够快速定位受感染节点、平滑替换安全版本,保障业务连续稳定运行,提升AI供应链安全防护韧性。

综合来看,LiteLLM与Xinference事件是AI开源供应链安全风险的一次集中暴露。对整个AI产业生态而言,这一挑战也是重构信任链、构建差异化安全能力的战略契机。唯有正视供应链安全短板,系统化建设“源头可溯、过程可控、风险可知”的防御体系,方能为“AI+”战略的行稳致远筑牢信任基石。

作者:

王玮、樊期光 | 安全技术研究所(中国移动人工智能安全治理研究中心)

审核:

杨凯 | 安全技术研究所(中国移动人工智能安全治理研究中心)

声明:本文来自中移智库,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。